深度学习模型包管理工具

本文介绍深度学习模型包管理工具的使用方法和注意事项。

工具介绍

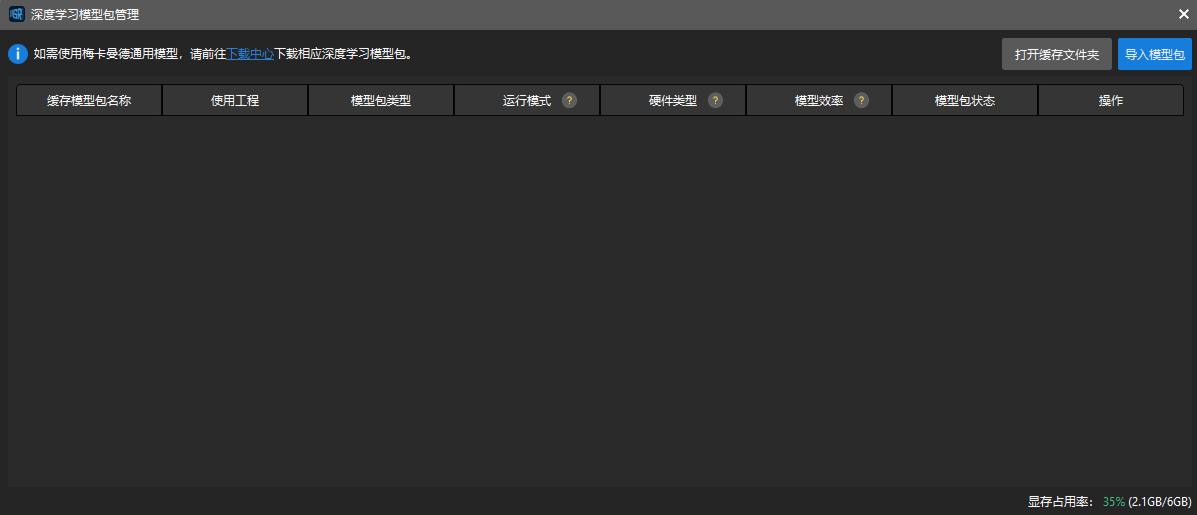

深度学习模型包管理工具是 Mech-Vision 软件提供的管理深度学习模型包的工具,可对Mech-DLK 2.2.0 及之后导出的深度学习模型包进行优化,并对运行模式、硬件类型、模型效率、模型包状态进行管理。此外,该工具还可以监控工控机的 GPU 使用率。

|

|

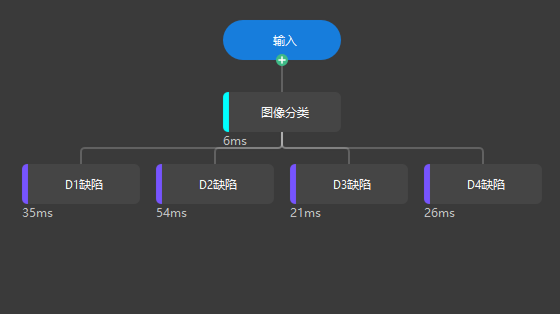

自 Mech-DLK 3.0.0 起,模型包分为单模型包、多模型包两种类型。Mech-DLK 2.4.1 至 Mech-DLK 3.0.0 之前的版本仅支持导出单模型包和级联模型包(即串联模型)。

|

功能入口

你可以通过以下方式打开该工具:

-

新建或打开工程后,在菜单栏依次选择。

-

在软件的工程编辑区,单击深度学习相关步骤上的配置向导按钮。

-

在软件的工程编辑区,选中深度学习相关步骤,然后在步骤参数栏中单击模型包管理工具下的打开编辑器按钮。

界面描述

该工具界面中各选项字段描述如下:

| 字段 | 描述 | ||

|---|---|---|---|

缓存模型包名称 |

导入的模型包名称。 |

||

使用工程 |

使用模型包的Mech-Vision工程。 |

||

模型包类型 |

模型包的类型,包括单模型包(“目标检测”、“文本识别”等)和多模型包。 |

||

运行模式 |

推理时模型包的运行模式,包括共享模式和性能模式。

|

||

硬件类型 |

使用模型包进行推理时使用的硬件的类型,包括GPU(默认)、GPU(优化)、CPU。

|

||

模型效率 |

可对模型包推理效率进行配置。 |

||

模型包状态 |

模型包的状态,包括 优化中…、优化失败、未加载、就绪 四种状态。

|

||

操作 |

可对模型包进行释放或删除操作。

|

常见操作

本节介绍深度学习模型包管理工具的常见操作。

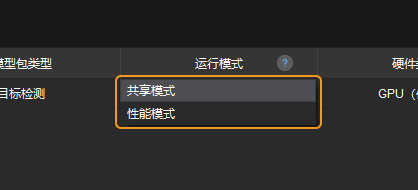

切换运行模式

如需切换模型包推理的运行模式,可在深度学习模型包管理工具的运行模式字段下单击![]() 按钮,然后选择共享模式或性能模式。

按钮,然后选择共享模式或性能模式。

|

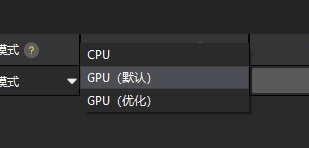

切换硬件类型

深度学习模型包推理的硬件类型可切换至 GPU(默认)、GPU(优化)或 CPU。

在深度学习模型包管理工具的硬件类型字段下单击![]() 按钮,然后选择GPU(默认)、GPU(优化)或CPU。

按钮,然后选择GPU(默认)、GPU(优化)或CPU。

|

配置模型效率

配置模型效率的流程如下:

-

确定要配置的深度学习模型包。

-

单击模型效率下方对应的配置按钮,在弹出的窗口中设置批量大小和精度。模型运行效率受批量大小和精度参数影响。

-

批量大小:模型推理时,一次性送入神经网络的图像数量,范围为 1~128。增大该值可以加快模型推理速度,但会占用较多显存。当该值设置不合理时,将导致推理速度变慢.

-

|

-

精度(仅硬件类型为GPU(优化)时可设置):

-

FP32:模型精度高,推理速度较慢。

-

FP16:模型精度低,推理速度较快。

-

错误排查

兼容性说明

-

Mech-Vision 2.2.0 及以上版本可使用Mech-DLK 2.5.4 及以上版本导出的深度学习模型包,支持 Mech-DLK 中所有算法模块,且可以导入和使用多模型包进行推理。但在实际使用中,可能会遇到以下兼容性问题:

-

快速定位模型不支持使用GPU(优化)的硬件类型。

-

导入 Mech-DLK 2.5.4 版本的模型包时,后处理界面的类别名称显示可能出现异常。例如,图像分类模型在推理配置工具的可视化配置中仅显示单个类别,无法正常显示全部类别。

-

-

Mech-Vision 1.7.1 可使用 Mech-DLK 2.4.1 及以上版本导出的深度学习模型包,但会存在以下兼容性问题。建议 Mech-Vision 1.7.2 及以上版本与 Mech-DLK 2.4.1 及更高版本导出的深度学习模型包配合使用。

-

Mech-Vision 无法使用级联模型包;

-

无法调整模型效率;

-

图像分类效果可能变差;

-

模型包无法在 CPU 设备上使用。

-

-

如果在 Mech-Vision 1.7.2 中使用 Mech-Vision 1.7.1 优化过的模型包,模型包在“深度学习模型包推理”步骤中首次运行时速度较慢。

-

当模型包推理时所使用的硬件类型为GPU(优化)时,需注意如下事项。

模型包在Mech-Vision 1.7.X 中未优化,在Mech-Vision 1.8.0 及以后版本对其优化后,则该模型包在Mech-Vision 1.7.X 中无法直接正常使用,需在深度学习模型包管理工具中单击打开缓存文件夹,将模型包对应的缓存文件夹删除,然后重新对模型包进行优化。

可通过 model_config.json 文件查看模型包对应的缓存文件夹。