Reconnaissance d’objets cibles dans des scénarios spécifiques

Cette section présente la manière de reconnaître des objets cibles dans des scénarios spécifiques.

Reconnaissance d’objets cibles dans des scénarios de desserte de machines

Scénario d’application

Seul l’appariement 3D est utilisé pour la reconnaissance des objets cibles. Les cloisons, bacs, etc., n’ont pas besoin d’être reconnus par un appariement non 3D ni par d’autres méthodes.

Guide d’utilisation

-

Utilisez l’éditeur d’objet cible pour configurer l’objet cible.

En fonction du type d’objet cible, sélectionnez un flux de configuration autre que « Aucun modèle de nuage de points requis » sur la page d’accueil de éditeur d’objet cible pour créer le modèle de nuage de points de l’objet cible.

-

Configurez le projet de vision.

-

Utilisez l’étape Appariement 3D ou Reconnaissance de l’objet cible 3D pour reconnaître les objets cibles.

Lors du réglage des paramètres, la sortie de l’Étape doit être définie en fonction de la symétrie de l’objet cible ou du nombre de points de préhension.

-

Si l’objet cible possède plusieurs points de préhension, il faut filtrer les points de préhension, et l’Étape doit sortir les points de préhension valides après filtrage.

-

Si l’objet cible est symétrique, l’orientation du point central de l’objet doit être ajustée et l’Étape doit sortir le point central de l’objet.

-

-

Utilisez l’outil d’ajustement de pose pour ajuster les poses de l’objet cible.

-

Paramétrez l’Étape Sortie.

Paramètre Valeur du paramètre Type de port

Prédéfini (résultat de vision)

Sélectionner le scénario

Appariement

Méthode de conversion des données

La valeur de ce paramètre doit correspondre à la sortie de l’étape b ci-dessus.

-

Si des points de préhension de l’objet cible sont produits à l’étape b, le paramètre « Méthode de conversion des données » de l’Étape « Sortie » doit être réglé sur « Générer une stratégie de préhension basée sur les points de préhension. »

-

Si des points centraux d’objet sont produits à l’étape b, le paramètre « Méthode de conversion des données » de l’Étape « Sortie » doit être réglé sur « Générer une stratégie de préhension basée sur le point central de l’objet. »

-

-

-

Exécutez le projet et sortez les poses de l’objet cible.

Reconnaissance d’objets cibles dans des scénarios de desserte de machines (avec cloisons ou bacs)

Scénario d’application

Les objets cibles doivent être reconnus par appariement 3D, et les cloisons ou bacs doivent être reconnus par l’Étape Calculer les poses et les dimensions à partir de nuages de points plans.

Guide d’utilisation

-

Utilisez l’éditeur d’objet cible pour configurer l’objet cible.

-

Sélectionnez un flux de configuration autre que « Aucun modèle de nuage de points requis » sur la page d’accueil de éditeur d’objet cible pour créer le modèle de nuage de points de l’objet cible.

-

Sélectionnez le flux de configuration « Aucun modèle de nuage de points requis » pour configurer les informations d’objet cible nécessaires à la prise dans les cloisons.

-

-

Configurez le projet de vision.

-

Scénarios à projets multiples:

Si la solution contient deux projets, utilisés respectivement pour la reconnaissance des objets cibles et celle des cloisons, veuillez configurer le projet de reconnaissance des cloisons comme suit.

Étape Paramètre Valeur du paramètre Sortie

Sélectionner le scénario

Autres

Objet cible sans modèle de nuage de points

Nom de l’objet cible pour la cloison

-

Scénarios à projet unique:

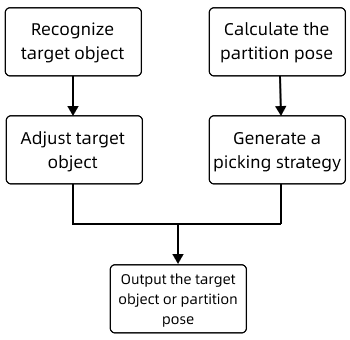

Si un seul projet est utilisé à la fois pour la reconnaissance des objets cibles et des cloisons, veuillez construire le projet comme illustré ci-dessous.

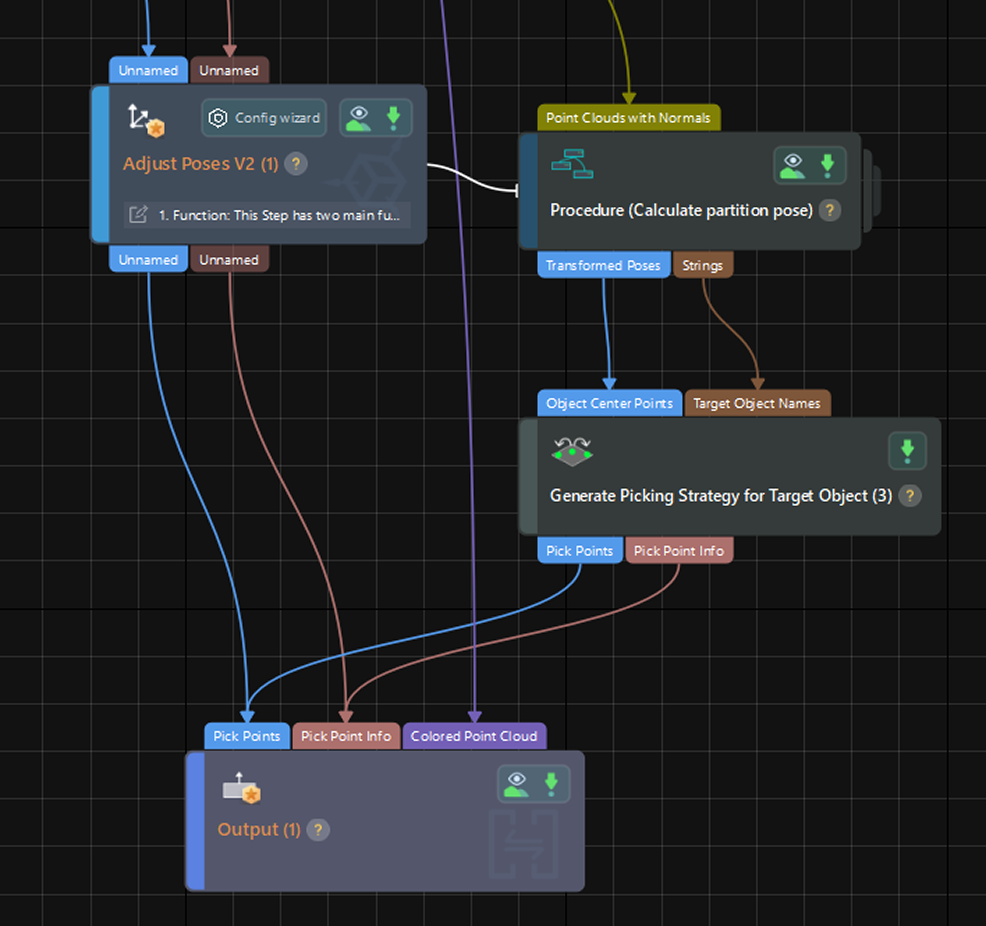

Le projet construit est présenté ci-dessous.

Étant donné que le nom d’objet cible fourni à l’Étape « Générer une stratégie de préhension pour l’objet cible » appartient à un objet cible enregistré via le processus « Aucun modèle de nuage de points requis » dans l’éditeur d’objet cible, le point de préhension doit être fourni directement à cette Étape, et le point de préhension en sortie sera identique au point de préhension en entrée.

Après avoir construit le projet, veuillez configurer le projet comme suit.

Étape Paramètre Instruction Étape « Appariement 3D » ou outil « Reconnaissance de l’objet cible 3D »

Seuil de confiance

Pour éviter les fausses reconnaissances et les faux négatifs, un Seuil de confiance approprié doit être défini.

Il est recommandé de régler ce paramètre sur la valeur par défaut et de vérifier d’abord le résultat d’exécution. Si une fausse reconnaissance se produit, il est recommandé d’augmenter ce paramètre ; si un faux négatif survient, il est recommandé de diminuer ce paramètre.Ajuster les poses V2

Déclencher le flux de contrôle en l’absence de sortie

Sélectionné

Continuer en l’absence de sortie

Désélectionner

Sortie

Type de port

Prédéfini (résultat de vision)

Sélectionner le scénario

Appariement

-

-

Exécutez le projet et sortez les poses de l’objet cible.

Reconnaissance d’objets cibles dans des scénarios de dépalletisation

Scénario d’application

Dans le scénario de dépalletisation, l’Étape Calculer les poses et les dimensions à partir de nuages de points plans est utilisée pour reconnaître les objets cibles, tandis que l’appariement 3D n’est pas utilisé.

Guide d’utilisation

-

Utilisez l’éditeur d’objet cible pour configurer l’objet cible.

En fonction du type d’objet cible, sélectionnez un flux de configuration autre que « Aucun modèle de nuage de points requis » sur la page d’accueil de éditeur d’objet cible pour configurer les informations d’objet cible nécessaires à la dépalletisation de cartons ou de sacs.

-

Configurez le projet de vision.

-

Utilisez une méthode sans appariement 3D pour reconnaître les objets cibles.

-

Paramétrez l’Étape Sortie.

Paramètre Valeur du paramètre Type de port

Prédéfini (résultat de vision)

Sélectionner le scénario

Dépalletisation

Autres entrées

Sélectionnez ce paramètre si vous devez sortir d’autres informations, telles que les dimensions de l’objet cible. Une fois cette option sélectionnée, de nouveaux ports d’entrée tels que « Dimensions de l’objet cible » seront ajoutés à l’Étape « Sortie ».

-

-

Exécutez le projet et sortez les poses de l’objet cible.

Reconnaissance d’objets cibles dans des scénarios « Prendre n’importe quoi »

Scénario d’application

Dans les scénarios où des objets variés doivent être saisis, l’Étape Prédire les points de préhension est utilisée pour reconnaître l’objet cible au lieu de l’Appariement 3D.

Guide d’utilisation

-

Utilisez l’éditeur d’objet cible pour configurer l’objet cible.

En fonction du type d’objet cible, sélectionnez « Aucun modèle de nuage de points requis » sur la page d’accueil de l’éditeur d’objet cible pour configurer les informations d’objet cible pour la préhension.

-

Configurez le projet de vision.

-

Utilisez l’Étape « Prédire les points de préhension » pour reconnaître les objets cibles.

-

Paramétrez l’Étape Sortie.

Paramètre Valeur du paramètre Type de port

Prédéfini (résultat de vision)

Sélectionner le scénario

Autres

Autres entrées

Sélectionnez ce paramètre si vous devez sortir les dimensions de l’objet cible. Une fois cette option sélectionnée, de nouveaux ports d’entrée tels que « Dimensions de l’objet cible » seront ajoutés à l’Étape « Sortie ».

-

-

Exécutez le projet et sortez les poses de l’objet cible.

Reconnaître des objets cibles avec des modèles de nuage de points externes

Scénario d’application

Approprié pour les scénarios où des modèles de nuage de points doivent être générés dynamiquement. Dans ce scénario, il existe différents types d’objets cibles, et tous les modèles de nuage de points ne peuvent pas être créés dans l’éditeur d’objet cible. De plus, les objets cibles sont des formes 3D courantes. Par exemple, un modèle de nuage de points peut être généré à partir d’une Étape ou d’un modèle STL.

Guide d’utilisation

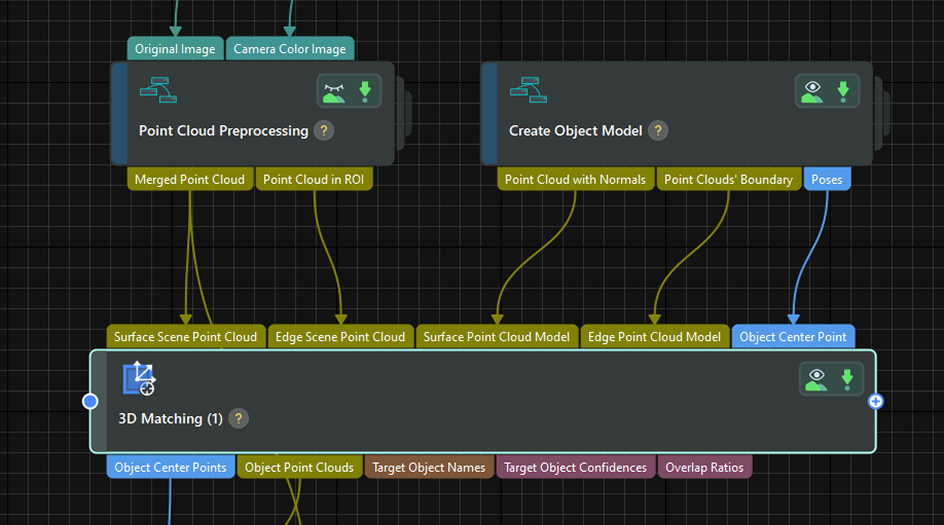

Dans ce scénario, vous devez sélectionner « Modèle externe » comme Type d’entrée dans l’Étape « Appariement 3D » pour lire le modèle de nuage de points généré par l’Étape « Créer un modèle d’objet », puis utiliser l’éditeur d’objet cible pour générer d’autres informations de l’objet cible en plus du modèle de nuage de points. Les instructions détaillées sont les suivantes.

-

Configurez le projet de vision.

-

Ajoutez une Étape Appariement 3D et définissez les paramètres.

Paramètre Valeur du paramètre Niveau de réglage des paramètres

« Avancé » ou « Expert »

Type d’entrée

Modèle externe

-

Ajoutez et connectez l’Étape utilisée pour générer le modèle de nuage de points.

Ajoutez et connectez au projet l’Étape utilisée pour générer le modèle de nuage de points. Par exemple, pour générer un modèle de nuage de points de disques de frein, vous pouvez utiliser l’Étape « Créer un modèle d’objet » pour générer dynamiquement un modèle de nuage de points en fonction des dimensions des disques de frein.

-

Donnez en entrée le modèle de nuage de points externe à l’Étape « Appariement 3D ».

-

Donnez en entrée le nuage de points de surface et le nuage de points de contours prétraités de la scène aux 1er et 2e ports d’entrée de l’Étape « Appariement 3D », respectivement.

-

Donnez en entrée le modèle de nuage de points de surface, le modèle de nuage de points de contours et le point central de l’objet ciblé générés aux 3e, 4e et 5e ports d’entrée de l’Étape « Appariement 3D », respectivement.

-

-

Paramétrez l’Étape Sortie.

Paramètre Valeur du paramètre Type de port

Prédéfini (résultat de vision)

Sélectionner le scénario

Autres

-

-

Utilisez l’éditeur d’objet cible pour générer des informations supplémentaires sur l’objet cible.

En fonction du type d’objet cible, sélectionnez « Aucun modèle de nuage de points requis » sur la page d’accueil de l’éditeur d’objet cible pour configurer l’objet cible et obtenir des informations d’objet cible autres que les modèles de nuage de points.

-

Exécutez le projet et sortez les poses de l’objet cible.