Configuration du projet de vision

Avant d’utiliser ce tutoriel, vous devez avoir créé une solution à l’aide du projet de cas « Loading Neatly Arranged Target Objects » dans la section Configuration de la communication du robot.

Dans ce tutoriel, vous apprendrez d’abord le flux de travail du projet, puis vous déploierez le projet en ajustant les paramètres des Étapes afin de reconnaître les poses des objets cibles et de produire le résultat de vision.

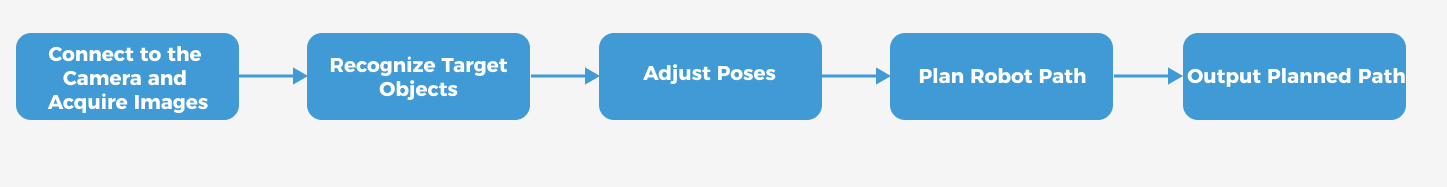

Introduction au flux de travail du projet

Dans ce tutoriel, vous devez configurer le projet de vision avec Mech-Vision. Le processus de configuration d’un projet de vision est présenté dans la figure ci-dessous.

Les phases du processus de configuration du projet de vision sont expliquées ci-dessous.

| Phase | Logiciel utilisé | Description |

|---|---|---|

Se connecter à la caméra et acquérir des images |

Mech-Vision |

Se connecter à la caméra via l’étape « Capturer des images depuis la caméra » de Mech-Vision pour la capture d’images. |

Reconnaître les objets cibles |

Mech-Vision |

Effectuer une série de traitements de vision (prétraitement du nuage de points, appariement 3D, etc.) sur les données d’image via l’étape « Reconnaissance d’objets 3D » de Mech-Vision afin de reconnaître rapidement les objets cibles. |

Ajuster les poses |

Mech-Vision |

Utiliser l’étape « Ajuster les poses V2 » du logiciel Mech-Vision pour transformer le repère de référence, ajuster les poses, trier les poses ou filtrer les poses sorties par l’étape « Reconnaissance d’objets 3D ». |

Planifier la trajectoire du robot |

Mech-Vision |

L’étape « Planification de trajectoire » du logiciel Mech-Vision planifiera dynamiquement une trajectoire de mouvement du robot sans collision en fonction des poses d’objets cibles ajustées à l’étape précédente. |

Sortie de la trajectoire planifiée |

Mech-Vision |

À la réception de la commande de l’Interface Standard par le robot (utilisée dans ce tutoriel) ou par l’automate, l’étape « Sortie » de Mech-Vision renvoie la trajectoire de mouvement du robot planifiée et sans collision.

|

Ajuster les paramètres des étapes

Dans cette section, vous déploierez le projet en ajustant les paramètres de chaque Étape.

| Le projet de cette section est le projet « Vis_Target_Objects_Recognition » dans la solution « Loading Neatly Arranged Target Objects ». |

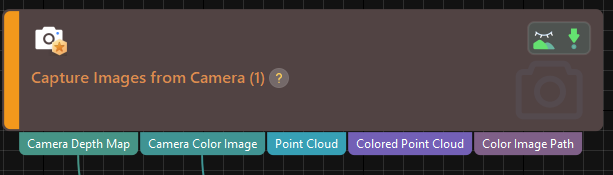

Capturer des images depuis la caméra

Nom de l’étape |

Capturer des images depuis la caméra |

|---|---|

Phase |

Se connecter à la caméra et acquérir des images |

Illustration |

|

Description |

Se connecter à une caméra réelle et configurer les paramètres pertinents pour garantir que la caméra puisse capturer correctement des images. |

-

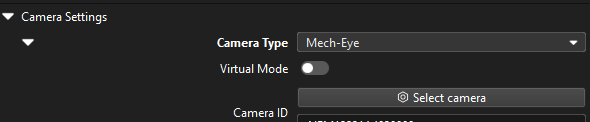

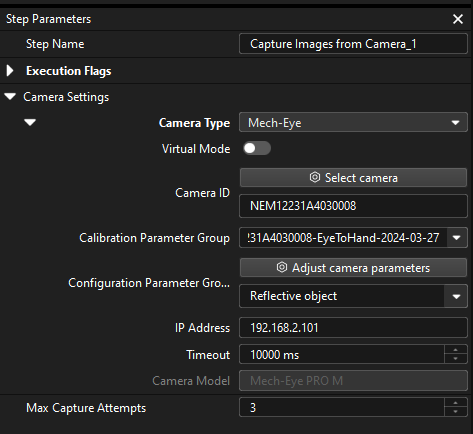

Dans l’Espace de programmation graphique de Mech-Vision, sélectionnez l’étape Capturer des images depuis la caméra, et cliquez sur Sélectionner la caméra dans l’onglet Paramètres de l’étape.

-

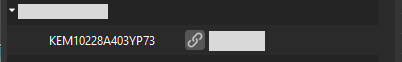

Dans la fenêtre Sélectionner la caméra et le groupe de paramètres de calibration qui s’affiche, cliquez sur l’icône

à droite du numéro de série de la caméra. Lorsque cette icône devient

à droite du numéro de série de la caméra. Lorsque cette icône devient  , la caméra est connectée avec succès.

, la caméra est connectée avec succès.

Après la connexion de la caméra, cliquez sur le bouton Sélectionner le groupe de paramètres et sélectionnez le groupe de paramètres calibrés avec ETH/EIH et date.

Le groupe de paramètres de calibration sélectionné ici est celui généré après l’achèvement de la calibration main-œil. -

Après la connexion de la caméra et la sélection du groupe de paramètres, le groupe de paramètres de calibration, l’adresse IP et les ports de la caméra seront obtenus automatiquement. Assurez-vous que Groupe de paramètres de configuration est défini sur « Reflective object ».

-

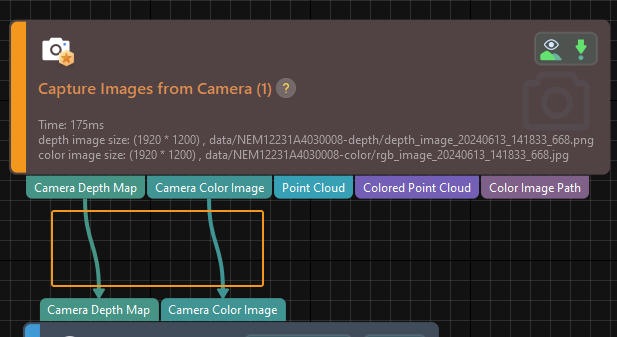

Cliquez sur le bouton d’exécution d’une seule étape de l’étape Capturer des images depuis la caméra pour déclencher la capture d’images, double-cliquez sur les flux de données « Carte de profondeur de la caméra » et « Image couleur de la caméra » de l’étape, et vérifiez si les images ont été capturées avec succès depuis la caméra dans la fenêtre Sortie de débogage.

-

Si vous pouvez voir une carte de profondeur et une image couleur normales dans la fenêtre Sortie de débogage, le logiciel Mech-Vision s’est connecté avec succès à la caméra réelle et peut capturer correctement des images.

Reconnaissance d’objets 3D

Nom de l’étape |

Reconnaissance d’objets 3D |

|---|---|

Phase |

Reconnaître les objets cibles |

Illustration |

|

Description |

Vous devez définir les paramètres de prétraitement du nuage de points, créer des modèles d’objets cibles dans l’éditeur d’objet cible, sélectionner l’objet cible, définir les paramètres de reconnaissance et configurer les ports de sortie. |

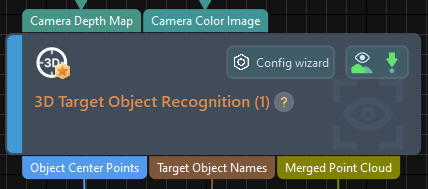

L’étape « Reconnaissance d’objets 3D » fournit un outil visuel « Reconnaissance d’objets 3D » intégré. Avec l’assistant, vous pouvez facilement reconnaître les poses des objets cibles en seulement trois étapes.

Vous pouvez commencer l’ajustement des paramètres en ouvrant l’outil « Reconnaissance d’objets 3D » de l’une des manières suivantes.

-

Cliquez sur le bouton Assistant de configuration sur le bloc d’Étape dans l’Espace de programmation graphique.

-

Dans l’onglet Paramètres de l’étape, cliquez sur le bouton Assistant de configuration.

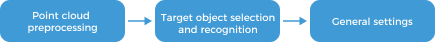

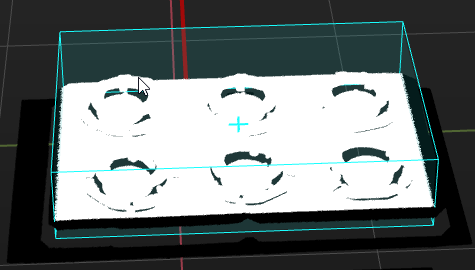

Prétraitement du nuage de points

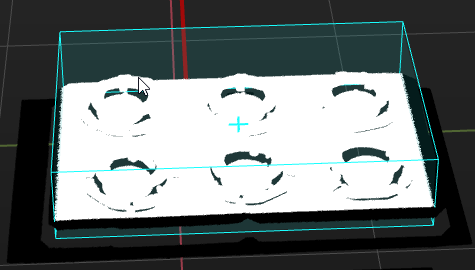

Le prétraitement du nuage de points convertit les données d’image acquises en nuages de points, détecte les nuages de points de bord et filtre les nuages de points qui ne respectent pas les règles en définissant des régions de reconnaissance de nuage de points valides, améliorant ainsi l’efficacité de la reconnaissance ultérieure.

Dans cette étape, vous devez définir une région de reconnaissance efficace pour maintenir les facteurs d’interférence hors de la région afin d’améliorer l’efficacité de la reconnaissance. La zone de reconnaissance doit couvrir la palette et les objets cibles qui s’y trouvent. Elle doit avoir une largeur de 20 à 30 mm pour tenir compte des effets de petites variations dans le placement de la palette.

En général, conservez les valeurs par défaut des autres paramètres de prétraitement. S’il y a beaucoup de bruit dans la scène, vous pouvez essayer d’ajuster les paramètres pertinents. Pour plus de détails, reportez-vous à Prétraitement du nuage de points.

| Après l’ajustement des paramètres, vous pouvez cliquer sur le bouton Exécuter l’étape dans la zone Prévisualiser le résultat du prétraitement, et confirmer que l’effet du prétraitement correspond aux attentes dans l’Espace de visualisation. |

Sélection et reconnaissance de l’objet cible

|

Créer le modèle d’objet cible

Dans ce tutoriel, veuillez vous référer à Définir les points de prise en déplaçant manuellement le robot, et générer le modèle de nuage de points à partir du nuage de points acquis pour créer le modèle d’appariement de nuage de points pour l’objet cible.

|

Pour des besoins de simulation uniquement, vous pouvez utiliser la pose suivante comme poses du point de prise définies par apprentissage :

Lors du réglage des poses du point de prise, sélectionnez « angles d’Euler » comme orientation de la pose. |

Précautions :

-

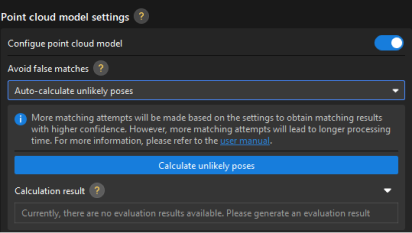

Dans cet exemple, les objets cibles sont symétriques. Pour éviter les erreurs causées par une rotation avant la prise, vous devez configurer les paramètres Éviter les fausses correspondances pour filtrer les poses d’appariement présentant de grands écarts angulaires par rapport au modèle. Dans l’onglet 3 Éditer le modèle de l’éditeur d’objet cible, dans la zone Paramètres du modèle de nuage de points, activez l’option Configurer le modèle de nuage de points, et définissez le paramètre Éviter les fausses correspondances sur « Calculer automatiquement les poses improbables ». Les résultats du calcul sont utilisés pour filtrer rapidement les poses qui ne respectent pas l’exigence d’angle pour l’appariement ultérieur du nuage de points.

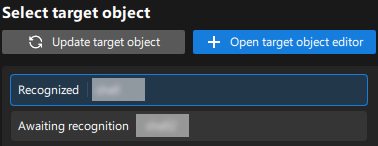

Après la création du modèle d’objet cible, fermez la fenêtre Éditeur d’objet cible pour revenir à l’interface de l’outil « Reconnaissance d’objets 3D », et cliquez sur le bouton Mettre à jour l’objet cible. S’il n’y a qu’un seul modèle d’objet cible dans l’éditeur d’objet cible de la solution, l’outil sélectionnera automatiquement le modèle d’objet cible. S’il y a plusieurs modèles d’objet cible dans l’éditeur d’objet cible de la solution, veuillez sélectionner le modèle d’objet cible à utiliser.

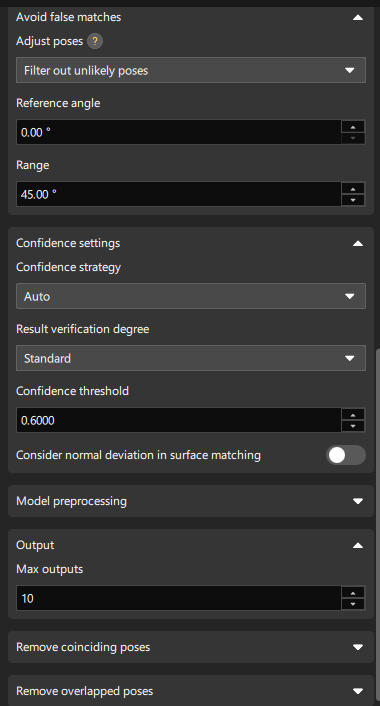

Définir les paramètres d’appariement

-

Dans la zone Reconnaître l’objet cible, activez l’option Définir automatiquement le mode d’appariement pour le mode d’appariement.

-

Activez le Mode avancé et l’appariement extra fin.

En raison des exigences élevées de précision de prise de cette application, vous devez activer le Mode avancé et l’appariement extra fin pour améliorer davantage la précision de l’appariement. -

Ajoutez le paramètre « Éviter les fausses correspondances » : Sélectionnez « Filtrer les poses improbables » et définissez Plage à 45°.

Étant donné que les objets cibles de cette application sont symétriques à 90°, le paramètre Plage doit être défini sur 45° afin que les poses d’appariement sorties soient plus proches du centre géométrique du modèle. Les poses d’appariement avec des écarts d’angle du modèle supérieurs à plus ou moins 45° sont supprimées, réduisant ainsi les erreurs de prise. -

Modifiez le seuil de confiance : Définissez Seuil de confiance selon les besoins réels, par exemple 0.6, afin d’éliminer les résultats d’appariement incorrects.

-

Définissez Nombre maximal de sorties selon les besoins réels, par exemple 10. Minimisez le nombre de sorties pour réduire le temps d’appariement tout en satisfaisant les exigences de planification de trajectoire.

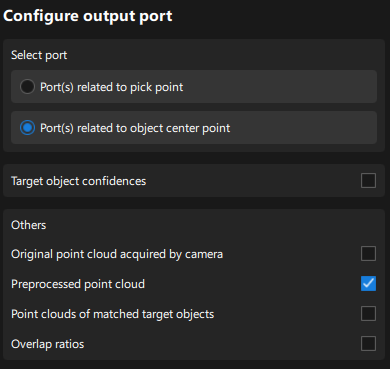

Configurer les ports de sortie

Sélectionnez les ports de sortie suivants pour la planification de trajectoire et la détection de collision ultérieures :

-

Port(s) liés au point central de l’objet

Les types de ports de sortie sont décrits comme suit :

-

Port(s) liés au point de prise : adaptés aux objets cibles avec plusieurs points de prise devant être filtrés.

-

Port(s) liés au point central de l’objet : adaptés aux objets cibles symétriques nécessitant un ajustement d’orientation du point central de l’objet.

-

-

Nuage de points prétraité (pour la planification de trajectoire du robot ultérieure)

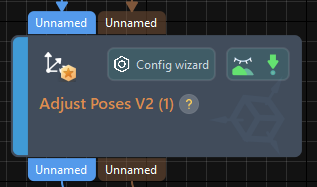

Ajuster les poses V2

Nom de l’étape |

Ajuster les poses V2 |

|---|---|

Phase |

Ajuster les poses |

Illustration |

|

Description |

Définir des paramètres pour transformer les poses, ajuster les poses, trier les poses et filtrer les poses. |

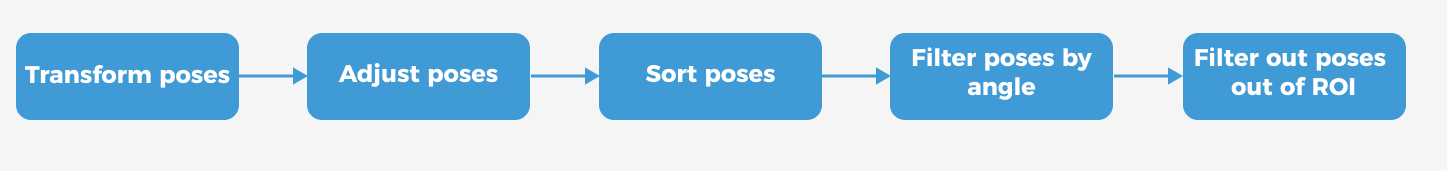

Après avoir obtenu la pose de l’objet cible, vous devez ajuster la pose. La procédure de traitement est la suivante.

Avec l’outil d’ajustement de pose intégré dans Mech-Vision, vous pouvez facilement ajuster les poses d’objets et optimiser la séquence de prise. Vous pouvez commencer l’ajustement des paramètres en ouvrant l’outil d’ajustement de pose de l’une des manières suivantes.

-

Cliquez sur le bouton Assistant de configuration sur le bloc d’Étape dans l’Espace de programmation graphique.

-

Dans l’onglet Paramètres de l’étape, cliquez sur le bouton Assistant de configuration.

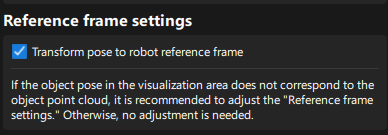

Suivez ces étapes pour ajuster les paramètres :

-

Transformer les poses : Dans l’onglet Ajustement de la pose, transformez les poses du repère de référence de la caméra vers le repère de référence du robot.

-

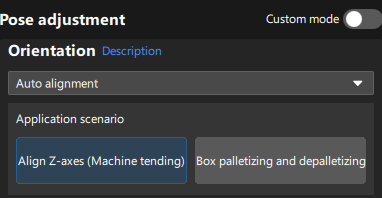

Ajuster les poses : Dans l’onglet Ajustement de la pose, définissez Orientation sur « Alignement automatique » et sélectionnez le scénario Aligner les axes Z (alimentation de machine). Cette opération aligne autant que possible l’orientation de l’axe Z de la pose avec la direction positive du repère de référence du robot.

-

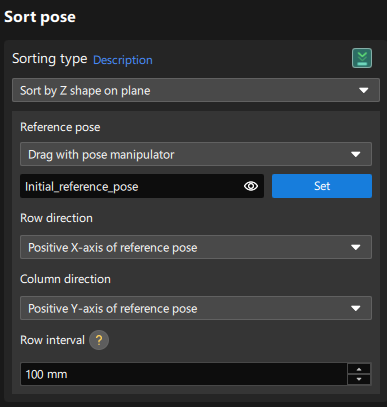

Trier les poses : Dans l’onglet Règles de traitement, sélectionnez le type de tri « Trier par forme en Z sur le plan », et définissez la pose de référence avec le manipulateur. Sélectionnez « Axe X positif de la pose de référence » pour Direction des lignes et « Axe Y positif de la pose de référence » pour Direction des colonnes, et définissez l’intervalle de ligne selon les besoins.

Dans cette application, étant donné que les objets cibles sont soigneusement disposés, la prise robot des objets cibles dans un ordre en « Z » depuis le coin supérieur gauche offre les meilleures performances.

-

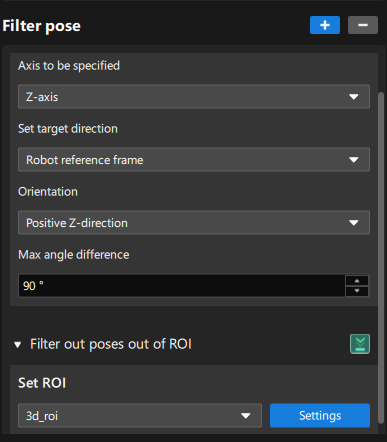

Filtrer les poses selon l’angle : Dans l’onglet Règles de traitement, filtrez les poses manifestement impossibles à prendre en fonction de leurs directions d’axe Z, ce qui réduit le temps consacré à la planification de trajectoire pour l’étape « Planification de trajectoire ».

-

Filtrer les poses hors de la ROI : Dans l’onglet Règles de traitement, définissez une ROI pour déterminer si les poses sont dans la ROI et conserver uniquement les poses dans la ROI.

La région cible (3d_roi) est dans le repère de référence du robot. Pour éviter les erreurs de filtrage, vous devez réinitialiser la région cible selon les paramètres extrinsèques réels.

-

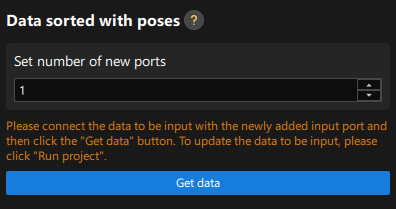

Définir de nouveaux ports : Définissez le paramètre Définir le nombre de nouveaux ports sur 1 afin de sortir les noms des objets cibles correspondant aux poses triées pour la détection de collision ultérieure. Revenez à l’espace de programmation graphique et vous constaterez qu’un nouveau port d’entrée et un nouveau port de sortie ont été ajoutés à cette Étape pour recevoir et sortir les noms des objets cibles. Veuillez connecter les ports d’entrée et de sortie, revenir à l’outil d’ajustement de pose, et cliquer sur le bouton Obtenir les données pour confirmer que les paramètres ont été correctement obtenus.

Planification de trajectoire

Cet exemple obtient la trajectoire planifiée à partir de l’étape « Planification de trajectoire » de Mech-Vision. Lors de l’utilisation du mode de communication Interface Standard, le projet et le côté robot doivent coopérer pour mettre en œuvre le processus de prise et de dépose robot guidé par vision 3D. Pour plus de détails, reportez-vous aux instructions dans la section « Prise et dépose ».

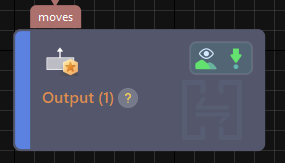

Sortie

Nom de l’étape |

Sortie |

|---|---|

Phase |

Sortie de la trajectoire planifiée |

Illustration |

|

Description |

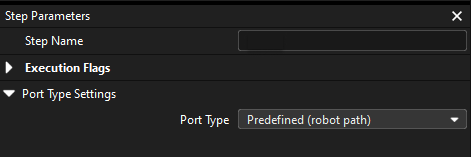

Vous devez basculer le port pour sortir la trajectoire du robot vers le robot. |

Veuillez définir Type de port sur « Prédéfini (trajectoire du robot) ».

Vous avez maintenant terminé la configuration du projet de vision.