Reconnaissance d’objet cible 3D (matériau hautement réfléchissant)

Ce tutoriel vous montrera comment reconnaître avec précision les poses d’objets cibles hautement réfléchissants disposés de manière ordonnée. En prenant le projet « Reconnaissance d’objet cible 3D (matériau hautement réfléchissant) » comme exemple, cette section explique comment ajuster les paramètres de l’Étape Reconnaissance d’objet cible 3D et met en avant les points clés à considérer pour l’application pratique.

Scénario d’application |

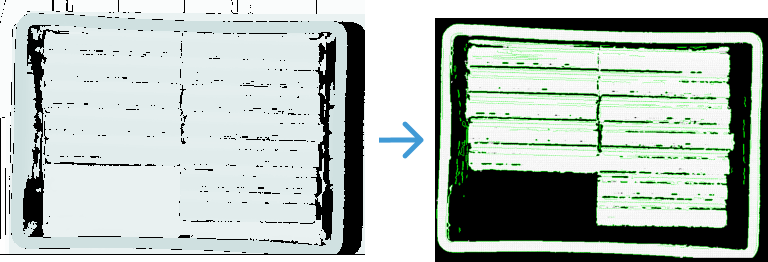

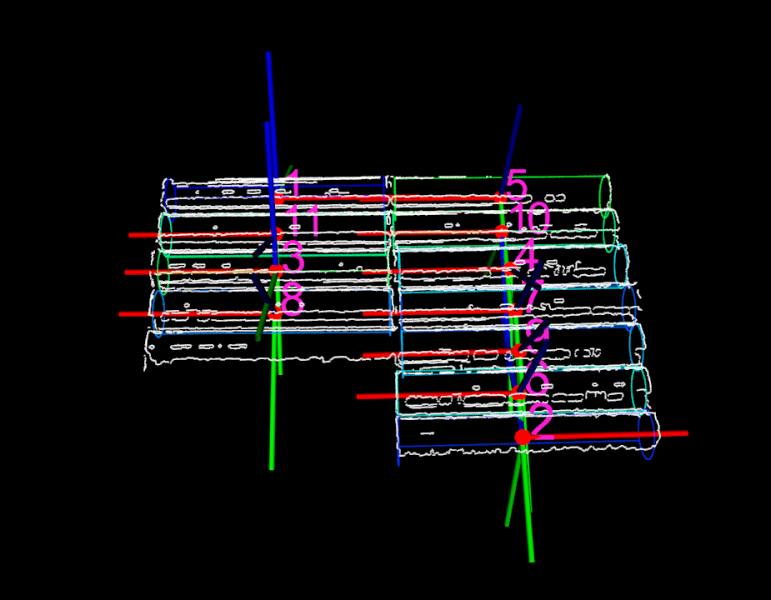

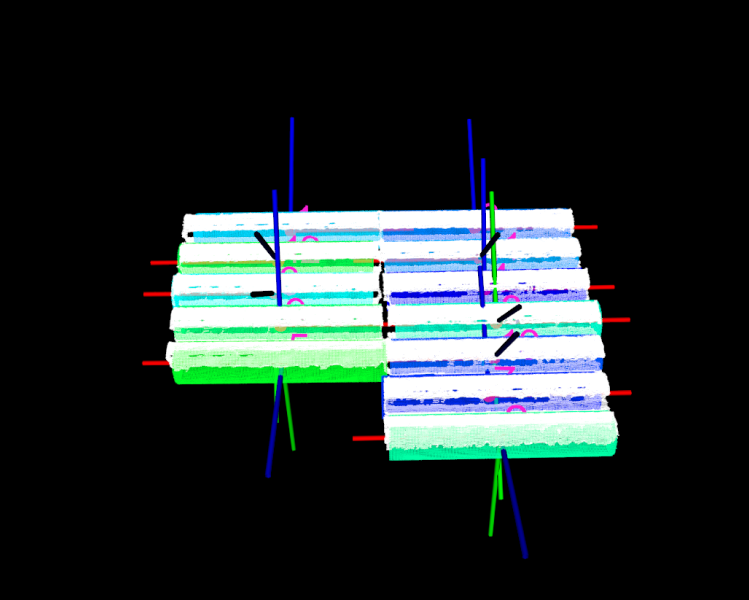

Résultat de la reconnaissance |

|

|

Ce qui suit présente les consignes d’application du projet d’exemple et les points clés pour une mise en œuvre pratique.

Guide d’application

Dans la bibliothèque de solutions de Mech-Vision, vous pouvez trouver la solution « Reconnaissance d’objet cible 3D (matériau hautement réfléchissant) » sous la catégorie « Localisation 3D » des « Exemples pratiques » et créer la solution avec un projet « Reconnaissance d’objet cible 3D (matériau hautement réfléchissant) ». Ensuite, sélectionnez l’Étape Reconnaissance d’objet cible 3D puis cliquez sur le bouton Assistant de configuration dans le panneau Paramètres de l’Étape pour ouvrir l’outil « Reconnaissance d’objet cible 3D » et apprendre à ajuster les paramètres. Le flux de travail comprend trois processus, à savoir le prétraitement du nuage de points, la sélection et la reconnaissance de l’objet cible, et les paramètres généraux.

-

Prétraitement du nuage de points : Utilisez ce processus pour convertir les données d’image acquises en nuages de points, définir une région de reconnaissance valide, détecter les nuages de points de bord et filtrer les nuages de points qui ne répondent pas aux exigences. Ce processus peut aider à améliorer la précision de reconnaissance du processus suivant.

-

Sélection et reconnaissance de l’objet cible : Après avoir créé le modèle de l’objet cible et les points de prise, décidez s’il faut configurer le paquet de modèle d’apprentissage profond et ajustez les paramètres de reconnaissance de l’objet cible en fonction de la stratégie de reconnaissance visuelle utilisée. Assurez-vous que les paramètres configurés répondent aux exigences de précision opérationnelle afin que la solution de reconnaissance d’objets puisse reconnaître les objets cibles de manière stable et précise.

-

Paramètres généraux : Configurez les ports de sortie dans ce processus en sélectionnant les données pour les points de prise ou les points centraux de l’objet en fonction des exigences des tâches de prélèvement ultérieures.

Ce qui suit présente les principaux paramètres à ajuster dans chaque processus.

Prétraitement du nuage de points

-

Définir la zone de reconnaissance.

Définissez une zone de reconnaissance (ROI 3D). La zone doit couvrir entièrement l’objet cible, avec une marge supplémentaire tout autour du périmètre.

-

Dans la plupart des cas, conservez les valeurs par défaut de ces paramètres. Si le bruit reste présent dans le nuage de points de la scène, essayez d’ajuster les paramètres pertinents pour filtrer le bruit.

Aucun autre paramètre n’a besoin d’être ajusté dans ce projet d’exemple. Vous pouvez cliquer sur le bouton Suivant pour passer au processus « Sélection et reconnaissance de l’objet cible » après avoir défini la zone de reconnaissance.

Sélection et reconnaissance de l’objet cible

Après le prétraitement du nuage de points, vous devez créer un modèle de nuage de points de l’objet cible dans l’éditeur d’objet cible, puis définir les paramètres de correspondance pour la mise en correspondance du modèle de nuage de points.

-

Créer un modèle d’objet cible.

Cliquez sur le bouton Ouvrir l’éditeur d’objet cible pour ouvrir l’éditeur, générer un modèle de nuage de points basé sur des formes 3D courantes. Ensuite, cliquez sur le bouton Enregistrer pour revenir à l’interface de l’outil « Reconnaissance d’objet cible 3D », puis cliquez sur le bouton Mettre à jour l’objet cible pour sélectionner le modèle d’objet cible créé et l’appliquer afin de reconnaître les poses des objets cibles.

Vous devez mesurer à l’avance les dimensions de l’objet cible. Lors de la génération d’un modèle de nuage de points basé sur des formes 3D courantes, renseignez le Rayon et la Hauteur de l’objet cible sous Définir les paramètres géométriques dans la fenêtre contextuelle Ajouter un objet cible. -

Assister la reconnaissance avec l’apprentissage profond.

Importez et sélectionnez le paquet de modèle d’apprentissage profond (lien téléchargeable ici), définissez le ROI, et réglez le Seuil de confiance de la Segmentation d’instance à 0.30 dans la fenêtre Configurer l’inférence. Ce réglage permet de filtrer les résultats à faible confiance et les résultats de segmentation probablement médiocres ; les résultats au-dessus de ce seuil seront conservés.

Lors du réglage du ROI, assurez-vous qu’il y a une marge supplémentaire autour du bac dans la zone. De cette façon, la reconnaissance assistée par l’apprentissage profond peut obtenir de meilleurs résultats et l’influence des fluctuations de position des objets peut être éliminée. -

Définir les paramètres liés à la reconnaissance d’objet.

Les instructions suivantes sur l’ajustement des paramètres sont données à titre indicatif uniquement. Veuillez ajuster chaque paramètre en fonction de la situation sur site. -

Activer le Mode avancé sur le côté droit de Reconnaître l’objet cible.

-

Définir le mode de correspondance : Pour ce projet, lorsque l’option Mode de correspondance défini automatiquement est activée, la précision de reconnaissance peut ne pas répondre aux exigences sur site. Par conséquent, il est recommandé de désactiver cette option et d’ajuster manuellement les paramètres pertinents.

Si la précision de correspondance ne répond pas aux attentes, par exemple en cas de fortes fluctuations du nuage de points aux bords, vous devez définir à la fois le Mode de correspondance grossier et le Mode de correspondance fin sur Correspondance de surface afin d’améliorer la précision de reconnaissance.

Mode de correspondance défini automatiquement

Définir manuellement les paramètres pertinents

-

Ajuster les paramètres de correspondance fine : Pour améliorer la précision de reconnaissance, définissez le Mode de performance sur Haute précision et la Capacité de correction de déviation sur Moyenne.

-

Définir le seuil de confiance : Réglez le Seuil de confiance de sorte que les objets placés au sommet puissent être reconnus. Dans ce projet, lorsque la Stratégie de confiance est définie sur Auto, la précision de reconnaissance peut satisfaire les exigences sur site. Par conséquent, définissez simplement ce paramètre sur Auto et réglez le Seuil de confiance, dont la valeur par défaut est 0.3000.

Dans la section des résultats de reconnaissance en bas de la fenêtre de visualisation à gauche, sélectionnez Résultat de sortie dans le premier menu déroulant. Les objets cibles dont la valeur de Confiance de la correspondance de surface dépasse le seuil défini seront conservés. Veuillez vérifier le résultat de reconnaissance selon la situation réelle. En cas de fausse reconnaissance ou de faux négatif, augmentez ou diminuez respectivement le seuil. -

Sorties max sous « Sortie » : Définissez la valeur de ce paramètre sur le nombre d’objets cibles lorsqu’ils sont complètement empilés. Dans ce projet, les Sorties max sont définies sur 14.

-

Après ce qui précède, cliquez sur le bouton Suivant pour aller à la page des paramètres généraux et configurer les ports de sortie.

Paramètres généraux

Après la reconnaissance de l’objet cible, vous pouvez configurer des fonctions auxiliaires autres que la reconnaissance visuelle. Actuellement, seul le paramétrage des sorties de port est pris en charge, ce qui peut fournir des résultats de vision et des nuages de points pour les Étapes suivantes.

Pour garantir que les objets puissent être saisis avec succès par le robot, vous devez ajuster le point central de l’objet afin que son axe Z pointe vers le centre du bac. Sous Sélectionner le port, sélectionnez Port(s) liés au point central de l’objet. Puis, sélectionnez l’option Nuage de points original acquis par la caméra et l’option Nuage de points prétraité. Les données de nuage de points de sortie seront utilisées pour la détection de collision et la localisation du bac dans la planification de trajectoire.

| S’il y a d’autres besoins sur site, configurez les ports de sortie pertinents en fonction des besoins réels. |

Vous avez maintenant ajusté les paramètres pertinents. Cliquez sur le bouton Enregistrer pour enregistrer les modifications.

Principales considérations pour l’application

Dans les applications réelles, vous devez comprendre et considérer ce qui suit, puis ajouter l’étape Reconnaissance d’objet cible 3D à votre projet et connecter les ports de données pour reconnaître rapidement et précisément les poses des objets cibles.

-

L’étape « Reconnaissance d’objet cible 3D » est généralement utilisée conjointement avec l’étape Capture d’images depuis la caméra. Cette étape est adaptée aux scénarios de chargement de pièces. Elle est capable de reconnaître des pièces de différentes formes et méthodes d’empilage, y compris des dispositions séparées, un empilage ordonné en une seule couche, un empilage ordonné en plusieurs couches et un empilage aléatoire.

-

L’étape « Reconnaissance d’objet cible 3D » est généralement suivie d’une étape de correction de pose, telle que l’étape Ajuster les poses V2.

Ce projet d’exemple vise à montrer comment identifier avec précision les poses des objets cibles lorsqu’ils sont soigneusement disposés; il omet donc le processus de correction de pose.