Chargement d’objets cibles disposés de manière ordonnée guidé par vision

Ce tutoriel présente la manière de déployer une application de prélèvement structuré guidée par vision 3D, en utilisant le cas de modèle d’application « Chargement d’objets cibles disposés de manière ordonnée » dans la Bibliothèque de solutions.

Scénario d’application : le système de vision 3D guide le robot pour saisir et déposer des pièces disposées de manière ordonnée depuis la palette vers la ligne de convoyage/plateforme de positionnement secondaire.

Vue d’ensemble de l’application

-

Objet cible : des objets cibles placés de manière ordonnée. L’application utilise des boîtiers comme exemple.

-

Cette application définit le point de prise par enseignement (teach-in), puis utilise la caméra pour acquérir le nuage de points de l’objet réel afin de créer le modèle d’objet cible.

-

Cette application utilise une caméra réelle pour capturer des images des boîtiers en vue de la reconnaissance des objets cibles. Si vous souhaitez utiliser une caméra virtuelle, veuillez cliquer ici pour télécharger les données d’images des boîtiers.

-

-

Caméra : caméra Mech-Eye PRO M-GL, montée en mode eye-to-hand (ETH).

-

Plaque de calibration : lorsque la distance de travail est de 1000 à 1500 mm, il est recommandé d’utiliser la plaque de calibration CGB-035 ; lorsque la distance de travail est de 1500 à 2000mm, il est recommandé d’utiliser la plaque de calibration CGB-050.

-

Robot : un robot à six axes. Cette application utilise KUKA_KR_10_R1100_2_HO comme exemple.

-

IPC : Mech-Mind IPC STD

-

Logiciel : Mech-Vision 2.1.2, Mech-Eye Viewer 2.5.4

-

Solution de communication : communication Standard Interface, dans laquelle le système de vision transmet le chemin planifié par le logiciel Mech-Vision.

-

Outil terminal : pince

Pour cette application, vous devez préparer un fichier modèle au format .obj pour la pince, qui sera utilisé pour la détection de collision lors de la planification du trajet. Vous pouvez le télécharger en cliquant ici.

-

Objet de scène : modèle d’objet de scène

Cette application nécessite un fichier de modèle de scène au format .stl, utilisé pour simuler une scène réelle et pour la détection de collision lors de la planification du trajet. Vous pouvez le télécharger en cliquant ici.

|

Si vous utilisez un modèle de caméra, une marque de robot ou un objet cible différent de ceux de cet exemple, veuillez vous référer aux informations de référence fournies dans les étapes correspondantes pour effectuer les ajustements. |

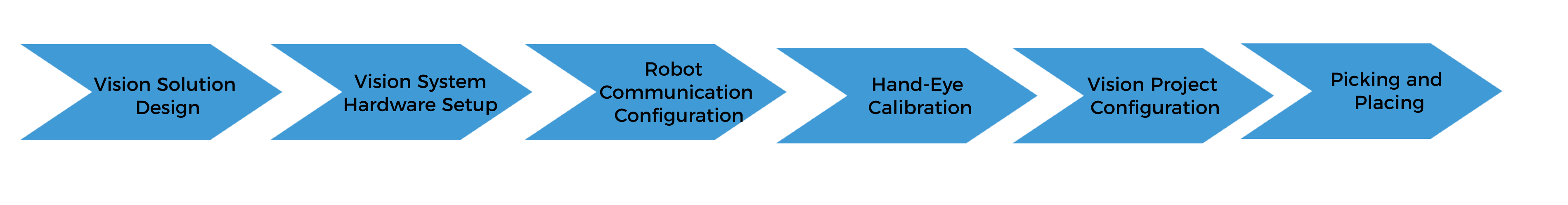

Déployer une application robotique guidée par vision

Le déploiement de l’application robotique guidée par vision peut être divisé en six phases, comme indiqué sur la figure ci-dessous :

Le tableau suivant décrit les six phases du déploiement d’une application robotique guidée par vision.

| N° | Phase | Description |

|---|---|---|

1 |

Conception de la solution de vision |

Sélectionnez le modèle matériel selon les exigences du projet, déterminez le mode de montage, la méthode de traitement de vision, etc. (Ce tutoriel propose une solution de vision correspondante, vous n’avez pas besoin de la concevoir vous-même.) |

2 |

Installez et connectez le matériel du système de vision Mech-Mind. |

|

3 |

Chargez le programme Standard Interface du robot et les fichiers de configuration dans le système du robot afin d’établir la communication Standard Interface entre le système de vision Mech-Mind et le robot. |

|

4 |

Effectuez la calibration œil-main automatique dans une configuration eye-to-hand afin d’établir la relation de transformation entre le repère de la caméra et le repère du robot. |

|

5 |

Utilisez le modèle d’application « Loading Neatly Arranged Target Objects » dans la Bibliothèque de solutions Mech-Vision et planifiez la trajectoire du robot avec l’étape « Planification de trajectoire ». |

|

6 |

Sur la base du programme d’exemple du robot MM_S3_Vis_Path, écrivez un programme de prise et dépose adapté aux applications sur site. |

Ensuite, suivez les sections suivantes pour compléter le déploiement de l’application.