ディープラーニングモデルパッケージを推論

|

Mech-Vision 1.7.2バージョン以降、「ディープラーニングモデルパッケージを推論(CPU)」と「ディープラーニングモデルパッケージを推論(Mech-DLK2.2.0+)」ステップは、「ディープラーニングモデルパッケージを推論」に統合されます。「ディープラーニングモデルパッケージを推論」ステップは、.dlkpackCモデルと.dlkpackモデルの両方をサポートします。 Mech-Vision 1.7.2バージョンで過去バージョンのプロジェクトを開くと、「ディープラーニングモデルパッケージを推論(CPU)」と「ディープラーニングモデルパッケージを推論(Mech-DLK 2.2.0+)」ステップは自動的に「ディープラーニングモデルパッケージを推論」に置き換わります。 |

機能

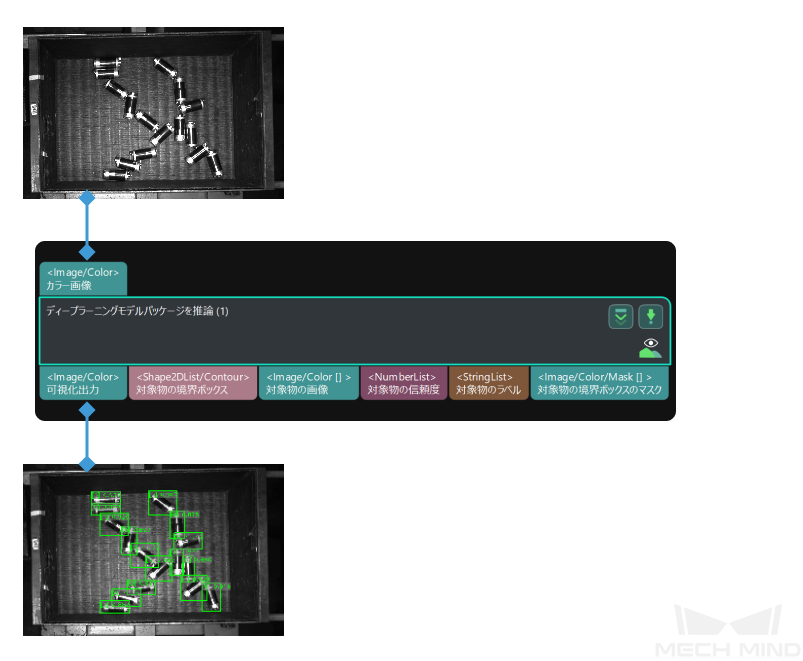

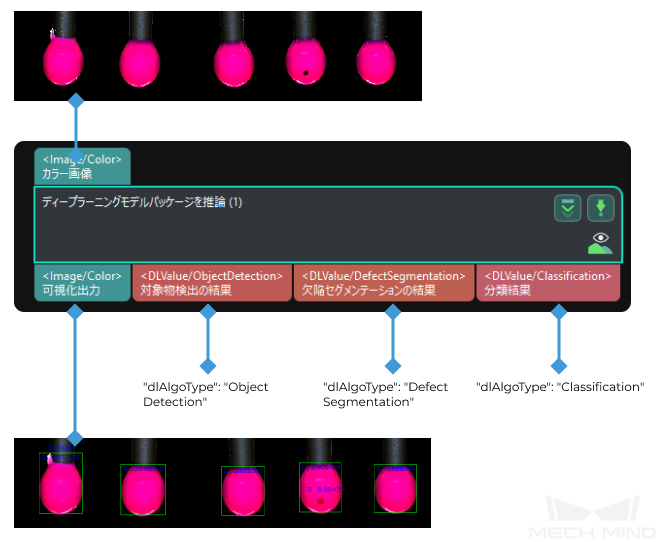

このステップはMech-DLKによってエクスポートされた単体モデルまたは直列モデルに対して推論を行い、推論結果を出力することができます。Mech-DLK 2.2.0以降バージョンによってエクスポートされたモデルパッケージのみ対応しています。

|

Mech-DLK 2.4.1以降、モデルパッケージには、単体モデルと直列モデルの2種類があります。

このステップが直列モデルの推論を行う場合、直列モデルの推論結果は ディープラーニング結果を解析 ステップで解析することができます。 |

使用シーン

このステップは通常、画像分類、対象物検出、欠陥セグメンテーションなどのシーンに使用されます。このステップの互換性については、 ディープラーニングステップの互換性に関する説明 をご参照ください。

システム要件

このステップを使用する場合、以下のシステム要件を満たす必要があります。

-

CPU:AVX2命令セットをサポートし、以下のいずれかの条件を満たす必要があります。

-

ディスクリートGPU非搭載の場合:Intel i5-12400以上。

-

ディスクリートGPU搭載の場合:Intel i7-6700以上、GTX 1050 Ti以上(GPU)。

-

-

GPU:NVIDIA GTX 1050TI以上(ディスクリートGPU搭載の場合)。

パラメータ説明

|

このステップで直列モデルの推論を行う場合、その後の「ディープラニング結果を解析」ステップでパラメータを調整することができます。 |

共通パラメータ

モデルパッケージの設定

- モデルパッケージ管理ツールを開く

-

パラメータ説明:ディープラーニングモデルパッケージ管理ツールを開き、ディープラーニングモデルパッケージをインポートするために使用されます。モデルパッケージファイルとは、Mech-DLKによってエクスポートされた「.dlkpack」または「.dlkpackC」を指します。

調整説明:ディープラーニングモデルパッケージ管理ツールの使用方法については、 ディープラーニングモデルパッケージ管理ツール をご参照ください。

- モデルパッケージ名

-

パラメータ説明:このパラメータは、ディープラーニングモデルパッケージをインポートした後、インポートしたモデルパッケージを選択するために使用されます。

調整説明:モデルパッケージ管理ツールを使用してディープラーニングモデルをインポートした後、ここでドロップダウンリストから対応するモデルパッケージ名を選択します。

- モデルパッケージのタイプ

-

パラメータ説明: モデルパッケージ名 を選択すると、 モデルパッケージのタイプ が自動的に記入されます。

- デバイスID

-

パラメータ説明:このパラメータは、モデルパッケージ推論に使用するGPUのデバイスIDを設定するために使用されます。

調整説明:モデルパッケージ名を選択した後、ここでドロップダウンリストからモデルパッケージ推論に使用するGPUのデバイスIDを選択する必要があります。

ROI設定

- ROIファイル

-

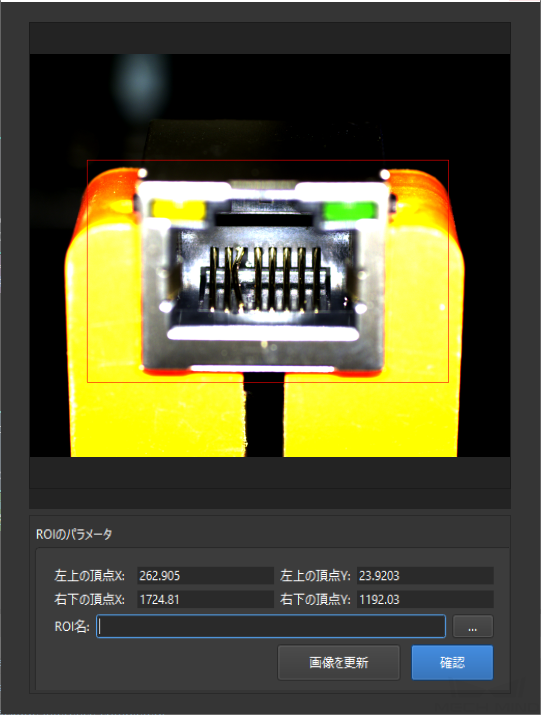

パラメータ説明:このパラメータは、ROIの設定や変更のために使用されます。

調整説明:

-

初期状態では、デフォルトのROI設定が既にあります。ROI設定を変更するには、 ROIファイルを設定 をクリックします。

-

次に、表示された画面で ROI 設定 を行います。

-

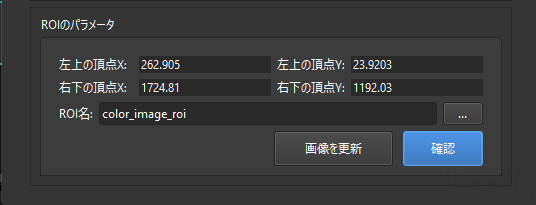

ROI設定後、下図に示すように、ROIファイル名を設定する必要があります。ROI名が設定されていない場合は、ポップアッププロンプトが表示されます。

-

ROI設定後、初期のROIを使用するには、「ROIファイルを設定」ボタンの下のROIファイル名を削除します。

-

|

推論の前に、ここで設定されたROIがMech-DLKで設定されたROIと一致しているかを確認してください。一致していない場合、認識結果に影響を与える 可能性があります。 推論プロセスでは、通常モデルのトレーニング時に設定されたROI(デフォルトROI)が使用されます。カメラ視野内の対象物の位置が変わった場合は、ROIを調整する必要があります。 |

可視化設定

|

本ステップを使用して欠陥セグメンテーションを行う場合は、このパラメータは使用できません。 |

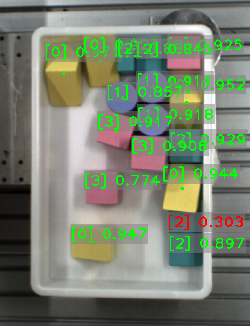

- カスタマイズのフォントサイズを使用

-

パラメータ説明:このパラメータは、可視化出力結果のフォントサイズをカスタマイズするかどうかを設定するために使用されます。チェックを入れた後、 フォントサイズ(0-10) を設定する必要があります。

初期値:チェックを入れない。

調整アドバイス:実際の状況に応じて設定してくだい。

- フォントサイズ(0-10)

-

パラメータ説明:このパラメータは、可視化出力結果のフォントサイズを設定するために使用されます。

初期値:3.0

調整アドバイス:実際の状況に応じて設定してくだい。

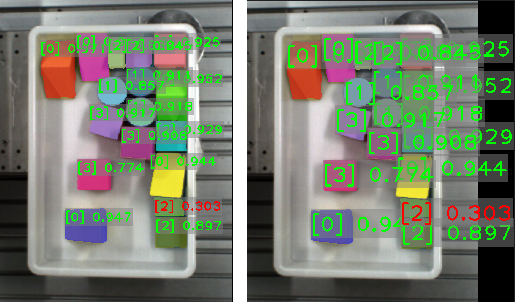

調整の例:インスタンスセグメンテーションを例として説明します。この値をそれぞれ3.0と5.0に設定すると、可視化出力結果のフォントサイズは下図のようになります。左側のフォントサイズは3で、右側のフォントサイズは5です。

- すべての結果を表示

-

パラメータ説明:このパラメータは、直列モデルのすべての推論結果を可視化するために使用されます。このパラメータは、「ディープラーニングモデルパッケージを推論」を使用して直列モデルの推論を行う場合にのみ設定可能です。

調整アドバイス:実際の状況に応じて設定してくだい。

|

本ステップを使用して欠陥セグメンテーションを行う場合は、このパラメータは表示されません。 |

ディープラーニングモデルパッケージの固定パラメータ

画像分類

- 画像分類の信頼度しきい値(0.0-1.0)

-

パラメータ説明:このパラメータは、画像分類に使用する信頼度しきい値を設定するために使用されます。信頼しきい値より大きい結果は緑色で表示され、信頼しきい値より小さい結果は赤色で表示されます。

初期値:0.7000

調整アドバイス:実際の状況に応じて設定してくだい。

- CAMを表示

-

パラメータ説明:画像分類を行う場合、このパラメータは画像のどの部分のピクセルが分類結果に大きく寄与しているかを確認するために使用されます。青は貢献度が小さく、赤は貢献度が大きいことを意味します。

調整説明:このパラメータを設定するには、「すべてのパラメータを表示」を設定する必要があります。

Mech-Vision1.7.2バージョンでは、 CAMを表示 機能を有効にすると、モデルパッケージの推論が遅くなります。

インスタンスセグメンテーション

可視化設定

- 画像で検出対象物を絵画

-

調整説明:このパラメータは、インスタンスセグメンテーションのマスクと境界ボックスを画像に表示するかどうかを設定するために使用されます。

初期値:チェックを入れない。

調整アドバイス:実際の状況に応じて設定してくだい。

- 対象物の可視化方式

-

パラメータ説明:このパラメータは、可視化出力結果の対象物の可視化方式を選択するために使用されます。

初期値:Instances

オプション:Threshold、Instances、Classes、CentralPoint

| 対象物の可視化方式 | 説明 | サンプル図 |

|---|---|---|

Threshold |

信頼度によります。計算されたしきい値がしきい値より大きい場合、対応するインスタンスは緑色に表示されます。それ以外の場合は赤色で表示されます。 |

|

Instances |

各インスタンスは固有の色を持っています。 |

|

Classes |

同じラベルを持つインスタンスは同じ色になります。 |

|

CentralPoint |

対象物自体の色を表示します。 |

|

インスタンスセグメンテーションの信頼度しきい値(0.0-1.0)

パラメータ説明:このパラメータは、インスタンスセグメンテーションに使用する信頼度しきい値を設定するために使用されます。信頼しきい値より大きい結果は緑色で表示され、信頼しきい値より小さい結果は赤色で表示されます。

初期値:0.7000

調整アドバイス:実際の状況に応じて設定してくだい。

対象物検出

可視化設定

- 画像で検出結果を描画

-

パラメータ説明:このパラメータは、画像にマスクと境界ボックスを表示するかどうかを設定するために使用されます。

初期値:チェックを入れない。

調整アドバイス:実際の状況に応じて設定してくだい。

- 結果の可視化方式

-

初期値:CentralPoint

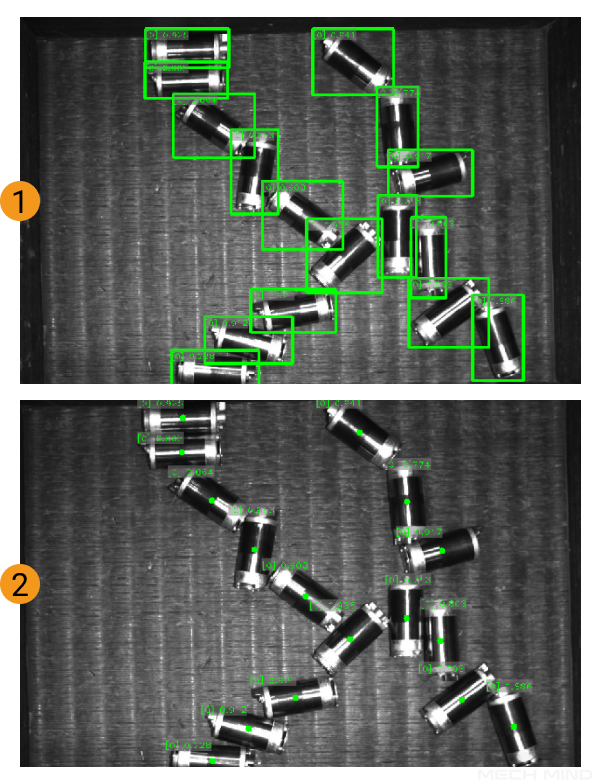

オプション:BoundingBox、CentralPoint

-

BoundingBox:対象物の境界ボックスで結果を表示します。下図の1に示します。

-

CentralPoint:対象物の中心点で結果を表示します。下図の2に示します。

調整アドバイス:実際の状況に応じて設定してくだい。

-

対象物検出の信頼度しきい値(0.0-1.0)

初期値:0.7000

調整説明:このしきい値を超える結果は保持されます。

欠陥セグメンテーション

可視化設定

- 画像で欠陥マスクを描画

-

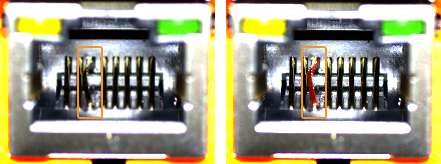

パラメータ説明:このパラメータは、画像に欠陥のマスクを描画するかどうかを設定するために使用されます。チェックを入れた後、入力画像で欠陥マスクを描画します。

初期値:チェックを入れない。

調整の例:下図に示すように、左側のはチェックを入れる前の効果で、右側はチェックを入れた後の効果です。

|