Déploiement de la solution

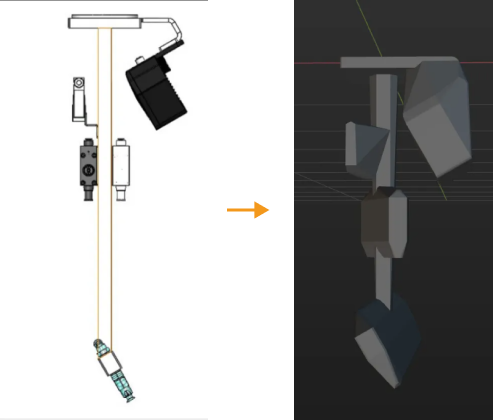

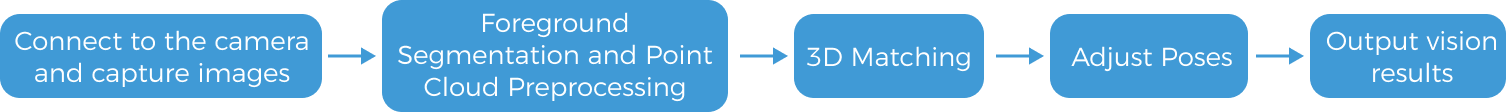

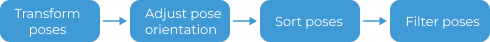

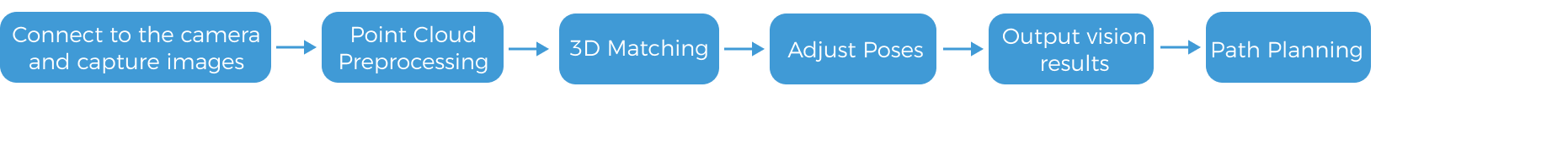

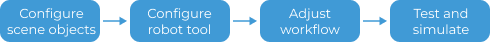

Cette section présente le déploiement de la solution Long Sheet Metal Parts. Le processus global est montré dans la figure ci-dessous.

Configuration matérielle du système de vision

La configuration matérielle du système de vision consiste à intégrer le matériel (caméra et PC industriel) dans l’environnement réel afin de permettre le fonctionnement normal du système de vision.

À cette étape, vous devez installer et configurer le matériel du système de vision. Pour plus de détails, voir Configuration matérielle du système de vision.

Configuration de la communication robot

Avant de configurer la communication du robot, il est nécessaire d’obtenir d’abord la solution. Cliquez ici pour savoir comment obtenir la solution.

-

Ouvrez Mech-Vision.

-

Dans l’interface d’accueil de Mech-Vision, cliquez sur Créer depuis la bibliothèque de solutions pour ouvrir la bibliothèque de solutions.

-

Accédez à la catégorie Cas typiques dans la bibliothèque de solutions, cliquez sur l’icône

en haut à droite pour obtenir davantage de ressources, puis cliquez sur le bouton Confirmer dans la fenêtre contextuelle.

en haut à droite pour obtenir davantage de ressources, puis cliquez sur le bouton Confirmer dans la fenêtre contextuelle. -

Après acquisition des ressources de la solution, sélectionnez la solution Long Sheet Metal Parts dans la catégorie Prise de pièces rangées, renseignez le nom de la solution et le chemin en bas, puis cliquez sur le bouton Créer. Ensuite, cliquez sur le bouton Confirmer dans la fenêtre contextuelle pour télécharger la solution Long Sheet Metal Parts.

Une fois la solution téléchargée, elle s’ouvrira automatiquement dans Mech-Vision.

Avant de déployer un projet de vision, vous devez configurer la communication entre le Mech-Mind Vision System et le côté robot (robot, PLC ou ordinateur hôte).

La solution Long Sheet Metal Parts utilise la communication Interface standard. Pour des instructions détaillées, veuillez consulter Configuration de la communication via Interface standard.

Calibrage main-œil

Le calibrage main-œil établit la relation de transformation entre les repères de la caméra et du robot. Grâce à cette relation, la pose de l’objet déterminée par le système de vision peut être transformée dans le repère du robot, ce qui guide le robot dans l’exécution de ses tâches.

Veuillez consulter Guide de calibrage main-œil du robot et réaliser le calibrage main-œil.

|

Configuration du projet de vision

Après la configuration de la communication et le calibrage main-œil, vous pouvez utiliser Mech-Vision pour configurer le projet de vision.

Cette solution comprend trois projets : Vis-Positionnement du bac, Vis-Positionnement de la caméra et Vis-Positionnement de la pièce.

-

Le projet Vis-Positionnement du bac, qui utilise LSR XL-GL pour capturer des images, localise le bac dans lequel les longues pièces en tôle sont placées.

-

Le projet Vis-Positionnement de la caméra, qui utilise LSR XL-GL pour capturer des images, localise la position de prise de vue pour PRO S-GL et sort la pose de capture d’image afin de guider le robot vers cette position.

-

Le projet Vis-Positionnement de la pièce, qui utilise PRO S-GL pour capturer des images, reconnaît et sort les poses des objets cibles utilisées pour la planification de trajectoire afin de guider le robot pour la prise des objets cibles.

Les sections suivantes présentent respectivement les trois projets.

Vis-Positionnement du bac

Le processus de configuration de ce projet de vision est présenté dans la figure ci-dessous.

Connexion à la caméra et capture d’images

-

Connectez-vous à la caméra.

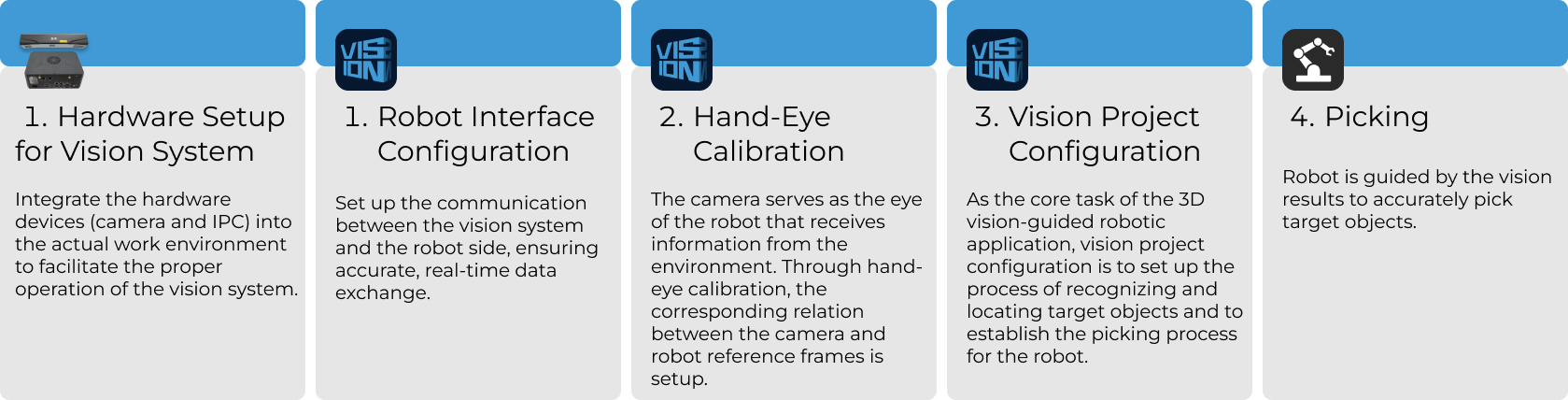

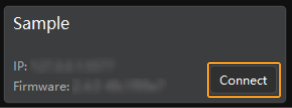

Ouvrez Mech-Eye Viewer, trouvez la caméra à connecter et cliquez sur le bouton Connect.

-

Réglez les paramètres de la caméra.

Afin de garantir que l’image 2D capturée soit nette et que le nuage de points soit intact, vous devez ajuster les paramètres de la caméra. Pour des instructions détaillées, veuillez consulter Guide de référence des paramètres de LSR XL-GL.

-

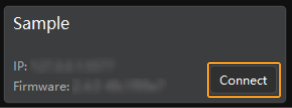

Capturez des images.

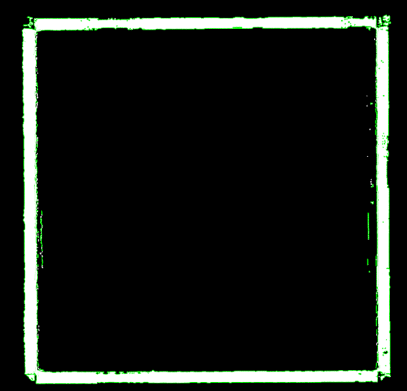

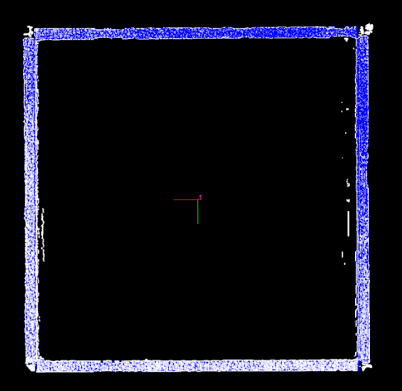

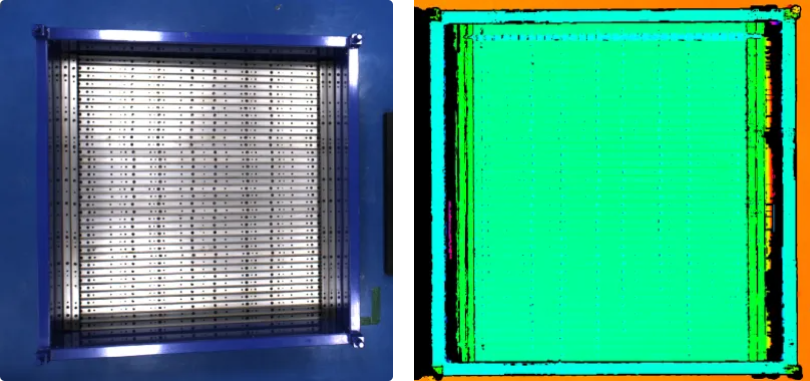

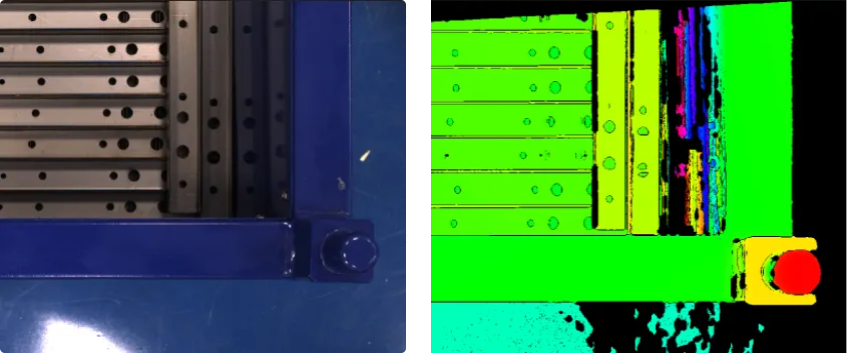

Après la connexion réussie de la caméra et la définition du groupe de paramètres, vous pouvez commencer à capturer les images de l’objet cible (bac). Cliquez sur le bouton

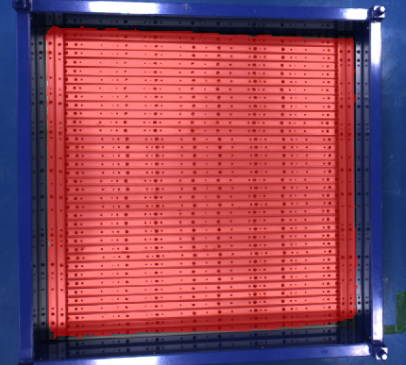

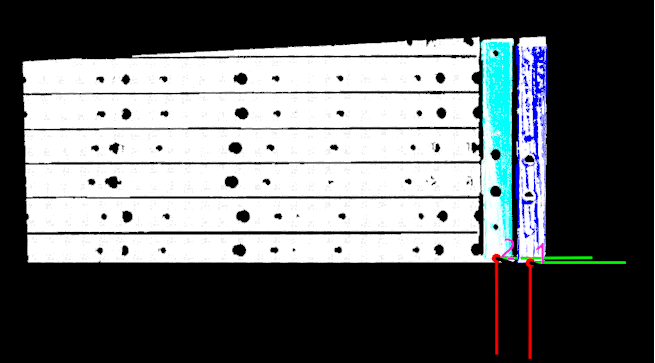

en haut pour capturer une seule image. À ce stade, vous pouvez afficher l’image 2D capturée et le nuage de points de l’objet cible (bac). Assurez-vous que l’image 2D est nette, que le nuage de points est intact et que les bords sont clairs. L’image 2D et le nuage de points qualifiés de l’objet cible (bac) sont respectivement montrés à gauche et à droite dans la figure ci-dessous.

en haut pour capturer une seule image. À ce stade, vous pouvez afficher l’image 2D capturée et le nuage de points de l’objet cible (bac). Assurez-vous que l’image 2D est nette, que le nuage de points est intact et que les bords sont clairs. L’image 2D et le nuage de points qualifiés de l’objet cible (bac) sont respectivement montrés à gauche et à droite dans la figure ci-dessous.

-

Connectez-vous à la caméra dans Mech-Vision.

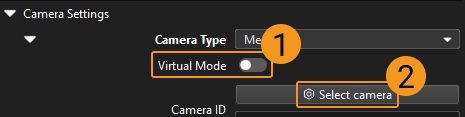

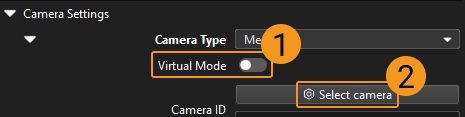

Sélectionnez l’étape Capturer des images depuis la caméra, désactivez l’option Mode virtuel dans la zone Paramètres de l’étape, et cliquez sur le bouton Sélectionner la caméra.

Dans la fenêtre contextuelle, cliquez sur l’icône

à droite du numéro de série de la caméra. Lorsque l’icône devient

à droite du numéro de série de la caméra. Lorsque l’icône devient  , la caméra est connectée avec succès. Après la connexion réussie de la caméra, vous pouvez sélectionner le groupe de paramètres d’étalonnage de la caméra dans la liste déroulante à droite.

, la caméra est connectée avec succès. Après la connexion réussie de la caméra, vous pouvez sélectionner le groupe de paramètres d’étalonnage de la caméra dans la liste déroulante à droite.Maintenant que vous êtes connecté à la caméra réelle, vous n’avez pas besoin d’ajuster d’autres paramètres. Cliquez sur l’icône

sur l’étape Capturer des images depuis la caméra pour exécuter l’étape. S’il n’y a pas d’erreur, la caméra est connectée avec succès et les images peuvent être correctement capturées.

sur l’étape Capturer des images depuis la caméra pour exécuter l’étape. S’il n’y a pas d’erreur, la caméra est connectée avec succès et les images peuvent être correctement capturées.

Reconnaissance d’objet 3D

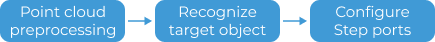

Cette solution utilise l’étape Reconnaissance d’objet 3D pour reconnaître le bac. Cliquez sur le bouton Assistant de configuration dans le panneau Paramètres de l’étape de Reconnaissance d’objet 3D pour ouvrir l’outil Reconnaissance d’objet 3D et configurer les paramètres correspondants. Le processus de configuration global est montré dans la figure ci-dessous.

Prétraitement du nuage de points

Avant le prétraitement du nuage de points, vous devez prétraiter les données en ajustant les paramètres afin de rendre le nuage de points original plus clair, améliorant ainsi la précision et l’efficacité de la reconnaissance.

-

Définir la région de reconnaissance.

Définissez une zone de reconnaissance efficace pour masquer les facteurs d’interférence et améliorer l’efficacité de la reconnaissance.

-

Définissez les paramètres Effet d’extraction des arêtes, Niveau de suppression du bruit et Filtre de points pour supprimer le bruit.

Après le prétraitement du nuage de points, cliquez sur le bouton Exécuter l’étape.

Reconnaître l’objet cible

Après le prétraitement du nuage de points, vous devez créer un modèle de nuage de points pour le bac dans l’Éditeur d’objet cible, puis définir les paramètres d’appariement dans l’outil Reconnaissance d’objet 3D pour l’appariement du modèle de nuage de points.

-

Créez un modèle d’objet cible.

Créez un modèle de nuage de points et ajoutez le point de prise. Cliquez sur le bouton Ouvrir l’éditeur d’objet cible pour ouvrir l’éditeur, générer un modèle de nuage de points et des points de prise en important le nuage de points traité. Le point de prise doit coïncider avec le point central de l’objet.

-

Définissez les paramètres liés à la reconnaissance d’objet.

-

Mode d’appariement : désactivez Définir automatiquement le mode d’appariement et définissez le Mode d’appariement grossier sur Appariement par arêtes et le Mode d’appariement fin sur Appariement de surface.

-

Sortie—Nombre maximal de résultats : Étant donné que l’objet cible est un bac, définissez Nombre maximal de résultats sur 1.

-

Après avoir défini les paramètres ci-dessus, cliquez sur le bouton Exécuter l’étape. Le résultat de l’appariement est présenté dans la figure ci-dessous.

Configurer les ports de l’étape

Après la reconnaissance de l’objet cible, les ports de l’étape doivent être configurés pour fournir des résultats de vision et des nuages de points à Mech-Viz pour la planification de trajectoire et la détection des collisions.

Pour obtenir les informations de position du bac réel, sélectionnez l’option Port(s) liés au point central de l’objet sous Sélectionner le port, puis sélectionnez l’option Nuage de points après traitement et cliquez sur le bouton Enregistrer. De nouveaux ports de sortie sont ajoutés à l’étape Reconnaissance d’objet 3D, comme indiqué ci-dessous.

Ajuster les poses

Après avoir obtenu la pose de l’objet cible, ajustez la pose à l’aide de la procédure Ajuster les poses. Double-cliquez sur la procédure pour afficher les étapes. Cliquez sur le bouton Assistant de configuration dans le panneau Paramètres de l’étape de Adjust Poses V2 pour ouvrir l’outil Ajuster les poses afin de configurer l’ajustement des poses.

-

Pour sortir la pose du bac dans le repère du robot, veuillez cocher Transformer la pose vers le repère du robot afin de transformer la pose du repère de la caméra vers le repère du robot.

-

-

Activez le Mode personnalisé pour Ajustement de la pose.

-

Définissez les paramètres dans la catégorie Traduire la pose le long de la direction spécifiée : Dans le Repère de l’objet, déplacez la pose du bac le long de l’axe Z. Ensuite, définissez la Distance de translation sur Entrée depuis une étape externe pour déplacer la pose du bac de la surface supérieure du bac vers le centre du bac, ce qui sera utilisé ultérieurement pour mettre à jour le modèle de collision du bac dans Mech-Viz.

-

Dans cette procédure, l’étape Lire les dimensions de l’objet lira les dimensions du bac, et la valeur Z du bac sortie par l’étape Décomposer les dimensions de l’objet sera utilisée pour calculer la Distance de translation dans l’étape Adjust Poses V2.

-

Distance de translation = -1 × 1/2 Hauteur du bac

-

-

-

Définissez le Type de tri sur Trier par valeur X/Y/Z de la pose, définissez la Valeur spécifiée de la pose sur Coordonnée Z, et triez les poses par ordre Décroissant.

-

Paramètres généraux.

Définissez le paramètre Définir le nombre de nouveaux ports sur 0. Aucun nouveau port n’est nécessaire.

Vis-Positionnement de la caméra

Le processus de configuration de ce projet de vision est présenté dans la figure ci-dessous.

Connexion à la caméra et capture d’images

-

Connectez-vous à la caméra.

Ouvrez Mech-Eye Viewer, trouvez la caméra à connecter et cliquez sur le bouton Connect.

-

Réglez les paramètres de la caméra.

Afin de garantir que l’image 2D capturée soit nette et que le nuage de points soit intact, vous devez ajuster les paramètres de la caméra. Pour des instructions détaillées, veuillez consulter Guide de référence des paramètres de LSR XL-GL.

-

Capturez des images.

Après la connexion réussie de la caméra et la définition du groupe de paramètres, vous pouvez commencer à capturer les images de l’objet cible. Cliquez sur le bouton

en haut pour capturer une seule image. À ce stade, vous pouvez afficher l’image 2D capturée et le nuage de points de l’objet cible. Assurez-vous que l’image 2D est nette, que le nuage de points est intact et que les bords sont clairs. L’image 2D et le nuage de points qualifiés de l’objet cible sont respectivement montrés à gauche et à droite dans la figure ci-dessous.

en haut pour capturer une seule image. À ce stade, vous pouvez afficher l’image 2D capturée et le nuage de points de l’objet cible. Assurez-vous que l’image 2D est nette, que le nuage de points est intact et que les bords sont clairs. L’image 2D et le nuage de points qualifiés de l’objet cible sont respectivement montrés à gauche et à droite dans la figure ci-dessous.

-

Connectez-vous à la caméra dans Mech-Vision.

Sélectionnez l’étape Capturer des images depuis la caméra, désactivez l’option Mode virtuel dans la zone Paramètres de l’étape, et cliquez sur le bouton Sélectionner la caméra.

Dans la fenêtre contextuelle, cliquez sur l’icône

à droite du numéro de série de la caméra. Lorsque l’icône devient

à droite du numéro de série de la caméra. Lorsque l’icône devient  , la caméra est connectée avec succès. Après la connexion réussie de la caméra, vous pouvez sélectionner le groupe de paramètres d’étalonnage de la caméra dans la liste déroulante à droite.

, la caméra est connectée avec succès. Après la connexion réussie de la caméra, vous pouvez sélectionner le groupe de paramètres d’étalonnage de la caméra dans la liste déroulante à droite.Maintenant que vous êtes connecté à la caméra réelle, vous n’avez pas besoin d’ajuster d’autres paramètres. Cliquez sur l’icône

sur l’étape Capturer des images depuis la caméra pour exécuter l’étape. S’il n’y a pas d’erreur, la caméra est connectée avec succès et les images peuvent être correctement capturées.

sur l’étape Capturer des images depuis la caméra pour exécuter l’étape. S’il n’y a pas d’erreur, la caméra est connectée avec succès et les images peuvent être correctement capturées.

Segmentation de premier plan et prétraitement du nuage de points

Pour réduire l’interférence du nuage de points d’arrière-plan et améliorer la stabilité et la précision de la reconnaissance des objets cibles, la procédure Segmentation de premier plan et prétraitement du nuage de points est utilisée pour reconnaître le masque de l’objet cible et obtenir les nuages de points des objets cibles de la couche la plus haute et les arêtes des objets cibles.

Segmentation de premier plan

Pour réduire l’interférence du nuage de points d’arrière-plan et améliorer la stabilité de la reconnaissance, la procédure Segmentation de premier plan est utilisée pour reconnaître le masque de l’objet cible et extraire le nuage de points de l’objet cible. Double-cliquez sur la procédure Segmentation de premier plan et prétraitement du nuage de points pour ouvrir les étapes.

-

Dans l’étape Inférence du package de modèle d’apprentissage profond, importez le package de modèle de segmentation de premier plan. Cliquez ici pour télécharger le package.

Cliquez sur le bouton Assistant de configuration pour ouvrir la fenêtre Gestion des packages de modèles d’apprentissage profond. Ensuite, cliquez sur le bouton Importer pour importer le package de modèle de segmentation de premier plan téléchargé.

-

Étiquetez des images. Préparez une image d’un bac rempli d’objets cibles. Dans le panneau Paramètres de l’étape, sous Conseils, allez à la catégorie Paramètres des invites, et cliquez sur le bouton Ouvrir l’éditeur à droite de l’Éditeur d’invites de masque pour ouvrir la fenêtre Outil d’invite.

Dans l’onglet Label Prompt, cliquez sur le bouton Obtenir l’image dans le coin supérieur droit. Ensuite, cliquez sur le bouton

dans le coin supérieur gauche pour sélectionner l’Outil Polygone. Utilisez cet outil pour étiqueter le masque de l’objet cible. Évitez le masque du bac et le masque d’arrière-plan lors de l’étiquetage du masque de l’objet cible.

dans le coin supérieur gauche pour sélectionner l’Outil Polygone. Utilisez cet outil pour étiqueter le masque de l’objet cible. Évitez le masque du bac et le masque d’arrière-plan lors de l’étiquetage du masque de l’objet cible.Cliquez sur le bouton Enregistrer en bas à droite et passez à l’onglet Run inference. Puis, cliquez sur le bouton Exécuter l’étape en bas à droite.

Prétraitement du nuage de points

Revenez à l’interface principale du projet, ajustez les paramètres pertinents dans le panneau Paramètres de l’étape à droite pour supprimer le bruit, obtenir le nuage de points des objets cibles de la couche la plus haute et extraire le nuage de points des arêtes des objets cibles à partir de l’image 2D des objets cibles.

-

Définissez le ROI 3D. Cliquez sur le bouton Ouvrir l’éditeur dans la catégorie Extraire les points 3D dans un ROI 3D pour définir un ROI 3D. Supprimez le nuage de points perturbateur, encadrez uniquement le nuage de points des objets cibles et du bac, et conservez une certaine marge autour du bac.

-

Définissez la valeur du paramètre Nombre minimal de points par cluster dans la catégorie Regroupement du nuage de points. Ajustez la valeur de ce paramètre en fonction de la situation réelle sur site. En général, lorsque la valeur de ce paramètre se situe entre le nombre de points du nuage de points de bruit et celui du nuage de points de l’objet cible, il supprime le nuage de points de bruit et conserve le nuage de points de l’objet cible.

-

Définissez la valeur du paramètre Hauteur de couche dans la catégorie Obtenir les nuages de la couche la plus haute pour n’obtenir que le nuage de points des objets cibles de la couche la plus haute.

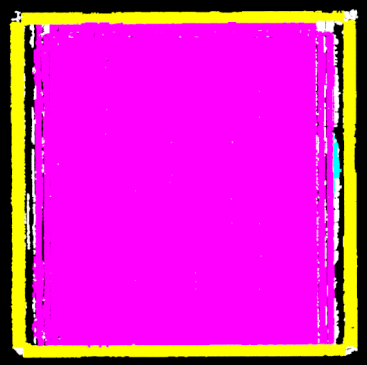

Après configuration, cliquez sur le bouton Exécution d’une seule étape dans le coin supérieur droit de la procédure. Le résultat est montré dans la figure ci-dessous.

Appariement 3D

Utilisez l’étape Appariement 3D pour localiser les longues pièces en tôle et sortir les poses et les étiquettes des points de prise des objets cibles. Ajustez les paramètres suivants dans le panneau Paramètres de l’étape à droite :

-

Créez un modèle d’objet cible. Dans la catégorie Paramètres du modèle, cliquez sur le bouton Éditeur d’objet cible pour ouvrir l’éditeur. Importez le nuage de points traité pour générer le modèle de nuage de points et les points de prise en fonction des caractéristiques de l’objet cible sur site. Le point de prise doit coïncider avec le point central de l’objet.

-

Dans la catégorie Niveau de réglage des paramètres, définissez Niveau de réglage des paramètres sur Expert.

-

Ajustez les paramètres dans la catégorie Paramètres d’appariement grossier : Conservez la valeur par défaut standard du paramètre Mode de performance. Désactivez le commutateur Définir automatiquement le nombre maximal de résultats par nuage de points. Changez la valeur de Nombre maximal de résultats par nuage de points à 40. Conservez la valeur par défaut 1000000 du paramètre Nombre maximal de points du nuage de points de scène échantillonné.

-

Ajustez les paramètres dans la catégorie Paramètres d’appariement fin : Conservez les valeurs par défaut Standard et Petit des paramètres Mode de performance et Capacité de correction de déviation respectivement. Puis, désactivez le commutateur Définir automatiquement le nombre maximal de résultats par nuage de points, et définissez la valeur de Nombre maximal de résultats par nuage de points sur 20.

Après avoir défini les paramètres ci-dessus, cliquez sur le bouton Exécuter l’étape. Le résultat de l’appariement est présenté dans la figure ci-dessous.

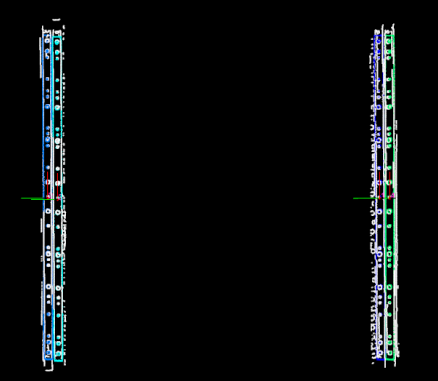

Ajuster les poses

Après avoir obtenu les poses des objets cibles, utilisez l’étape Adjust Poses V2 pour aligner les orientations selon l’axe X des objets cibles, et ajuster la position de prise de vue de PRO S-GL. Cliquez sur le bouton Assistant de configuration dans le panneau Paramètres de l’étape de Adjust Poses V2 pour ouvrir l’outil Ajuster les poses afin de configurer l’ajustement des poses. Le processus de configuration global est montré dans la figure ci-dessous.

-

Pour sortir les poses des objets cibles dans le repère du robot, veuillez cocher Transformer la pose vers le repère du robot afin de transformer les poses du repère de la caméra vers le repère du robot.

-

-

Activez le Mode personnalisé pour Ajustement de la pose.

-

Définissez les paramètres dans la catégorie Faire pivoter la pose et minimiser l’angle entre l’axe de rotation et la direction cible : Pour faciliter l’ajustement ultérieur des poses, les orientations des poses des objets cibles doivent être alignées. Définissez Axe à fixer sur Axe Z, Axe à faire pivoter sur Axe X, et la Direction X positive du repère du robot comme direction cible.

-

Le champ de vision de PRO S-GL est réduit. Pour garantir que la caméra capture des images satisfaisantes à la distance de capture optimale, vous devez ajuster deux fois les paramètres dans la catégorie Traduire la pose le long de la direction spécifiée :

-

Définissez les paramètres dans la catégorie Traduire la pose le long de la direction spécifiée : Étant donné que PRO S-GL a un petit champ de vision, il est nécessaire de déplacer la pose de l’objet cible du centre vers une extrémité de l’objet cible. Dans le Repère de l’objet, déplacez la pose le long de l’axe X. Définissez la Distance de translation sur Saisie manuelle, et définissez la valeur à 501 mm.

-

Définissez les paramètres dans la catégorie Traduire la pose le long de la direction spécifiée : Pour garantir que PRO S-GL capture des images à la distance optimale, déplacez la pose de prise de vue au-dessus de l’objet cible. Dans le Repère du robot, déplacez la pose le long de la Direction Z positive. Définissez la Distance de translation sur Saisie manuelle, et définissez la valeur à 1000 mm.

Définissez les deux valeurs ci-dessus de Distance de translation en fonction de la situation réelle, afin que PRO S-GL puisse obtenir le meilleur effet d’imagerie. Après configuration, les deux conditions suivantes pour la capture d’images doivent être satisfaites :

-

Le bac ne masque pas les objets cibles.

-

La partie du bac capturée doit être la plus petite possible pour réduire l’impact des réflexions provenant des parois du bac.

-

-

-

-

Définissez le Type de tri sur Trier par valeur X/Y/Z de la pose, définissez la Valeur spécifiée de la pose sur Coordonnée Z, et triez les poses par ordre Décroissant.

-

Paramètres généraux.

Définissez le paramètre Définir le nombre de nouveaux ports sur 1, et un nouveau port d’entrée et de sortie sera ajouté à l’étape. Connectez le port d’entrée au port de sortie Informations sur le point de prise de l’étape Appariement 3D et connectez le port de sortie à l’étape Sortie.

Reconnaissance et prise des objets

Le processus de configuration de ce projet de vision est présenté dans la figure ci-dessous.

Connexion à la caméra et capture d’images

-

Connectez-vous à la caméra.

Ouvrez Mech-Eye Viewer, trouvez la caméra à connecter et cliquez sur le bouton Connect.

-

Réglez les paramètres de la caméra.

Afin de garantir que l’image 2D capturée soit nette et que le nuage de points soit intact, vous devez ajuster les paramètres de la caméra. Pour des instructions détaillées, veuillez consulter Référence des paramètres de la caméra PRO S-GL.

-

Capturez des images.

Après la connexion réussie de la caméra et la définition du groupe de paramètres, vous pouvez commencer à capturer les images de l’objet cible. Cliquez sur le bouton

en haut pour capturer une seule image. À ce stade, vous pouvez afficher l’image 2D capturée et le nuage de points de l’objet cible. Assurez-vous que l’image 2D est nette, que le nuage de points est intact et que les bords sont clairs. L’image 2D et le nuage de points qualifiés de l’objet cible sont respectivement montrés à gauche et à droite dans la figure ci-dessous.

en haut pour capturer une seule image. À ce stade, vous pouvez afficher l’image 2D capturée et le nuage de points de l’objet cible. Assurez-vous que l’image 2D est nette, que le nuage de points est intact et que les bords sont clairs. L’image 2D et le nuage de points qualifiés de l’objet cible sont respectivement montrés à gauche et à droite dans la figure ci-dessous.

-

Connectez-vous à la caméra dans Mech-Vision.

Sélectionnez l’étape Capturer des images depuis la caméra, désactivez l’option Mode virtuel dans le panneau Paramètres de l’étape, et cliquez sur le bouton Sélectionner la caméra. Dans la fenêtre contextuelle, cliquez sur l’icône

à droite du numéro de série de la caméra. Lorsque l’icône devient

à droite du numéro de série de la caméra. Lorsque l’icône devient  , la caméra est connectée avec succès. Après la connexion réussie de la caméra, vous pouvez sélectionner le groupe de paramètres d’étalonnage de la caméra dans la liste déroulante à droite.

, la caméra est connectée avec succès. Après la connexion réussie de la caméra, vous pouvez sélectionner le groupe de paramètres d’étalonnage de la caméra dans la liste déroulante à droite.Maintenant que vous êtes connecté à la caméra réelle, vous n’avez pas besoin d’ajuster d’autres paramètres. Cliquez sur l’icône

sur l’étape Capturer des images depuis la caméra pour exécuter l’étape. S’il n’y a pas d’erreur, la caméra est connectée avec succès et les images peuvent être correctement capturées.

sur l’étape Capturer des images depuis la caméra pour exécuter l’étape. S’il n’y a pas d’erreur, la caméra est connectée avec succès et les images peuvent être correctement capturées.

Prétraitement du nuage de points

Pour supprimer le nuage de points perturbateur, obtenir le nuage de points de la couche la plus haute, et extraire le nuage de points des arêtes et le nuage de points de surface des objets cibles, la procédure Prétraitement du nuage de points est utilisée. Ajustez les paramètres pertinents dans le panneau Paramètres de l’étape à droite :

-

Définissez le ROI 3D. Cliquez sur le bouton Ouvrir l’éditeur dans la catégorie Extraire les points 3D dans un ROI 3D pour définir un ROI 3D. Supprimez le nuage de points perturbateur, ne gardez que le nuage de points des objets cibles, et conservez une certaine marge autour du bac.

-

Définissez la valeur du paramètre Hauteur de couche dans la catégorie Obtenir les nuages de la couche la plus haute pour n’obtenir que le nuage de points des objets cibles de la couche la plus haute.

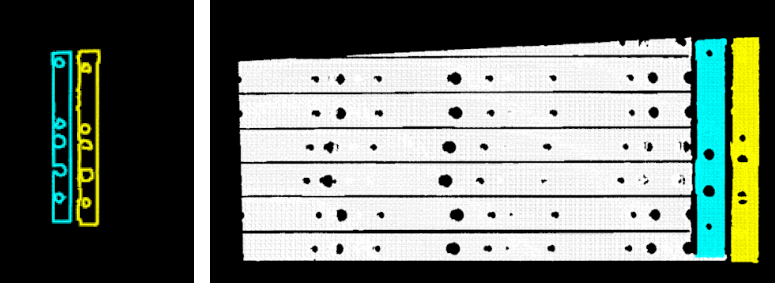

Après configuration, cliquez sur le bouton Exécution d’une seule étape dans le coin supérieur droit de la procédure. Les résultats de l’extraction du nuage de points des arêtes des objets cibles et de l’obtention du nuage de points des objets cibles de la couche la plus haute sont respectivement présentés dans les figures de gauche et de droite ci-dessous.

Appariement 3D

Utilisez l’étape Appariement 3D pour réaliser l’appariement des arêtes des longues pièces en tôle. Le nuage de points d’une extrémité de la pièce est localisé, sur la base duquel le point de prise est sorti. Ajustez les paramètres suivants dans le panneau Paramètres de l’étape à droite :

-

Créez un modèle d’objet cible. Dans la catégorie Paramètres du modèle, cliquez sur le bouton Éditeur d’objet cible pour ouvrir l’éditeur. Importez le nuage de points traité pour générer le modèle de nuage de points et les points de prise en fonction des caractéristiques de l’objet cible sur site. Définissez le point central de l’objet au centre du nuage de points, et définissez le point de prise à une extrémité de l’objet cible.

Contrairement aux deux projets précédents, le point de prise n’est pas au point central de l’objet mais à l’extrémité de l’objet. -

Dans la catégorie Niveau de réglage des paramètres, définissez Niveau de réglage des paramètres sur Expert.

-

Ajustez les paramètres dans la catégorie Paramètres d’appariement grossier : Conservez la valeur par défaut standard du paramètre Mode de performance. Désactivez le commutateur Définir automatiquement le nombre maximal de résultats par nuage de points. Conservez la valeur 1000000 du paramètre Nombre maximal de points du nuage de points de scène échantillonné.

-

Ajustez les paramètres dans la catégorie Paramètres d’appariement fin : Conservez les valeurs par défaut Standard et Petit des paramètres Mode de performance et Capacité de correction de déviation respectivement. Ensuite, activez le commutateur Définir automatiquement le nombre maximal de résultats par nuage de points.

-

Ajustez les paramètres dans la catégorie Appariement extra fin : Activez le commutateur Appariement extra fin. Conservez les valeurs par défaut Standard et Petit des paramètres Mode de performance et Capacité de correction de déviation respectivement.

Après avoir défini les paramètres ci-dessus, cliquez sur le bouton Exécuter l’étape. Le résultat de l’appariement est présenté dans la figure ci-dessous.

Ajuster les poses

Après avoir obtenu les poses des objets cibles, utilisez l’étape Adjust Poses V2 pour les ajuster, en déplaçant les poses des objets cibles des extrémités vers les centres de l’objet cible, puis en les triant et les filtrant. Cliquez sur le bouton Assistant de configuration dans le panneau Paramètres de l’étape de Adjust Poses V2 pour ouvrir l’outil Ajuster les poses afin de configurer l’ajustement des poses.

-

Pour sortir les poses des objets cibles dans le repère du robot, veuillez cocher Transformer la pose vers le repère du robot afin de transformer les poses du repère de la caméra vers le repère du robot.

-

Ajuster l’orientation des poses.

Définissez Orientation sur Alignement automatique et Scénario d’application sur Aligner les axes Z (Servitude de machine) pour garantir que le robot effectue la prise dans une direction spécifiée, évitant ainsi les collisions.

-

Traduire les poses le long de la direction spécifiée.

Dans le Repère de l’objet, déplacez la pose du bac le long de l’axe X et ajustez manuellement la Distance de translation à -659 mm pour déplacer la pose de l’objet cible d’une extrémité vers le centre de l’objet cible.

Distance de translation = -1 × 1/2 Longueur de l’objet cible -

Définissez le Type de tri sur Trier par valeur X/Y/Z de la pose, définissez la Valeur spécifiée de la pose sur Coordonnée Z, et triez les poses par ordre Décroissant.

-

Pour réduire le temps nécessaire à la planification de trajectoire ultérieure, les objets cibles qui ne peuvent pas être facilement pris doivent être filtrés en fonction de l’angle entre l’axe Z de la pose dans le repère du robot et la direction de référence. Dans ce tutoriel, vous devez définir Différence angulaire maximale sur 30°.

-

Paramètres généraux.

Définissez le paramètre Définir le nombre de nouveaux ports sur 1, et un nouveau port d’entrée et de sortie sera ajouté à l’étape. Connectez le port d’entrée au port de sortie Informations sur le point de prise de l’étape Appariement 3D et connectez le port de sortie à l’étape Sortie.

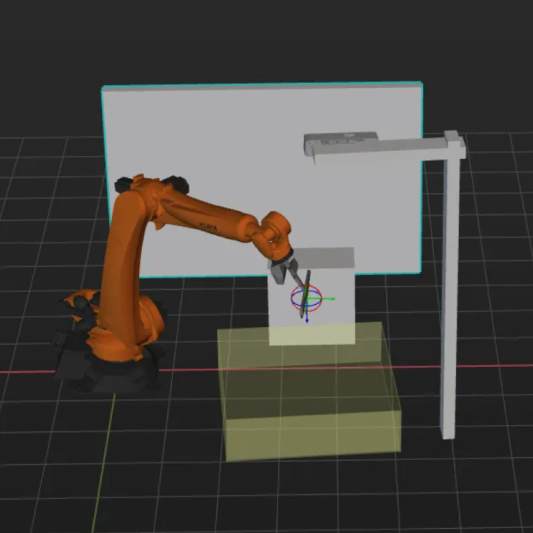

Planification de trajectoire

Une fois la reconnaissance de l’objet cible terminée, vous pouvez utiliser Mech-Viz pour planifier une trajectoire puis écrire un programme robot pour la prise des objets cibles.

Le processus de configuration de la planification de trajectoire est montré dans la figure ci-dessous.

Configurer les objets de scène

Les objets de scène sont introduits pour rendre la scène dans le logiciel plus proche du scénario réel, ce qui facilite la planification de trajectoire du robot. Pour des instructions détaillées, veuillez consulter Configurer les objets de scène.

Pour assurer une prise efficace, les objets de scène doivent être configurés de manière à représenter fidèlement l’environnement opérationnel réel. Les objets de scène de cette solution sont configurés comme montré ci-dessous :

Configurer l’outil du robot

L’effecteur terminal doit être configuré afin que son modèle puisse être affiché dans la zone de simulation 3D et utilisé pour la détection des collisions. Pour des instructions détaillées, veuillez consulter Configurer l’outil.

|

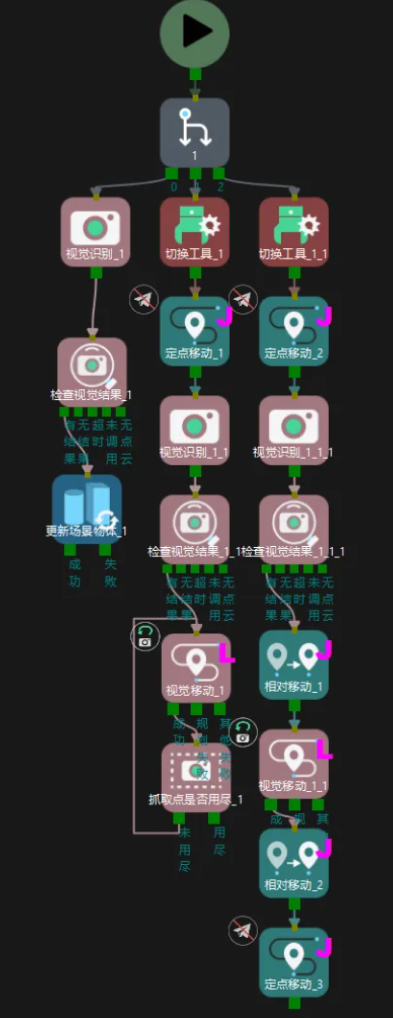

Ajuster le workflow

Le workflow fait référence au programme de contrôle des mouvements du robot créé dans Mech-Viz sous la forme d’un organigramme. Après la configuration des objets de scène et des effecteurs terminaux, vous pouvez ajuster le workflow du projet selon les exigences réelles. Le workflow de ce projet est présenté dans la figure ci-dessous.

Le projet Mech-Viz se compose des trois branches suivantes :

-

La première branche correspond au projet Vis-Positionnement du bac dans Mech-Vision. Utilisez l’étape Reconnaissance visuelle pour déclencher le projet, qui reconnaît la pose du bac et met à jour les informations sur l’objet de scène.

-

La deuxième branche correspond au projet Vis-Positionnement de la caméra dans Mech-Vision. Utilisez l’étape Reconnaissance visuelle pour déclencher le projet, qui calcule et sort le point de capture d’image de la caméra vers lequel le robot est guidé.

-

La troisième branche correspond au projet Vis-Positionnement de la pièce dans Mech-Vision. Utilisez l’étape Reconnaissance visuelle pour déclencher le projet, qui sort les poses des longues pièces en tôle vers Mech-Viz pour la planification de trajectoire et le guidage du robot pour la prise.

Simuler et tester

Cliquez sur le bouton Simuler dans la barre d’outils pour tester si le système de vision est correctement configuré en simulant le projet Mech-Viz.

Placez l’objet cible proprement dans le bac et cliquez sur Simuler dans la barre d’outils de Mech-Viz pour simuler la prise de l’objet cible. Après chaque prise réussie, l’objet cible doit être réorganisé, et 10 tests de simulation doivent être effectués. Si les 10 simulations aboutissent toutes à des prises réussies, le système de vision est correctement configuré.

En cas d’exception lors de la simulation, consultez FAQ de déploiement de la solution pour résoudre le problème.

Prise et dépose par le robot

Écrire un programme robot

Si le résultat de la simulation est conforme aux attentes, vous pouvez écrire un programme de prise et de dépose pour le robot KUKA.

Le programme d’exemple MM_S2_Viz_Basic pour le robot FANUC peut essentiellement satisfaire les exigences de ce cas typique. Vous pouvez modifier le programme d’exemple. Pour une explication détaillée de ce programme, veuillez consulter Programme d’exemple S2 Explication.

Instructions de modification

Sur la base du programme d’exemple, veuillez modifier les fichiers du programme en suivant ces étapes :

-

Définissez le repère de l’outil et le repère de base.

Avant modification Après modification (exemple) ;set current tool no. to 1 BAS(#TOOL,1) ;set current base no. to 0 BAS(#BASE,0)

;set current tool no. to 2 BAS(#TOOL,2) ;set current base no. to 0 BAS(#BASE,0)

Veuillez remplacer le numéro par le numéro de l’outil réellement utilisé, où « 2 » et « 0 » ne sont que des exemples. -

Spécifiez l’adresse IP de l’IPC. Le fichier de configuration XML_Kuka_MMIND.xml est chargé sur le robot KUKA lorsque le programme Interface standard est chargé sur le robot. Vous pouvez modifier l’adresse IP et le port de l’IPC dans le fichier de configuration avant le chargement. S’ils ne sont pas déjà modifiés, vous pouvez ouvrir le fichier XML_Kuka_MMIND.xml spécifié par la commande MM_Init_Socket et mettre à jour l’adresse IP et le port dans le fichier XML avec ceux de l’IPC.

-

Ajoutez une commande de branche pour sélectionner la branche à exécuter et déclencher le projet Mech-Viz.

Avant modification Après modification (exemple) ;trigger {product-viz} project MM_Start_Viz(2,init_jps)!trigger {product-viz} project ; MM_Start_Viz(2,init_jps) ;Set_Branch MM_Set_Branch(1,1)-

Veuillez vous référer à l’instruction ci-dessus pour ajouter des commandes qui sélectionnent les branches 2 et 3 et exécutent le projet Mech-Viz.

-

Fonctionnement conjoint des trois branches du projet Mech-Viz :

-

Le programme robot sélectionne d’abord la branche 1 et exécute le projet Mech-Viz pour déclencher le projet de vision Vis-Positionnement du bac qui sort la pose du bac.

-

Si une pose de bac est sortie, le programme robot sélectionne alors la branche 2 pour exécuter le projet Mech-Viz et déclencher le projet de vision Vis-Positionnement de la caméra afin de sortir la position de prise de vue.

-

Si une position de prise de vue de la caméra est sortie, le programme robot contrôle le robot pour se déplacer vers la position de prise de vue. Ensuite, le programme robot sélectionne la branche 3 et exécute le projet Mech-Viz pour déclencher le projet de vision Vis-Positionnement de la pièce, planifiant ainsi une trajectoire de prise sans collision pour le robot.

-

-

-

Définissez le signal pour le port DO afin d’effectuer la prise, c’est-à-dire fermer la pince et saisir l’objet cible. Notez que la commande DO doit être définie en fonction du numéro de port DO réellement utilisé sur site.

Avant modification Après modification (exemple) ;add object grasping logic here, such as "$OUT[1]=TRUE" halt

;add object grasping logic here, such as "$OUT[2]=TRUE" $OUT[2]=TRUE halt

-

Définissez le port DO pour effectuer la dépose. Notez que la commande DO doit être définie en fonction du numéro de port DO réellement utilisé sur site.

Avant modification Après modification (exemple) ;add object releasing logic here, such as "$OUT[1]=FALSE" halt

;add object grasping logic here, such as "$OUT[2]=FALSE" $OUT[2]=FALSE halt

Test de prise

Pour assurer une production stable dans le scénario réel, le programme d’exemple modifié doit être exécuté pour effectuer le test de prise avec le robot. Pour des instructions détaillées, veuillez consulter Tester la communication de l’Interface standard.

Avant d’effectuer le test de prise, veuillez enseigner la position Home, c’est-à-dire la position initiale en mode enseignement. La position initiale doit être éloignée des objets à saisir et des dispositifs environnants, et ne doit pas obstruer le champ de vision de la caméra.

Après l’enseignement, disposez les objets cibles comme montré dans le tableau ci-dessous, et utilisez le robot pour effectuer des tests de prise pour toutes les dispositions à faible vitesse.

Les tests de prise peuvent être divisés en trois phases :

Phase 1 : Test de prise pour un état d’alimentation normal

État de placement des objets |

Illustration |

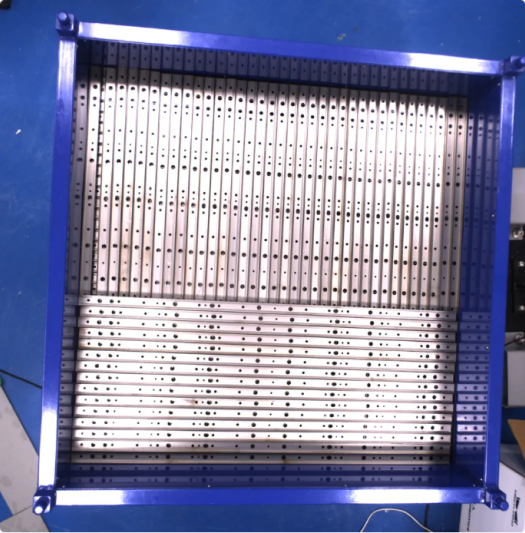

Les objets cibles sont rangés proprement et la couche supérieure est pleine. |

|

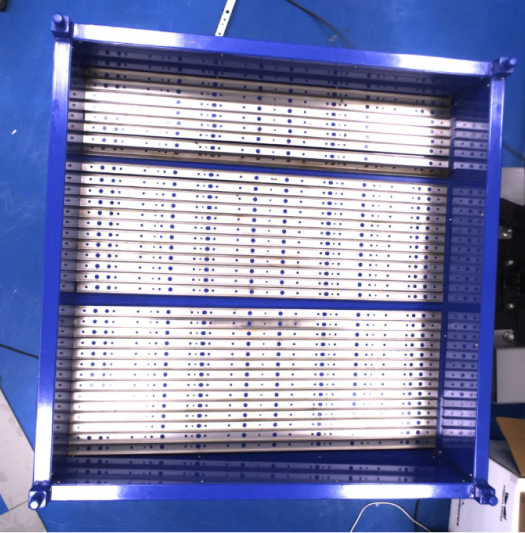

Les objets cibles sont rangés proprement et la couche inférieure est pleine. |

|

Phase 2 : Test de prise en condition d’alimentation anormale

État de placement des objets |

Illustration |

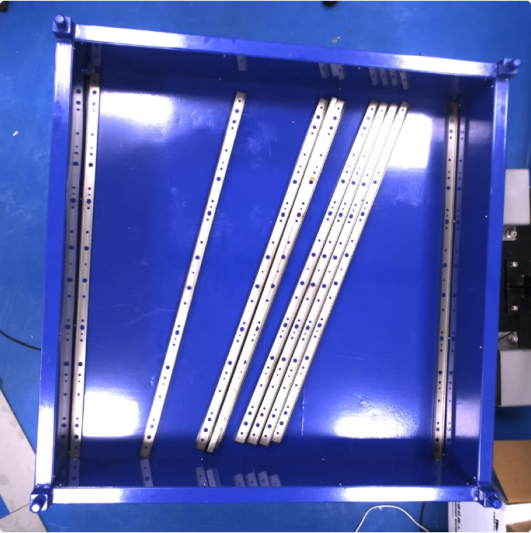

Les objets cibles sont en rotation dans le plan. |

|

Phase 3 : Test de prise pour scénario réel

État de placement des objets |

Illustration |

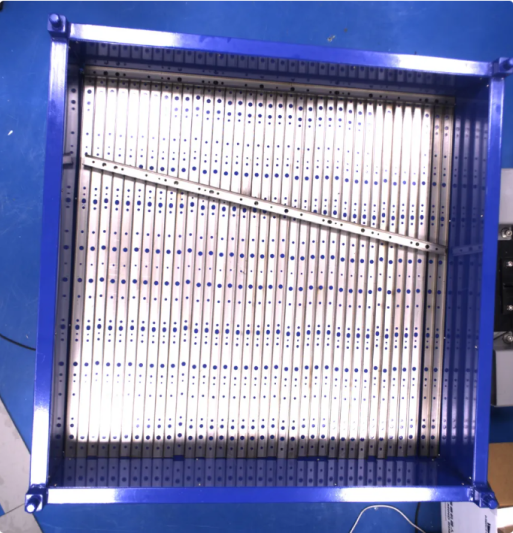

Lorsque le bac est rempli d’objets cibles et en état d’alimentation normal, simulez le scénario où un objet cible se déplace hors de sa position. |

|

Si le robot réussit à saisir l’objet cible dans les scénarios de test ci-dessus, on peut considérer que le système de vision est déployé avec succès.