솔루션 배포

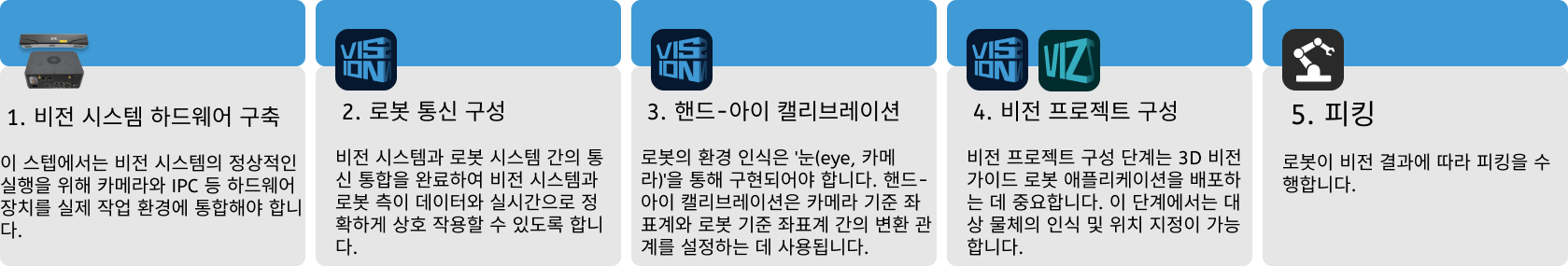

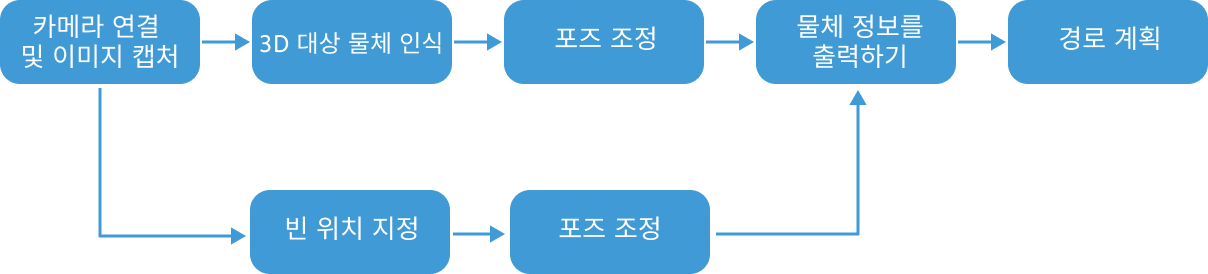

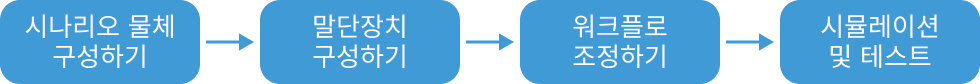

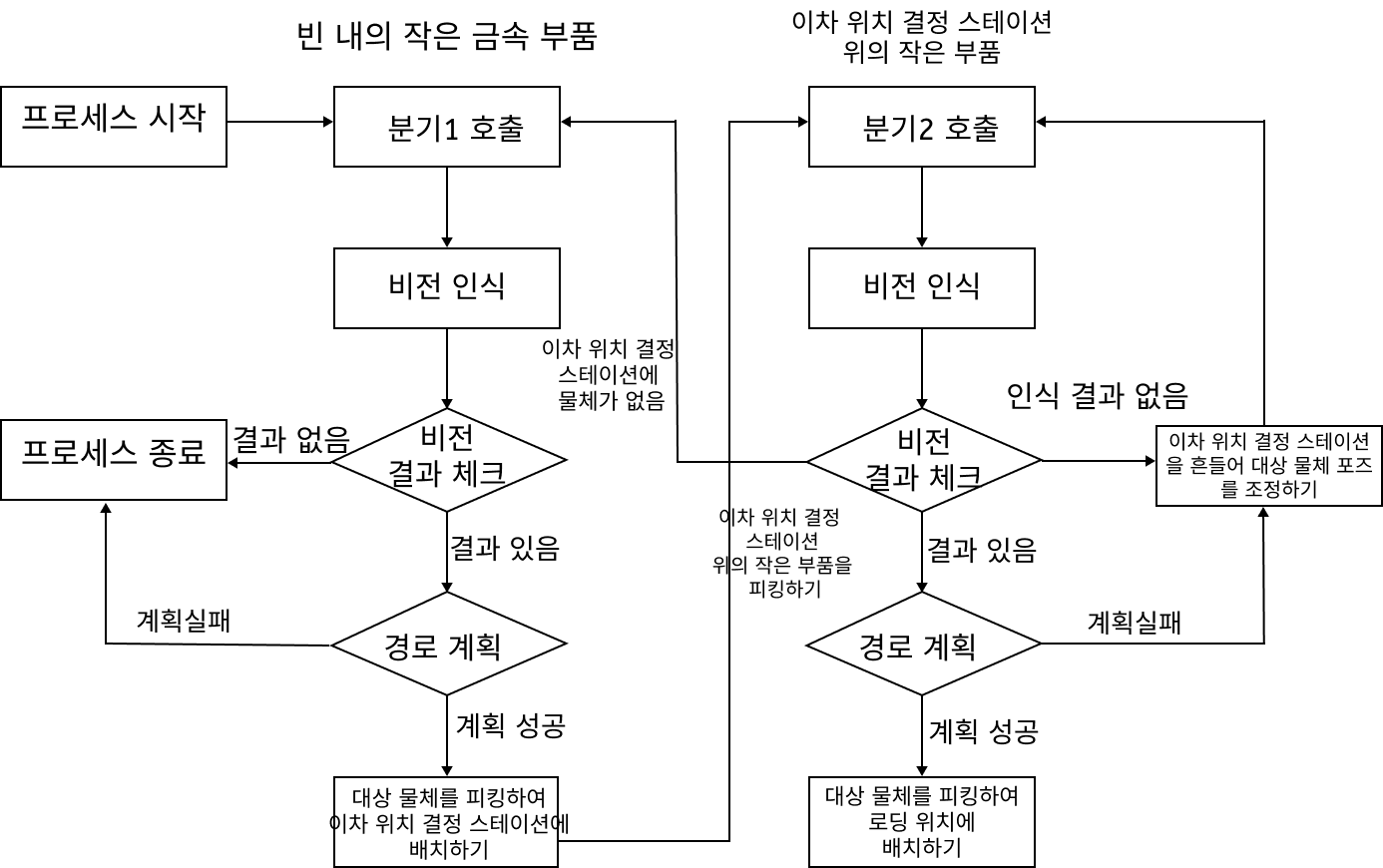

이 섹션에서는 깊은 빈 내의 작은 금속 부품 솔루션을 배포하는 방법을 설명합니다. 전체적인 과정은 다음 그림과 같습니다.

비전 시스템 하드웨어 구축

이 스텝에서는 비전 시스템의 정상적인 실행을 위해 카메라와 IPC 등 하드웨어 장치를 실제 작업 환경에 통합해야 합니다.

이 스텝에서는 비전 시스템 하드웨어를 설치하고 연결해야 합니다. 상세한 설명은 비전 시스템 하드웨어 구축 내용을 참조하세요.

로봇 통신 구성

로봇 통신을 구성하기 전에 솔루션을 먼저 얻어야 합니다. 솔루션을 획득하려면 이곳을 클릭하십시오.

-

Mech-Vision 소프트웨어를 시작합니다.

-

Mech-Vision 시작 화면에서 솔루션 라이브러리에서 새로 만들기 버튼을 클릭하여 솔루션 라이브러리를 엽니다.

-

솔루션 라이브러리의 일반적인 사례로 가서 오른쪽 상단의

아이콘을 클릭하여 추가 리소스를 얻은 후 팝업 창에서 확인 버튼을 클릭하세요.

아이콘을 클릭하여 추가 리소스를 얻은 후 팝업 창에서 확인 버튼을 클릭하세요. -

사례 리소스를 얻은 후 무질서한 대상 물체 피킹의 깊은 빈 내의 작은 금속 부품를 선택하고 아래에 솔루션 이름과 경로를 입력하세요. 그 다음 새로 만들기 버튼을 클릭하고 팝업창에서 확인 버튼을 클릭하면 깊은 빈 내의 작은 금속 부품 솔루션을 다운로드할 수 있습니다.

다운로드가 완료되면 솔루션이 Mech-Vision에서 자동으로 열립니다.

비전 프로젝트를 구성하기 전에 Mech-Mind 비전 시스템과 로봇 측(로봇, PLC나 마스터 컴퓨터)과의 통신 연결을 실현해야 합니다.

깊은 빈 내의 작은 금속 부품 솔루션은 표준 인터페이스 통신을 사용합니다. 구체적인 사용 밥법은 표준 인터페이스 통신 구성를 참조하십시오.

핸드-아이 캘리브레이션

핸드-아이 캘리브레이션은 카메라 좌표계와 로봇 좌표계 간의 해당 관계를 구축하는 과정을 말하며, 비전 시스템에 의해 제공된 물체 포즈를 로봇 좌표계 아래의 포즈로 전환하여 로봇이 피킹 작업을 정확하게 완료하도록 가이드합니다.

로봇 핸드-아이 캘리브레이션 사용 가이드를 참조하여 핸드-아이 캘리브레이션을 완성하십시오.

|

카메라를 설치할 때마다 또는 캘리브레이션 후 카메라와 로봇의 상대 위치가 변경될 때마다 핸드-아이 캘리브레이션을 수행해야 합니다. |

비전 프로젝트 구성

통신 구성 및 핸드-아이 캘리브레이션이 완료되면 Mech-Vision을 사용하여 비전 프로젝트를 구성할 수 있습니다.

분 솔루션에는 두 가지 프로젝트가 포함되어 있습니다. 깊은 빈 내의 작은 금속 부품 프로젝트 및 이차 위치 결정 스테이션 위의 작은 금속 부품 프로젝트입니다.

깊은 빈 내의 작은 금속 부품 프로젝트는 깊은 빈 내의 작은 금속 부품의 포즈를 인식하고 출력하는 데 사용됩니다.

이차 위치 결정 스테이션 위의 작은 금속 부품 프로젝트는 이차 위치 결정 스테이션 위의 작은 금속 부품의 포즈를 인식하고 출력하는 데 사용됩니다.

아래에서는 이 두 가지 프로젝트를 소개합니다.

깊은 빈 내의 작은 금속 부품

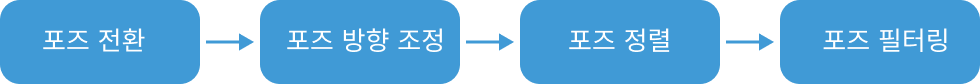

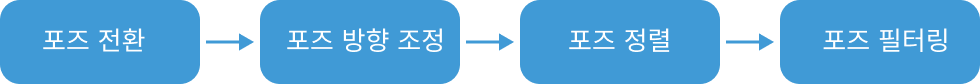

이 비전 프로젝트를 구성하는 방법의 프로세스는 아래 그림과 같습니다.

카메라 연결 및 이미지 캡처

-

카메라를 연결합니다.

Mech-Eye Viewer를 열어 연결할 카메라를 찾은 후 연결 버튼을 클릭하십시오.

-

카메라 파라미터를 조정합니다.

카메라로 캡처한 2D 이미지가 선명하고 포인트 클라우드가 누락되지 않았는지 확인하려면 카메라 파라미터를 조정해야 합니다. 파라미터 조정 방법은 PRO M-GL 카메라 파라미터에 관한 설명을 참조하십시오.

-

이미지를 캡처합니다.

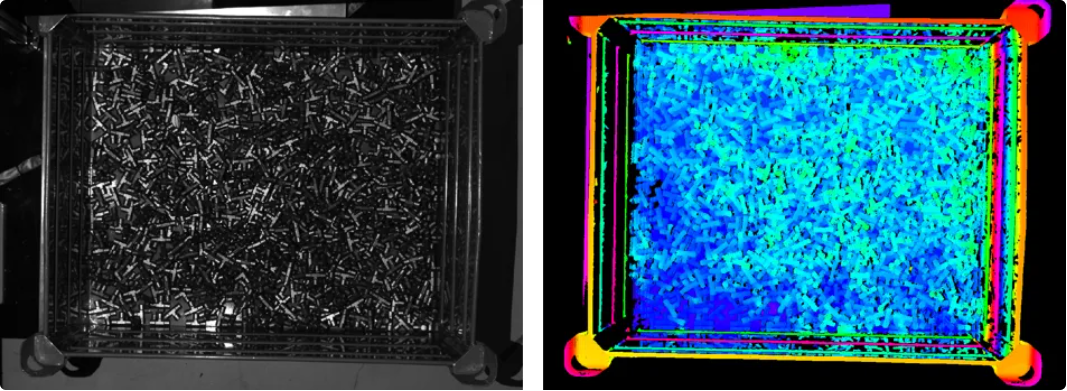

카메라가 성공적으로 연결되고 파라미터 그룹이 설정되면 대상 물체의 이미지 캡처를 시작할 수 있습니다. 인터페이스 상단의

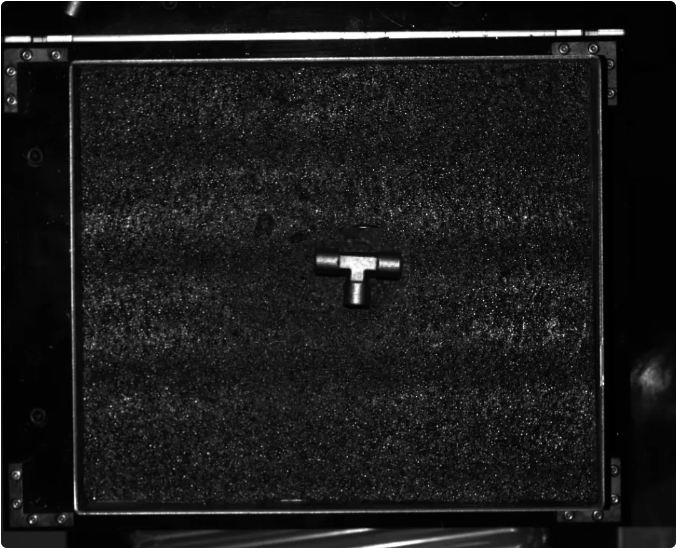

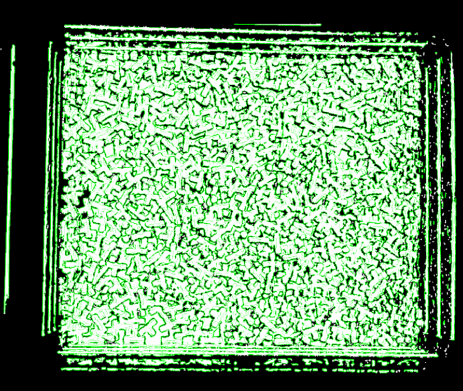

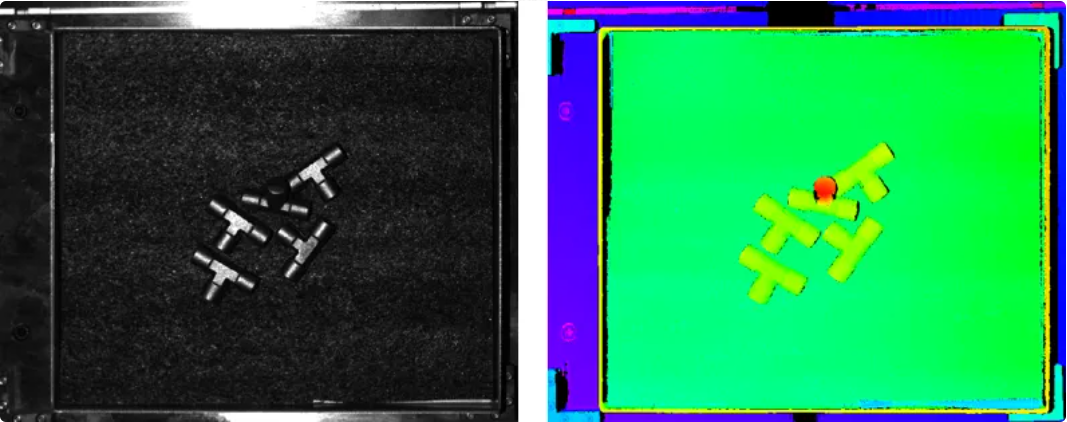

버튼을 클릭하여 단일 이미지를 획득합니다. 이때 획득한 대상 물체의 2D 이미지와 포인트 클라우드를 확인할 수 있어 2D 이미지가 선명하고 포인트 클라우드가 누락되지 않았으며 에지가 선명한지 확인할 수 있습니다. 검증된 대상 물체의 2D 이미지와 포인트 클라우드는 다음 그림의 왼쪽 및 오른쪽 이미지에 각각 표시됩니다.

버튼을 클릭하여 단일 이미지를 획득합니다. 이때 획득한 대상 물체의 2D 이미지와 포인트 클라우드를 확인할 수 있어 2D 이미지가 선명하고 포인트 클라우드가 누락되지 않았으며 에지가 선명한지 확인할 수 있습니다. 검증된 대상 물체의 2D 이미지와 포인트 클라우드는 다음 그림의 왼쪽 및 오른쪽 이미지에 각각 표시됩니다.

-

Mech-Vision에서 카메라를 연결합니다.

카메라에서 이미지를 캡처하기 스텝을 선택하고 인터페이스의 오른쪽 하단 모서리에 있는 스텝 파라미터에서 가상 모드를 닫고 카메라를 선택하기를 클릭합니다. 팝업 창에서 카메라 번호 오른쪽에 있는

아이콘을 클릭하고 아이콘이

아이콘을 클릭하고 아이콘이  로 바뀌면 카메라가 성공적으로 연결되었음을 나타냅니다. 카메라 연결에 성공한 후, 오른쪽의 파라미터 그룹 드롭다운에서 캘리브레이션 파라미터 그룹을 선택하세요.

로 바뀌면 카메라가 성공적으로 연결되었음을 나타냅니다. 카메라 연결에 성공한 후, 오른쪽의 파라미터 그룹 드롭다운에서 캘리브레이션 파라미터 그룹을 선택하세요.위 설정이 완료되면 실제 카메라와 연결된 상태이며 다른 파라미터는 조정할 필요가 없습니다. 카메라에서 이미지를 캡처하기 스텝 오른쪽에 있는

아이콘을 클릭하여 이 스텝을 실행합니다. 오류가 없으면 카메라 연결이 성공했으며, 정상적으로 이미지를 캡처할 수 있음을 의미합니다.

아이콘을 클릭하여 이 스텝을 실행합니다. 오류가 없으면 카메라 연결이 성공했으며, 정상적으로 이미지를 캡처할 수 있음을 의미합니다.

3D 대상 물체 인식 (대상 물체 인식)

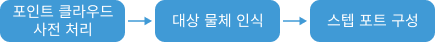

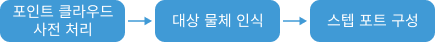

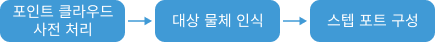

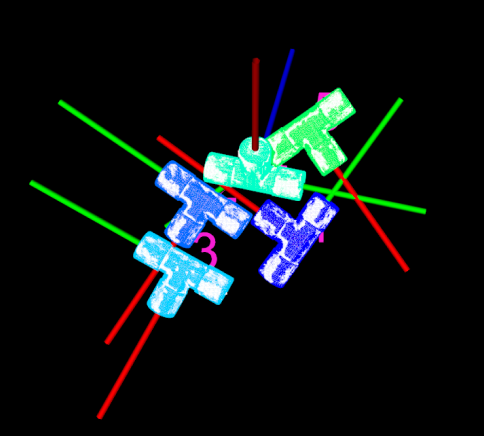

깊은 빈 내의 작은 금속 부품 솔루션은 3D 대상 물체 인식 스텝을 사용하여 대상 물체를 인식합니다. 3D 대상 물체 인식 스텝 화면의 구성 마법사 버튼을 클릭하여 3D 대상 물체 인식 도구를 열고 관련된 구성을 설정합니다. 구성 프로세스는 아래 그림과 같습니다.

포인트 클라우드 사전 처리

포인트 클라우드 사전 처리 단계에서 파라미터를 조정하여 원시 포인트 클라우드를 더 선명하게 만들어 데이터를 사전 처리해야 하며, 이를 통해 인식 정확도와 효율성을 높일 수 있습니다.

-

인식 효율성을 높이기 위해 효과적인 인식 영역을 설정하여 간섭 요인이 해당 영역에 들어오지 않도록 합니다.

-

가장자리 추출 효과, 노이즈 제거 레벨, 포인트를 필터링하기 파라미터를 설정하여 노이즈를 필터링합니다.

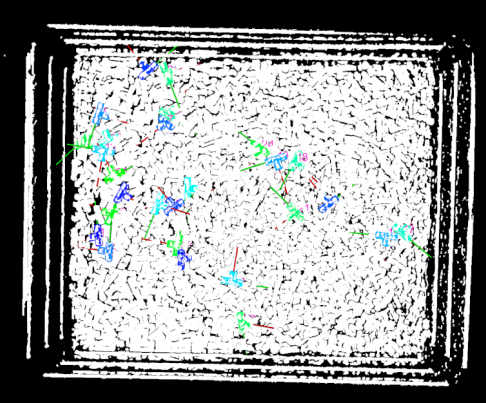

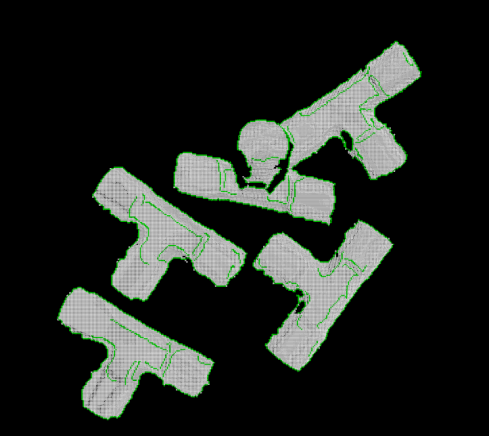

포인트 클라우드 사전 처리가 완료된 후 스텝 실행 버튼을 클릭하면 사전 처리 효과가 아래 그림과 같이 나타납니다.

대상 물체 인식

포인트 클라우드 사전 처리 후에는 대상 물체 편집기에서 대상 물체의 포인트 클라우드 모델을 생성한 다음, 포인트 클라우드 모델 매칭을 위한 3D 대상 물체 인식 도구에서 매칭 파라미터를 설정해야 합니다.

-

대상 물체 모델을 만듭니다.

-

포인트 클라우드 모델 제작하고 픽 포인트를 추가합니다. 대상 물체 편집기를 열기 버튼을 클릭하여 대상 물체 편집기 화면을 엽니다. 이후, STL 파일을 가져와 대상 물체 포인트 클라우드 모델을 생성하고 픽 포인트를 수동으로 구성합니다.

-

-

-

대상 물체 인식 버튼 오른쪽의 고급 모드를 활성화합니다.

-

매칭 모드: 매칭 모드 자동 설정를 활성화합니다. 활성화한 후 이 스텝은 자동적으로 근사 매칭과 상세 매칭의 파라미터를 조정합니다.

-

근사 매칭 설정: 매칭에 소요되는 시간을 줄이려면 근사 매칭의 실행 방법을 사용자 정의로 설정하고 모델 포인트 클라우드 포인트 수의 목표값을 200으로 설정하여 인식 속도를 향상시킵니다.

-

신뢰도 설정: 대상 물체 인식의 정확도를 높이려면 신뢰도 전략을 수동으로 설정하고 다음 파라미터를 조정하세요.

-

공동 채점 전략을 표면과 가장자리 모두 고려로 설정합니다.

-

표면 매칭 신뢰도 임계값을 0.5000로 설정하고 가장자리 매칭 신뢰도 임계값을 0.1000로 설정합니다.

-

왼쪽 시각화 창 하단의 인식 결과 표시 영역에서 첫 번째 드롭다운 메뉴에서 출력 결과를 선택합니다. 표면 매칭 신뢰도와 가장자리 매칭 신뢰도 값이 모두 설정된 임계값을 초과하는 대상 물체는 유지됩니다. 작업 현장의 실제 상황에 따라 인식 결과를 확인하세요. 잘못 인식하거나 누락된 대상 물체가 있는 경우, 해당 임계값을 높이거나 낮춰주세요.

-

신뢰도 전략 파라미터를 조정할 때는 먼저 Auto로 설정된 인식 결과를 확인합니다. 신뢰도 임계값을 조정한 후에도 인식 결과가 여전히 현장 요구 사항을 충족하지 못하고 시각화 창 하단에 표시된 표면 매칭 신뢰도 임계값과가장자리 매칭 신뢰도 임계값 사이에 상당한 불일치가 있는 경우 신뢰도 전략을 Manual로 설정하고 관련 파라미터를 조정하는 것이 좋습니다.

-

-

-

출력-최대 출력: 경로 계획의 수요를 충족한다는 전제 조건으로 최대한으로 출력 결과 수를 감소하여 매칭 시간을 줄입니다. 이 솔루션에서는 최대 출력 값을 30개로 설정되었습니다.

-

위의 파라미터 설정이 완료된 후 스텝 실행 버튼을 클릭하면 매칭 효과가 아래 그림과 같이 나타납니다.

스텝 포트 구성

대상 물체 인식을 완료한 후에는 경로 계획 및 충돌 감지를 위한 Mech-Viz에 대한 비전 결과와 포인트 클라우드를 제공하도록 스텝 포트를 구성해야 합니다.

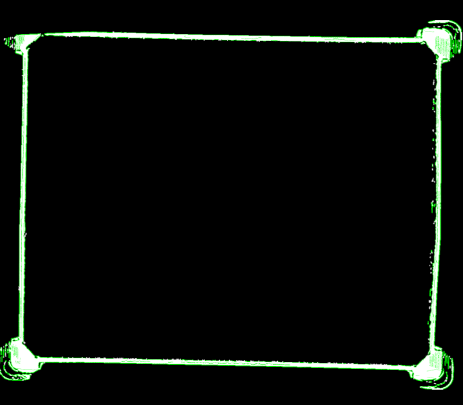

로봇이 대상 물체를 성공적으로 피킹할 수 있도록 하려면 대상 물체의 중심점을 조정하여 Z축 방향이 위를 향하도록 합니다. 포트 선택에서 대상 물체 중심점 관련 포트 옵션을 체크합니다. 빈을 인식하고 빈의 위치를 지정하기 위해 사전 처리 후의 포인트 클라우드 옵션을 체크해야 합니다. 마지막으로 저장 버튼을 클릭합니다. 설정 완료 후 3D 대상 물체 인식 스텝에 해당 출력 포트가 추가되었으며, 아래 그림과 같습니다.

3D 대상 물체 인식(빈 인식)

이 솔루션은 3D 대상 물체 인식 스텝을 사용하여 빈을 인식합니다. 3D 대상 물체 인식 스텝 화면의 구성 마법사 버튼을 클릭하여 3D 대상 물체 인식 도구를 열고 관련된 구성을 설정합니다. 구성 프로세스는 아래 그림과 같습니다.

포인트 클라우드 사전 처리

포인트 클라우드 사전 처리 단계에서 파라미터를 조정하여 원시 포인트 클라우드를 더 선명하게 만들어 데이터를 사전 처리해야 하며, 이를 통해 인식 정확도와 효율성을 높일 수 있습니다.

-

인식 효율성을 높이기 위해 효과적인 인식 영역을 설정하여 간섭 요인이 해당 영역에 들어오지 않도록 합니다.

-

가장자리 추출 효과, 노이즈 제거 레벨, 포인트를 필터링하기 파라미터를 설정하여 노이즈를 필터링합니다.

포인트 클라우드 사전 처리가 완료된 후 스텝 실행 버튼을 클릭하면 사전 처리 효과가 아래 그림과 같이 나타납니다.

대상 물체 인식

포인트 클라우드 사전 처리 후에는 대상 물체 편집기에서 빈의 포인트 클라우드 모델을 생성한 다음, 포인트 클라우드 모델 매칭을 위한 3D 대상 물체 인식 도구에서 매칭 파라미터를 설정해야 합니다.

-

대상 물체 모델을 만듭니다.

포인트 클라우드 모델 제작하고 픽 포인트를 추가합니다. 대상 물체 편집기를 열기 버튼을 클릭하여 대상 물체 편집기 화면을 엽니다. 이후, 카메라로 포인트 클라우드를 캡처하여 포인트 클라우드 모델을 생성하고 픽 포인트를 수동으로 구성합니다.

-

인식과 관련된 파라미터를 설정합니다.

-

매칭 모드: 매칭 모드 자동 설정를 활성화합니다.

-

신뢰도 설정: 신뢰도 임계값을 0.8로 설정하여 잘못된 매칭 결과를 제거합니다.

-

출력-최대 출력: 대상 물체가 빈이므로 최대 출력은 1로 설정해야 합니다.

-

위의 파라미터 설정이 완료된 후 스텝 실행 버튼을 클릭하면 매칭 효과가 아래 그림과 같이 나타납니다.

포즈 조정(대상 물체 포즈)

대상 물체 포즈를 획득한 후 포즈 조정 V2 스텝을 사용하여 포즈를 조정해야 합니다. 포즈 조정 V2 스텝 화면의 구성 마법사 버튼을 클릭하여 포즈 조정 도구를 열고 포즈 조정을 구성합니다. 구성 프로세스는 아래 그림과 같습니다.

-

로봇 좌표계에서 대상 물체의 포즈를 출력하려면, 포즈를 로봇 좌표계로 전환을 선택해야 하며, 이를 통해 대상 물체의 포즈가 카메라 좌표계에서 로봇 좌표계로 변환됩니다.

-

대상 물체의 포즈를 조정하여 Z축 방향이 위를 향하고, Y축이 로봇 좌표계의 X축 음의 방향을 가리키도록 함으로써, 로봇이 지정된 방향으로 대상 물체를 피킹할 수 있도록 하고, 충돌을 방지합니다.

-

포즈 조정의 사용자 정의 모드를 활성화합니다.

-

포즈를 뒤집고 뒤집기 축과 대상 방향 사이의 각도를 최소화하기의 파라미터를 설정하기: 고정할 축은 X축으로 설정하고 뒤집을 축은 Z축으로 설정합니다. 로봇 좌표계의 Z축 양의 방향을 목표 방향으로 설정합니다.

-

포즈를 회전하고 회전축과 대상 방향 사이의 각도를 최소화하기의 파라미터를 설정하기: 고정할 축은 Z축으로 설정하고 회전할 축은 Y축으로 설정합니다. 로봇 좌표계의 X축의 음의 방향을 设목표 방향으로 설정합니다.

-

-

정렬 유형은 포즈의 XYZ 값으로 정렬로 설정하고 포즈의 지정된 값은 Z 값으로 설정합니다. 포즈를 내림차순으로 정렬합니다.

-

후속 경로 계획의 시간을 줄이기 위해, 포즈의 Z축과 기준 방향 사이의 각도를 기준으로 명백하게 피킹할 수 없는 대상 물체를 필터링해야 합니다. 이 예시에서는 최대 각도 차이는 90°로 설정해야 합니다.

ROI를 설정하며 ROI 밖에 있는 피킹할 수 없는 포즈를 필터링합니다.

-

일반 설정.

새 포트 수 설정은 1로 설정하고 스텝에 입력 및 출력 포트가 각각 하나씩 추가되며 3D 대상 물체 인식 스텝이 출력한 대상 물체 이름을 연결하고 이를 출력 스텝으로 출력하십시오.

포즈 조정 (빈의 포즈)

빈 포즈를 획득한 후 포즈 조정 V2 스텝을 사용하여 포즈를 조정해야 합니다. 포즈 조정 V2 스텝 화면의 구성 마법사 버튼을 클릭하여 포즈 조정 도구를 열고 포즈 조정을 구성합니다. 구성 프로세스는 아래 그림과 같습니다.

-

포즈 처리 전략 선택.

대상 물체가 대상 물체를 담는 깊은 빈이므로, 빈 옵션을 선택해야 합니다.

-

로봇 좌표계에서 빈의 포즈를 출력하려면, 포즈를 로봇 좌표계로 전환을 선택해야 하며, 이를 통해 빈의 포즈가 카메라 좌표계에서 로봇 좌표계로 변환됩니다.

-

로봇 베이스 좌표계에서 Z축 양의 방향에 따라 빈 포즈를 이동시키고 수동으로 평행이동 거리를 -245mm로 조정하여 빈 포즈를 빈 상단 표면에서 아래쪽으로 빈 중심으로 이동시킵니다. 이후 빈 충돌 모델 위치를 Mech-Viz에서 업데이트하는 데 사용됩니다.

평행이동 거리의 값 = -1 × 1/2 빈 높이. -

후속 경로 계획의 시간을 줄이기 위해, 포즈의 Z축과 기준 방향 사이의 각도를 기준으로 명백하게 피킹할 수 없는 대상 물체를 필터링해야 합니다. 이 예시에서는 최대 각도 차이는 90°로 설정해야 합니다.

-

일반 설정.

새 포트 수 설정은 1로 설정하고 스텝에 입력 및 출력 포트가 각각 하나씩 추가되며 3D 대상 물체 인식 스텝이 출력한 대상 물체 이름을 연결하고 이를 출력 스텝으로 출력하십시오.

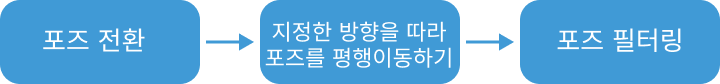

이차 위치 결정 스테이션 위의 작은 부품

이 비전 프로젝트를 구성하는 방법의 프로세스는 아래 그림과 같습니다.

카메라 연결 및 이미지 캡처

-

카메라를 연결합니다.

Mech-Eye Viewer를 열어 연결할 카메라를 찾은 후 연결 버튼을 클릭하십시오.

-

카메라 파라미터를 조정합니다.

카메라로 캡처한 2D 이미지가 선명하고 포인트 클라우드가 누락되지 않았는지 확인하려면 카메라 파라미터를 조정해야 합니다. 파라미터 조정 방법은 PRO S-GL 카메라 파라미터에 관한 설명을 참조하십시오.

-

이미지를 캡처합니다.

카메라가 성공적으로 연결되고 파라미터 그룹이 설정되면 대상 물체의 이미지 캡처를 시작할 수 있습니다. 인터페이스 상단의

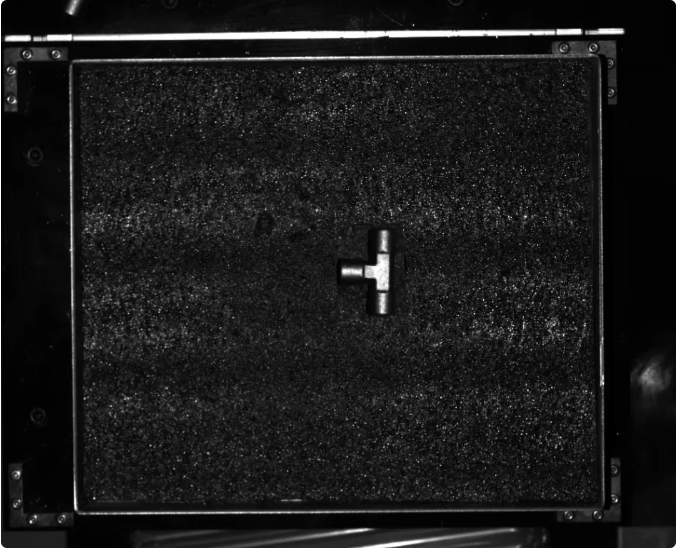

버튼을 클릭하여 단일 이미지를 획득합니다. 이때 획득한 대상 물체의 2D 이미지와 포인트 클라우드를 확인할 수 있어 2D 이미지가 선명하고 포인트 클라우드가 누락되지 않았으며 에지가 선명한지 확인할 수 있습니다. 검증된 대상 물체의 2D 이미지와 포인트 클라우드는 다음 그림의 왼쪽 및 오른쪽 이미지에 각각 표시됩니다.

버튼을 클릭하여 단일 이미지를 획득합니다. 이때 획득한 대상 물체의 2D 이미지와 포인트 클라우드를 확인할 수 있어 2D 이미지가 선명하고 포인트 클라우드가 누락되지 않았으며 에지가 선명한지 확인할 수 있습니다. 검증된 대상 물체의 2D 이미지와 포인트 클라우드는 다음 그림의 왼쪽 및 오른쪽 이미지에 각각 표시됩니다.

-

Mech-Vision에서 카메라를 연결합니다.

카메라에서 이미지를 캡처하기 스텝을 선택하고 인터페이스의 오른쪽 하단 모서리에 있는 스텝 파라미터에서 가상 모드를 닫고 카메라를 선택하기를 클릭합니다. 팝업 창에서 카메라 번호 오른쪽에 있는

아이콘을 클릭하고 아이콘이

아이콘을 클릭하고 아이콘이  로 바뀌면 카메라가 성공적으로 연결되었음을 나타냅니다. 카메라 연결에 성공한 후, 오른쪽의 파라미터 그룹 드롭다운에서 캘리브레이션 파라미터 그룹을 선택하세요.

로 바뀌면 카메라가 성공적으로 연결되었음을 나타냅니다. 카메라 연결에 성공한 후, 오른쪽의 파라미터 그룹 드롭다운에서 캘리브레이션 파라미터 그룹을 선택하세요.위 설정이 완료되면 실제 카메라와 연결된 상태이며 다른 파라미터는 조정할 필요가 없습니다. 카메라에서 이미지를 캡처하기 스텝 오른쪽에 있는

아이콘을 클릭하여 이 스텝을 실행합니다. 오류가 없으면 카메라 연결이 성공했으며, 정상적으로 이미지를 캡처할 수 있음을 의미합니다.

아이콘을 클릭하여 이 스텝을 실행합니다. 오류가 없으면 카메라 연결이 성공했으며, 정상적으로 이미지를 캡처할 수 있음을 의미합니다.

3D 대상 물체 인식 (대상 물체 인식)

깊은 빈 내의 작은 금속 부품 솔루션은 3D 대상 물체 인식 스텝을 사용하여 대상 물체를 인식합니다. 3D 대상 물체 인식 스텝 화면의 구성 마법사 버튼을 클릭하여 3D 대상 물체 인식 도구를 열고 관련된 구성을 설정합니다. 구성 프로세스는 아래 그림과 같습니다.

포인트 클라우드 사전 처리

포인트 클라우드 사전 처리 단계에서 파라미터를 조정하여 원시 포인트 클라우드를 더 선명하게 만들어 데이터를 사전 처리해야 하며, 이를 통해 인식 정확도와 효율성을 높일 수 있습니다.

-

인식 효율성을 높이기 위해 효과적인 인식 영역을 설정하여 간섭 요인이 해당 영역에 들어오지 않도록 합니다.

-

가장자리 추출 효과, 노이즈 제거 레벨, 포인트를 필터링하기 파라미터를 설정하여 노이즈를 필터링합니다.

포인트 클라우드 사전 처리가 완료된 후 스텝 실행 버튼을 클릭하면 사전 처리 효과가 아래 그림과 같이 나타납니다.

대상 물체 인식

포인트 클라우드 사전 처리 후에는 대상 물체 편집기에서 대상 물체의 포인트 클라우드 모델을 생성한 다음, 포인트 클라우드 모델 매칭을 위한 3D 대상 물체 인식 도구에서 매칭 파라미터를 설정해야 합니다.

-

대상 물체 모델을 만듭니다.

-

포인트 클라우드 모델 제작하고 픽 포인트를 추가합니다. 대상 물체 편집기를 열기 버튼을 클릭하여 대상 물체 편집기 화면을 엽니다. 이후, 카메라로 포인트 클라우드를 캡처하여 포인트 클라우드 모델을 생성하고 픽 포인트를 수동으로 구성합니다.

-

-

-

대상 물체 인식 버튼 오른쪽의 고급 모드를 활성화합니다.

-

매칭 모드: 매칭 모드 자동 설정를 활성화합니다. 활성화한 후 이 스텝은 자동적으로 근사 매칭과 상세 매칭의 파라미터를 조정합니다.

-

근사 매칭 설정: 매칭에 소요되는 시간을 줄이려면 근사 매칭의 실행 방법을 고속으로 설정하여 인식 속도를 향상시킵니다.

-

신뢰도 설정: 대상 물체 인식의 정확도를 높이려면 신뢰도 전략을 수동으로 설정하고 다음 파라미터를 조정하세요.

-

공동 채점 전략을 표면과 가장자리 모두 고려로 설정합니다.

-

표면 매칭 신뢰도 임계값을 0.8000로 설정하고 가장자리 매칭 신뢰도 임계값을 0.4000로 설정합니다.

-

-

출력-최대 출력: 경로 계획의 수요를 충족한다는 전제 조건으로 최대한으로 출력 결과 수를 감소하여 매칭 시간을 줄입니다. 이 솔루션에서는 최대 출력 값을 10개로 설정되었습니다.

-

위의 파라미터 설정이 완료된 후 스텝 실행 버튼을 클릭하면 매칭 효과가 아래 그림과 같이 나타납니다.

스텝 포트 구성

대상 물체 인식을 완료한 후에는 경로 계획 및 충돌 감지를 위한 Mech-Viz에 대한 비전 결과와 포인트 클라우드를 제공하도록 스텝 포트를 구성해야 합니다.

로봇이 대상 물체를 성공적으로 피킹할 수 있도록 하려면 대상 물체의 중심점을 조정하여 Z축 방향이 위를 향하도록 합니다. 포트 선택에서 대상 물체 중심점 관련 포트 옵션을 체크합니다. 빈을 인식하고 빈의 위치를 지정하기 위해 사전 처리 후의 포인트 클라우드 옵션을 체크해야 합니다. 마지막으로 저장 버튼을 클릭합니다. 설정 완료 후 3D 대상 물체 인식 스텝에 해당 출력 포트가 추가되었으며, 아래 그림과 같습니다.

포즈 조정

대상 물체 포즈를 획득한 후 포즈 조정 V2 스텝을 사용하여 포즈를 조정해야 합니다. 포즈 조정 V2 스텝 화면의 구성 마법사 버튼을 클릭하여 포즈 조정 도구를 열고 포즈 조정을 구성합니다. 구성 프로세스는 아래 그림과 같습니다.

-

로봇 좌표계에서 대상 물체의 포즈를 출력하려면, 포즈를 로봇 좌표계로 전환을 선택해야 하며, 이를 통해 대상 물체의 포즈가 카메라 좌표계에서 로봇 좌표계로 변환됩니다.

-

로봇이 지정된 방향으로 대상 물체를 피킹하고 충돌을 피할 수 있도록 방향 조정을 자동 정렬로 설정하고 응용 시나리오를 Z축 정렬(머신 텐딩)으로 설정하세요.

-

정렬 유형은 포즈의 XYZ 값으로 정렬로 설정하고 포즈의 지정된 값은 Z 값으로 설정합니다. 포즈를 내림차순으로 정렬합니다.

-

후속 경로 계획의 시간을 줄이기 위해, 포즈의 Z축과 기준 방향 사이의 각도를 기준으로 명백하게 피킹할 수 없는 대상 물체를 필터링해야 합니다. 이 예시에서는 최대 각도 차이는 90°로 설정해야 합니다.

ROI를 설정하며 ROI 밖에 있는 피킹할 수 없는 포즈를 필터링합니다.

-

일반 설정.

새 포트 수 설정은 1로 설정하고 스텝에 입력 및 출력 포트가 각각 하나씩 추가되며 3D 대상 물체 인식 스텝이 출력한 대상 물체 이름을 연결하고 이를 출력 스텝으로 출력하십시오.

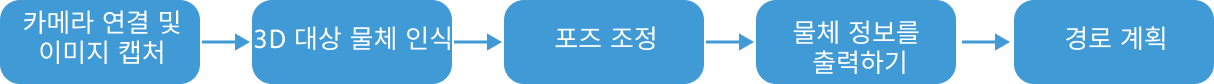

경로 계획

대상 물체 인식이 완료되면 Mech-Viz를 사용하여 경로를 계획하고 이후 로봇 프로그램을 작성하여 대상 물체를 피킹합니다.

경로 계획 구성 프로세스는 다음 그림과 같습니다.

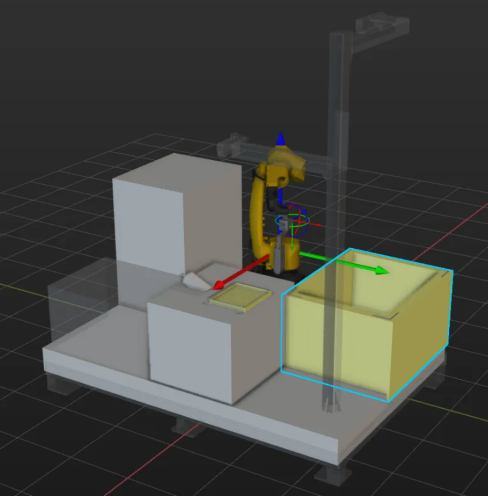

시나리오 물체 구성

시나리오 모델 구성의 목적은 실제 시나리오 복원을 통해 사용자가 로봇 모션 경로를 계획하는 데 도움이 주는 데에 있습니다. 구체적인 작업 밥법은 시나리오 물체 구성을 참조하십시오.

피킹 가능성을 확보한 후, 실제 작업 환경을 엄격하게 재현하는 전제하에 시나리오 물체를 구성해야 합니다. 이 솔루션의 시나리오 물체 구성은 다음 그림과 같습니다.

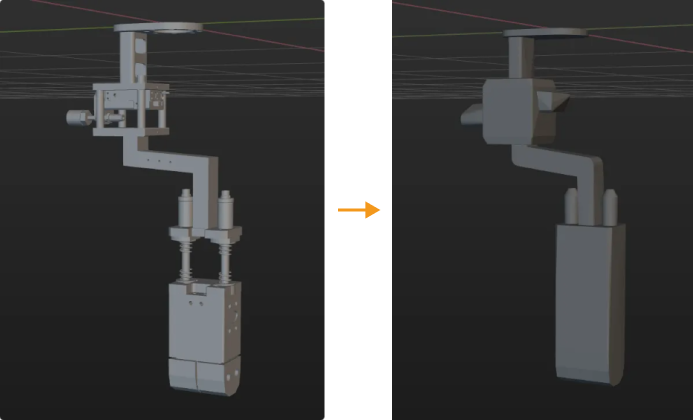

말단장치 구성

말단장치를 구성하는 목적은 3D 시뮬레이션 공간에서 말단장치의 모델을 표시하여 충돌 감지에 사용하는 것입니다. 구체적인 작업 밥법은 말단장치 구성을 참조하십시오.

|

작업 흐름 조정

작업 흐름이란 Mech-Viz에서 플로우 차트의 식으로 구축되는 로봇 이동 컨트롤 프로그램입니다. 시나리오 물체와 말단장치의 구성이 완료 후 실제 요구에 따라 프로젝트의 작업 흐름을 조정할 수 있습니다. 대상 물체를 피킹할 때의 논리 처리 플로우 차트는 아래 그림과 같습니다.

Mech-Viz 프로젝트는 다음의 두 가지 분기로 구성됩니다:

-

첫 번째 분기는 Mech-Vision에서 깊은 빈 내의 작은 금속 부품 인식 프로젝트의 후속 피킹 프로세스에 해당합니다. 비전 인식 스텝을 통해 해당 프로젝트를 트리거하고 깊은 빈 내의 작은 금속 부품의 포즈를 Mech-Viz에 전달하여 경로를 계획하고, 이를 이차 위치 결정 스테이션에 배치하는 명령어를 실행합니다.

-

두 번째 분기는 Mech-Vision에서 이차 위치 결정 스테이션 위의 작은 부품 인식 프로젝트의 후속 피킹 프로세스에 해당합니다. 비전 인식 스텝을 통해 해당 프로젝트를 트리거하고 이차 위치 결정 스테이션 위의 작은 부품 포즈를 Mech-Viz에 전달하여 경로를 계획하고, 이를 정렬 스테이션에 배치하는 명령어를 실행합니다.

-

이차 위치 결정 스테이션 위의 소형 부품 피킹이 완료되면, 시작 분기를 다시 실행하여 전체 프로세스를 반복하고, 모든 소형 부품이 피킹될 때까지 순환합니다.

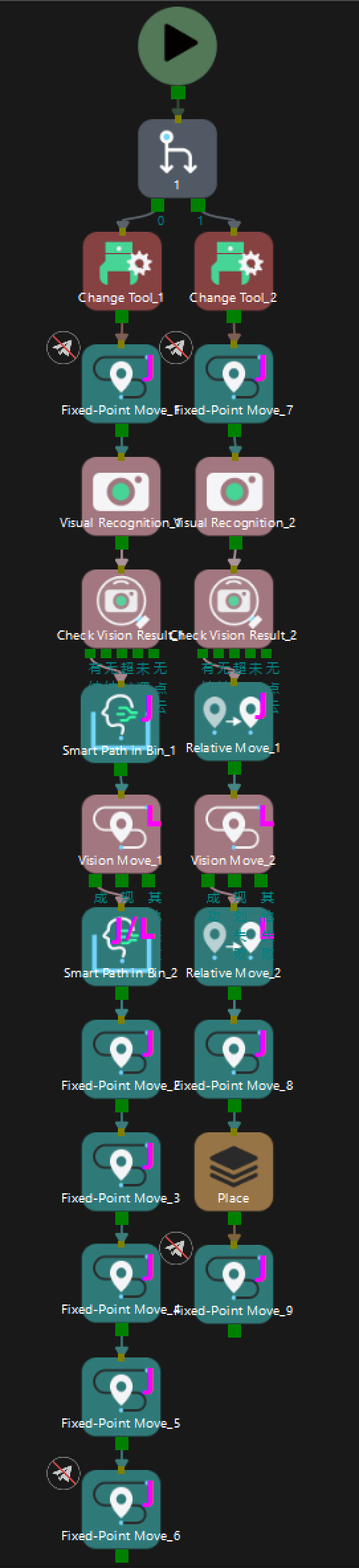

이 프로젝트 구체적인 작업 흐름은 다음 그림과 같습니다.

그 중 작업 흐름의 시작과 끝에 있는 두 개의 고정점 이동 스텝은 티칭 포인트이므로 외부로 전송할 필요가 없습니다. 다른 이동 스텝은 웨이포인트를 외부로 보냅니다. 각 빈에서 스마트 경로 계획 스텝은 두 개의 웨이포인트에 해당하며,분기1은 총 9개의 웨이포인트를 전송하고, 분기2는 총 7개의 웨이포인트를 전송합니다.

시뮬레이션 및 테스트

툴 바의 시뮬레이션 버튼을 클릭하면 구축이 완료된 Mech-Viz 프로젝트를 시뮬레이션하여 비전 시스템이 성공적으로 구축되었는지 테스트할 수 있습니다.

대상 물체를 무작위로 빈에 놓은 다음 Mech-Viz 툴 바의 시뮬레이션 버튼을 클릭하여 대상 물체를 피킹하는 동작을 시뮬레이션합니다. 피킹을 성공 할 때마다 대상 물체를 다시 정렬해야 하며, 피킹 루프를 10번 시뮬레이션합니다. 만약 10번의 시뮬레이션 피킹에서 다 원활하게 진행되었다면 비전 시스템은 정상적이로 작동할 수 있다는 것으로 판단될 수 있습니다.

시뮬레이션 과정에서 오류가 발생하는 경우 솔루션 배포 일반적인 문제를 참조하여 문제를 해결하십시오.

로봇 픽 앤 플레이스

로봇 프로그래밍 작성

시뮬레이션 효과가 기대에 부합하면 FANUC 로봇 피킹 및 배치 프로그램을 작성할 수 있습니다.

FANUC 로봇 샘플 프로그램 MM_S10_Viz_Subtask는 거의 이 일반적인 솔루션에 필요한 모든 기능을 사용할 수 있습니다. 이 예제 프로그램을 기반으로 수정할 수 있습니다. 이 프로그램에 대한 자세한 설명은 S10샘플 프로그램 설명을 참조하세요.

수정 설명

이 샘플은 두 개의 프로그램으로 구성되어 있습니다. 그 중, 서브 프로그램은 Mech-Viz 프로젝트 실행을 트리거하고 계획된 경로를 가져오며 깊은 빈 내의 작은 금속 부품을 피킹합니다. 메인 프로그램은 계획된 경로에 따라 로봇을 이동시키며, 로봇이 피킹 영역에 떠날 때 서브 프로그램을 실행하여 다음 라운드 경로를 미리 계획하여 사이클 타임을 단축합니다. 샘플 프로그램을 기반으로 다음 단계에 따라 프로그램 파일을 수정하세요.

-

서브 프로그램

-

분기 명령어를 추가하여 카메라 이미지 캡처를 트리거합니다.

수정 전 수정 후(예시) 10: !trigger {product-viz} project ; 11: **CALL MM_START_VIZ(2,10)** ; 12: !get planned path, 1st argument ; 13: !(1) means getting pose in JPs ; 14: **CALL MM_GET_VIZ(1,51,52,53)** ;10: !trigger {product-viz} project ; 11: CALL MM_START_VIZ(2,10) ; 12: WAIT .10(sec) ; 13: !(Branch_Num,Exit_Num)" ; 14: CALL MM_SET_BCH(1,1) ; 15: !get planned path, 1st argument ; 16: !(1) means getting pose in JPs ; 17: CALL MM_GET_VIZ(1,51,52,53) ; -

계획 경로 저장 명령어를 추가해야 반환된 모든 웨이포인트를 로컬 변수에 저장합니다.

Mech-Viz에서 돌아온 계획 경로는 Enter-bin 포인트, 접근 포인트, 픽 포인트, 출발 포인트, Exit-bin 포인트, 흔들림 포인트 1, 흔들림 포인트 2, Exit-bin 포인트, 배치 포인트 총 9개 웨이포인트를 포함합니다. 샘플 프로그램은 웨이포인트 3개만 저장하므로 계획 경로 명령어를 추가해야 합니다. 수정 전 수정 후(예시) 22: CALL MM_GET_JPS(1,60,70,80) ; 23: CALL MM_GET_JPS(2,61,71,81) ; 24: CALL MM_GET_JPS(3,62,72,82) ;

25: CALL MM_GET_JPS(1,60,70,80) ; 26: CALL MM_GET_JPS(2,61,71,81) ; 27: CALL MM_GET_JPS(3,62,72,82) ; 28: CALL MM_GET_JPS(4,63,70,80) ; 29: CALL MM_GET_JPS(5,64,71,81) ; 30: CALL MM_GET_JPS(6,65,72,82) ; 31: CALL MM_GET_JPS(7,66,70,80) ; 32: CALL MM_GET_JPS(8,67,71,81) ; 33: CALL MM_GET_JPS(9,68,72,82) ;

-

-

메인 프로그램

-

말단장치 좌표계를 설정합니다. 로봇 티치 펜던트의 TCP과 Mech-Viz 중의 TCP 데이터가 일치하는지 확인합니다. 현재 선정된 말단장치 좌표계 번호를 실제 사용되는 그리퍼가 위치한 좌표계로 설정합니다.

수정 전 수정 후(예시) 9: !set current tool NO. to 1 ; 10: UTOOL_NUM=1 ;

9: !set current tool NO. to 3 ; 10: UTOOL_NUM=3 ;

해당 숫자를 실제로 사용하고 있는 말단장치의 번호로 바꿔주세요. 여기서 "3"은 단지 예일 뿐입니다. -

IPC의 IP 주소와 포트 번호를 지정합니다. CALL MM_INIT_SKT 명령어 중의 IP 주소와 포트 번호를 IPC 실제 IP 주소와 포트 번호로 수정합니다. 비전 시스템의 설정이 일치하도록 해야 합니다.

수정 전 수정 후(예시) 16: CALL MM_INIT_SKT('8','127.0.0.1',50000,5) ;16: CALL MM_INIT_SKT('8','127.1.1.2',50000,6) ; -

Enter-bin 포인트, 접근 포인트, 픽 포인트, 출발 포인트, Exit-bin 포인트, 흔들림 포인트 1, 흔들림 포인트 2, Exit-bin 포인트, 배치 포인트의 위치 레지스터 번호를 설정합니다.

수정 전 수정 후 32: !move to approach waypoint ; 33: !of picking ; 34:J PR[60] 50% FINE ; 35: !move to picking waypoint ; 36:J PR[61] 10% FINE ; ... 40: !move to departure waypoint ; 41: !of picking ; 42:J PR[62] 50% FINE ; 43: !move to intermediate waypoint ; 44: !of placing, and trigger {product-viz} ; 45: !project and get planned path in ; 46: !advance ; 47:J P[3] 50% CNT100 DB 10.0mm,CALL MM_S10_SUB ; 48: !move to approach waypoint ; 49: !of placing ; 50:L P[4] 1000mm/sec FINE Tool_Offset,PR[2] ; 51: !move to placing waypoint ; 52:L P[4] 300mm/sec FINE ;l

32: !move to approach waypoint ; 33: !of picking ; 34: J PR[60] 100% CNT100 ; 35: J PR[61] 100% CNT100 ; 36: !move to picking waypoint ; 37: L PR[62] 200mm/sec FINE ; ... 42: !move to departure waypoint ; 43: !of picking ; 44: L PR[63] 500mm/sec CNT100 ; 45: J PR[64] 100% CNT100 ; 46: !Shake ; 47: J PR[65] 100% CNT40 ; 48: J PR[66] 100% CNT40 ; 49: J PR[65] 100% CNT40 ; 50: J PR[66] 100% CNT40 ; 51: !move to intermediate waypoint ; 52: !of placing, and trigger Mech-Viz ; 53: !project and get planned path in ; 54: !advance ; 55: J PR[67] 100% CNT40 ; 56: CALL MM_S10_SUB ; 57: !move to approach waypoint ; 58: !of placing ; 59: J PR[68] 100% FINE ;

수정된 샘플 프로그램에서 PR[60]은 Enter-bin 포인트이고, PR[61]은 피킹 접근 포인트, PR[62]는 픽 포인트, PR[63]은 피킹 출발 포인트, PR[64]는 Exit-bin 포인트, PR[65] 및 PR[66]은 흔들림 포인트, PR[67]은 Exit-bin 포인트, PR[68]은 배치 포인트입니다. -

DO 포트 피킹을 수행하는 신호를 설정하여 그리퍼를 통해서 대상 물체를 피킹합니다. DO 명령어는 현장에서 실제 사용되는 DO 포트 번호에 따라 설정해야 합니다.

수정 전 수정 후(예시) 37: !add object grasping logic here, ; 38: !such as "DO[1]=ON" ; 39: PAUSE ;

38: !Add object grasping logic here ; 39: DO[107]=ON ; 40: DO[108]=OFF ; 41: WAIT .50(sec) ;

-

DO 포트 배치하는 신호를 설정하여 대상 물체를 배치합니다. DO 명령어는 현장에서 실제 사용되는 DO 포트 번호에 따라 설정해야 합니다.

수정 전 수정 후(예시) 53: !add object releasing logic here, ; 54: !such as "DO[1]=OFF" ; 55: PAUSE ;

60: !add object releasing logic here, ; 61: !such as "DO[0]=OFF" ; 62: WAIT .50(sec) ; 63: DO[107]=OFF ; 64: DO[108]=ON ; 65: WAIT 1.00(sec) ;

-

로봇을 이차 위치 결정 스테이션의 피킹 대기 위치로 이동합니다.

수정 전 수정 후(예시) 56: !move to departure waypoint ; 57: !of placing ; 58:L P[4] 1000mm/sec FINE Tool_Offset,PR[2] ;

66: !move to departure waypoint ; 67: !of placing ; 68: !Move to HOME2 Position ; 69: J P[3:HOME2] 100% FINE ;

-

| 이차 위치 결정 스테이션에서의 로봇 소형 부품 피킹 프로그램 수정 로직은 앞서 설명한 내용을 참고하십시오. 여기서는 생략합니다. |

피킹 테스트

실제 생산의 안정적인 운영을 보장하기 위해 수정된 샘플 프로그램을 실행하여 로봇이 대상 물체를 피킹하는 테스트를 진행해야 합니다. 구체적인 방법은 표준 인터페이스 통신 테스트를 참조하세요.

피킹 테스트 하기전에 먼저 다음 포인트를 티칭으로 설정하십시오.

| 명칭 | 변수 | 설명 |

|---|---|---|

Home 포인트 |

P[1] |

깊은 빈 내 티칭을 시작하는 초기 위치입니다. 원점은 대상 물체나 주변 설비와 멀리 떨어져 있어야 하며 카메라 시야를 가리지 않아야 합니다. |

이미지 캡처 포인트 |

P[2] |

티칭으로 설정한 이미지 캡처 위치. 이미지 캡처 위치는 카메라가 이미지를 캡처할 때 로봇이 있는 위치를 의미합니다. 이 위치에서는 로봇 팔이 카메라 시야를 가리지 않아야 합니다. |

배치의 중간 웨이포인트 |

P[3:HOME2] |

이차 위치 결정 스테이션의 티칭을 시작하는 초기 위치입니다. 원점은 대상 물체나 주변 설비와 멀리 떨어져 있어야 하며 카메라 시야를 가리지 않아야 합니다. |

티칭이 완료된 후, 아래 표에 나열된 시나리오에 대상 물체를 배치하고, 순서대로 로봇을 사용하여 저속 피킹을 테스트합니다.

피킹 테스트는 두 단계로 나뉘며, 첫 번째는 빈 내 피킹이고 두 번째는 이차 위치 결정 스테이션에서의 피킹입니다.

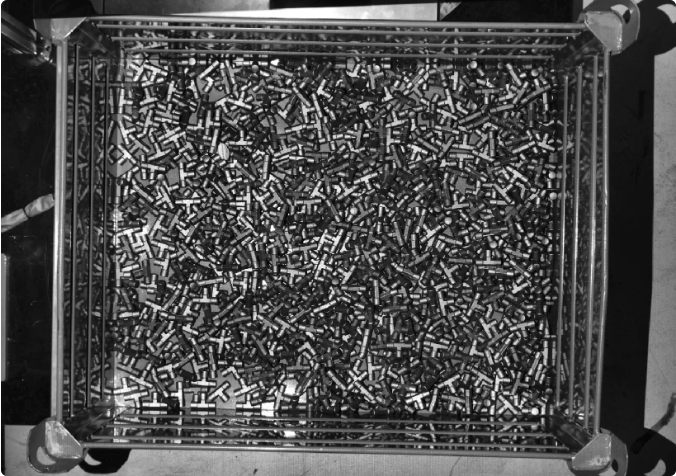

단계1: 빈 내 피킹 테스트

빈 내 피킹은 대상 물체를 완전히 피킹하는 것을 요구하지 않으므로, 실제 무질서 시나리오에서 저속 피킹 루프를 5회만 수행하면 됩니다.

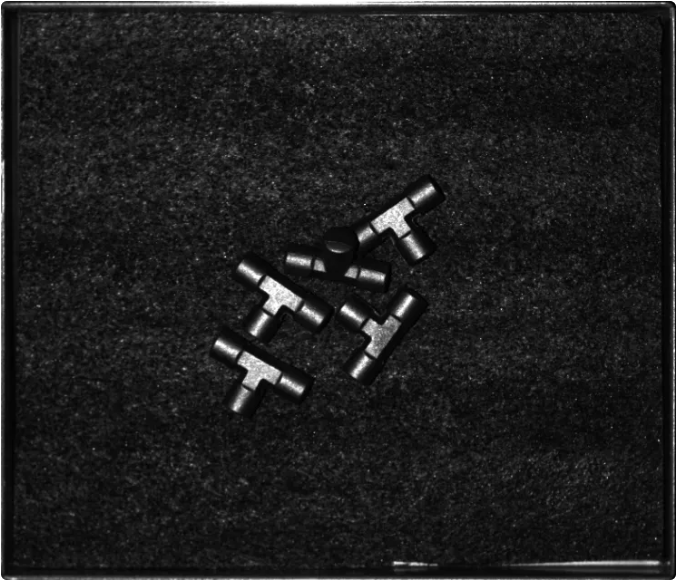

대상 물체 배열 상태 |

예시 그림 |

실제 시나리오를 참고하여 대상 물체를 무작위 순서로 배치합니다. |

|

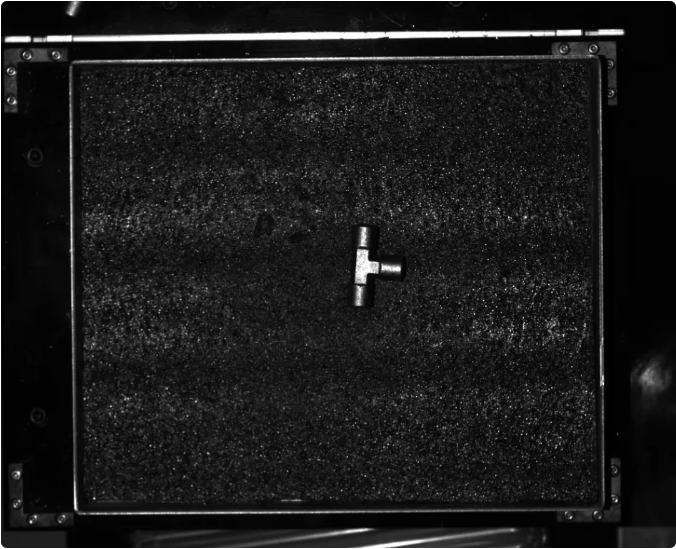

단계2: 이차 위치 결정 스테이션 테스트

대상 물체를 아래의 다섯 가지 시나리오에 따라 배치한 후, 로봇을 이용하여 저속으로 피킹 루프를 수행합니다.

대상 물체 배열 상태 |

예시 그림 |

대상 물체는 이차 위치 결정 스테이션의 중앙에 배치됩니다. |

|

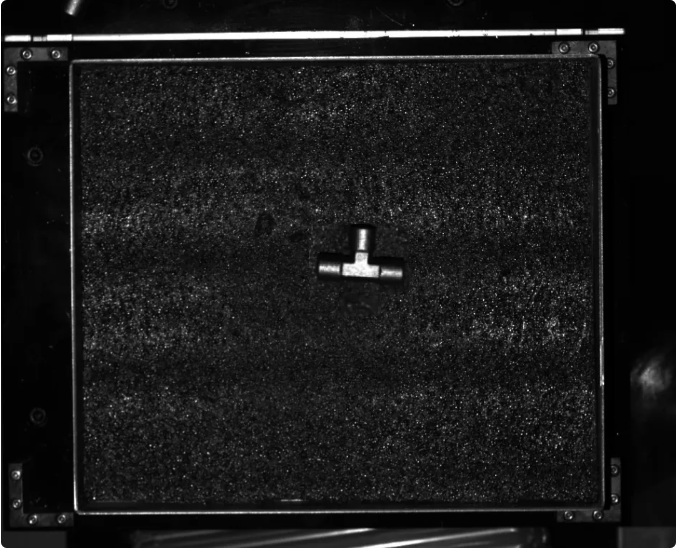

대상 물체를 90도로 회전시킨다킵니다. |

|

대상 물체를 180도로 회전시킨다킵니다. |

|

대상 물체를 270도로 회전시킨다킵니다. |

|

실제 시나리오를 참고하여 대상 물체를 무작위 순서로 배치합니다. |

|

위의 피킹 테스트 시나리오에서 로봇이 다 대상 물체를 성공적으로 피킹할 수 있다면, 비전 시스템이 성공적으로 배포된 것으로 판단할 수 있습니다.