비전 프로젝트 구성

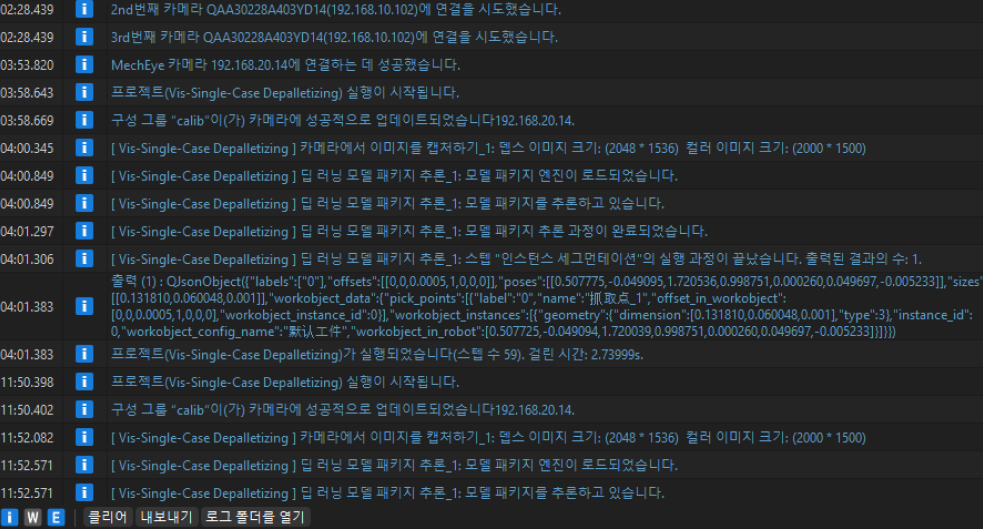

이 튜토리얼 내용을 읽기 전에 로봇 통신 구성 단계에서 '단일 품목 상자 디팔레타이징' 샘플 프로젝트를 사용하여 솔루션을 생성해야 합니다.

이 튜토리얼에서는 먼저 프로젝트 작업 흐름을 소개한 다음, 종이 상자의 포즈를 인식하고 비전 결과를 출력하도록 스텝 파라미터를 조정하여 프로젝트를 배포하는 방법을 설명하겠습니다.

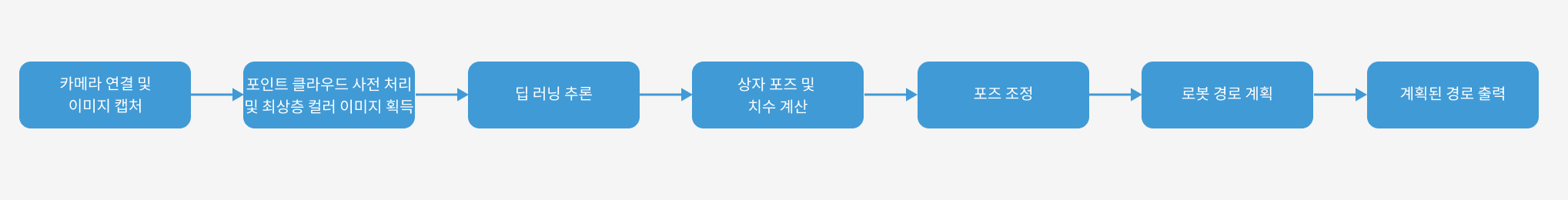

프로젝트 작업 흐름 소개

이 튜토리얼에서 사용자가 Mech-Vision소프트웨어와 Mech-Viz 소프트웨어를 사용하여 비전 프로젝트를 구성합니다. 비전 프로젝트를 구성하는 방법의 프로세스는 아래 그림과 같습니다.

비전 프로젝트 구성의 각각 단계 설명은 다음과 같습니다.

| 단계 | 사용하는 소프트웨어 | 설명 |

|---|---|---|

카메라 연결 및 이미지 캡처하기 |

Mech-Vision |

이미지를 캡처하기 위해 Mech-Vision의 ‘카메라에서 이미지를 캡처하기’ 스텝을 수행합니다. |

포인트 클라우드 사전 처리 및 최상층 컬러 이미지 획득 |

Mech-Vision |

Mech-Vision 소프트웨어의 "포인트 클라우드 사전 처리 및 최상층 컬러 이미지 획득" 사용자 정의한 프로시저를 사용하여 이미지 데이터의 포인트 클라우드를 사전 처리하고 가장 높은 층의 컬러 이미지를 획득합니다. |

딥 러닝 추론 |

Mech-Vision |

Mech-Vision 소프트웨어의 "딥 러닝 모델 패키지 추론" 스텝을 사용하여 가장 높은 층의 컬리 이미지에 대해 인스턴스 세그먼테이션을 수행합니다. |

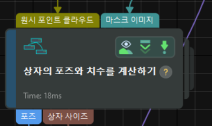

상자 포즈 및 치수 계산 |

Mech-Vision |

Mech-Vision 소프트웨어의 "상자 포즈 및 치수 계산" 사용자 정의 프로시저를 사용하여 가장 높은 층에 있는 종이 상자의 포즈를 계산합니다. |

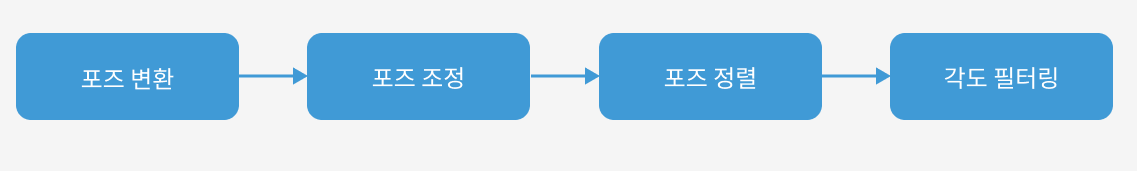

포즈 조정 |

Mech-Vision |

Mech-Vision의 "포즈 조정 V2" 스텝을 통해 "3D 대상 물체 인식" 스텝에서 출력된 포즈에 대해 좌표계 전환, 포즈 조정, 포즈 정렬, 포즈 필터링 등 작업을 수행합니다. |

로봇 경로 계획 |

Mech-Vision & Mech-Viz |

Mech-Vision 소프트웨어의 "출력" 스텝을 통해 비전 결과(물체 기하학적 중심점 포즈, 시나리오의 컬러 포인트 클라우드, 사전 처리된 포인트 클라우드, 종이 상자 윗면 치수 등 정보)를 Mech-Viz에 전송합니다.

|

계획 경로 출력 |

Mech-Viz |

로봇(이 튜토리얼에 사용됨) 혹은 PLC가 보내는 표준 인터페이스 명령어를 수신했을 때, Mech-Viz가 계획된 충돌이 없는 로봇 이동 경로를 반환합니다.

|

스텝 파라미터 조정

이 부분에서는 각 스텝의 파라미터를 조정하여 프로젝트를 배포하는 프로세스를 소개합니다.

| 이 부분에 사용되는 프로젝트는 “단일 품목 상자 디팔레타이징” 솔루션의 “Vis-Single-Case Depalletizing”입니다. |

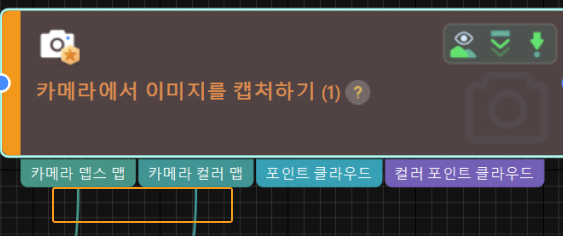

카메라에서 이미지를 캡처하기

스텝 이름 |

카메라에서 이미지를 캡처하기 |

|---|---|

단계 |

카메라 연결 및 이미지 캡처하기 |

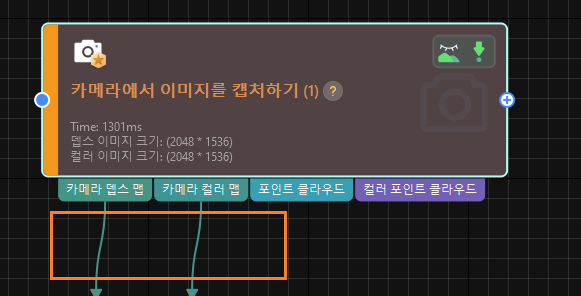

예시 그림 |

|

설명 |

실제 카메라에 연결하고 관련 파라미터를 구성하여 카메라가 정상적으로 이미지를 캡처할 수 있도록 합니다. |

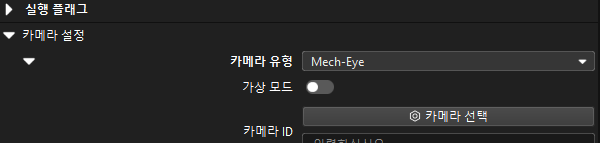

-

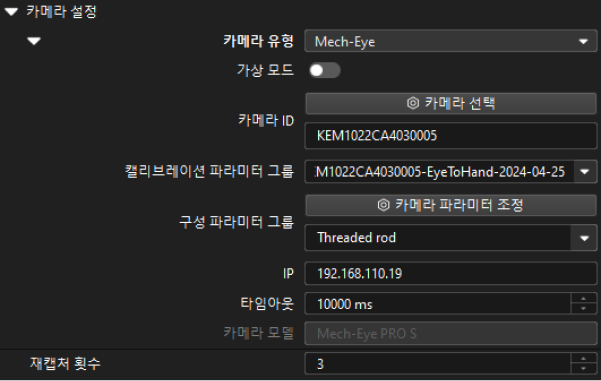

Mech-Vision 프로젝트 편집 영역에서 카메라에서 이미지를 캡처하기 스텝을 선택하고 오른쪽 하단의 스텝 파라미터 탭에서카메라 선택 버튼을 클릭합니다.

-

사용할 카메라 및 캘리브레이션 파라미터 그룹 선택 창이 나타나면 카메라 일련번호 오른쪽에 있는

아이콘을 클릭합니다. 카메라가 성공적으로 연결되면 이 아이콘이

아이콘을 클릭합니다. 카메라가 성공적으로 연결되면 이 아이콘이  로 변경됩니다.

로 변경됩니다.

카메라가 연결된 후, 파라미터 그룹 선택 버튼을 클릭하여 캘리브레이션된 파라미터 그룹(ETH/EIH와 날짜 정보가 표시됨)을 선택합니다.

여기서 선택된 캘리브레이션 파라미터 그룹은 핸드-아이 캘리브레이션이 완료된 후 생성된 것입니다. -

카메라를 연결하고 캘리브레이션 파라미터 그룹을 설정하면 카메라 캘리브레이션 파라미터 그룹, IP 주소 및 포트와 같은 파라미터가 자동으로 획득됩니다. 파라미터 그룹 구성 파라미터가 이미 '종이 상자’로 설정되어 있는지 확인하세요.

-

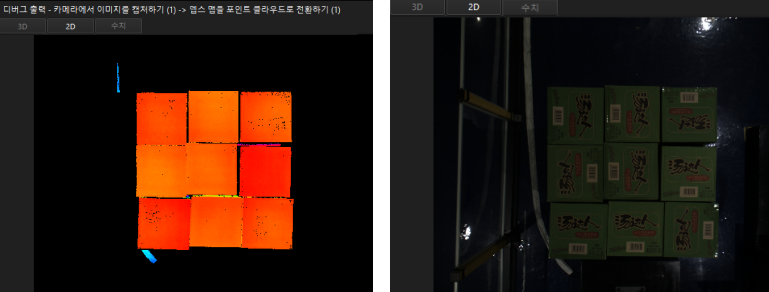

카메라에서 이미지를 캡처하기 스텝의 단번 실행 버튼을 클릭하여 이미지 캡처를 트리거하고, 스텝의 '카메라 뎁스 맵' 및 '카메라 컬러 이미지' 데이터 스트림을 두번 클릭하고 디버그 출력 창에서 카메라에서 이미지가 성공적으로 캡처되었는지 확인합니다.

-

디버그 출력 창에서 일반적인 뎁스 맵과 컬러 이미지가 보이면 Mech-Vision 소프트웨어가 실제 카메라에 성공적으로 연결되어 정상적으로 이미지를 캡처할 수 있습니다.

포인트 클라우드 사전 처리 및 최상층 컬러 이미지 획득

스텝 이름 |

포인트 클라우드 사전 처리 및 최상층 컬러 이미지 획득 |

|---|---|

단계 |

포인트 클라우드 사전 처리 및 최상층 컬러 이미지 획득 |

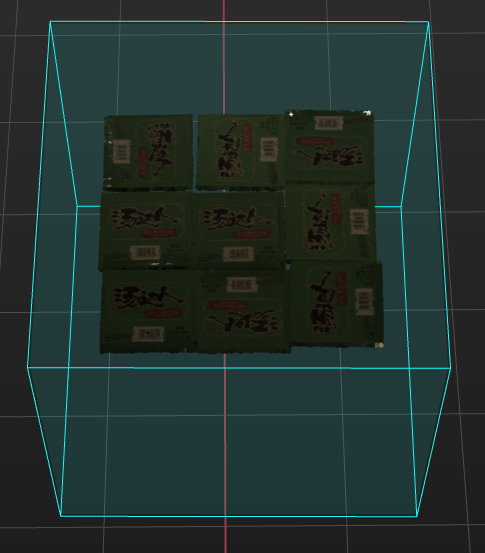

예시 그림 |

|

설명 |

간섭 요인을 영역 밖으로 제거하고 효과적인 인식 영역(3D ROI)을 설정하며, 가장 높은 층의 2D 이미지를 추출할 때 오류가 발생하지 않도록 "층 높이" 파라미터를 설정해야 합니다. |

-

인식 효율성을 높이기 위해 효과적인 인식 영역(3D ROI)을 설정하여 간섭 요인이 해당 영역에 들어오지 않도록 합니다. 설정한 3D ROI 범위에는 상자가 포함되어야 하며, 들어오는 재료의 치수 편차를 수용할 수 있도록 약 50mm 정도 적절하게 확장되어야 합니다.

-

획득할 가장 높은 층 포인트 클라우드의 "층 높이"를 설정합니다. 설정된 파라미터 값은 상자 높이보다 작아야 하며 같은 층에 있는 상자의 최대 높이 차이보다 커야 합니다.

딥 러닝 모델 패키지 추론

스텝 이름 |

딥 러닝 모델 패키지 추론 |

|---|---|

단계 |

딥 러닝 추론 |

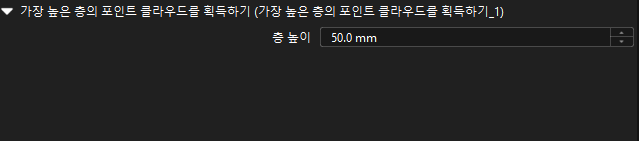

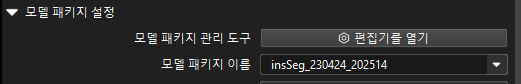

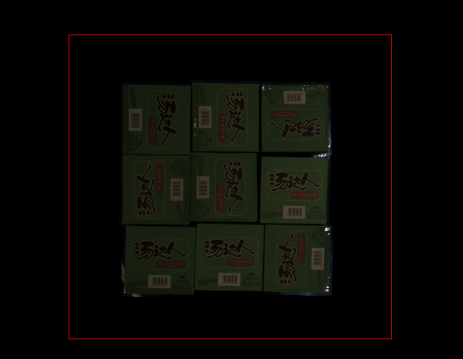

예시 그림 |

|

설명 |

솔루션에 내장된 딥 러닝 모델 패키지를 가져오고 로드한 후, 2D ROI를 설정하여 딥 러닝 추론 효과를 향상시킵니다. |

-

모델 패키지 관리 도구를 사용하여 딥 러닝 모델 패키지를 가져오고 도입한 모델 패키지를 선택합니다.

-

딥 러닝 추론의 효과를 향상시키기 위해 2D ROI를 설정합니다. 설정된 2D ROI 범위는 들어오는 재료의 위치 변동을 수용할 수 있도록 1/3의 적절한 여백을 두고 가장 높은 층의 상자를 덮어야 합니다.

상자 포즈 및 치수 계산

스텝 이름 |

상자 포즈 및 치수 계산(사용자 정의 프로시저) |

|---|---|

단계 |

상자 포즈 및 치수 계산 |

예시 그림 |

|

설명 |

이 스텝에서는 파라미터를 별로도 설정할 필요가 없습니다. |

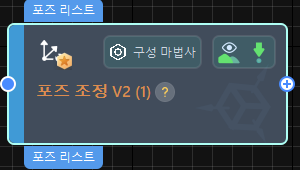

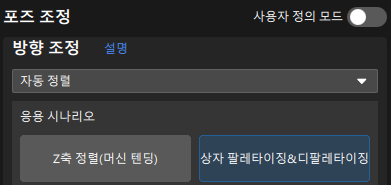

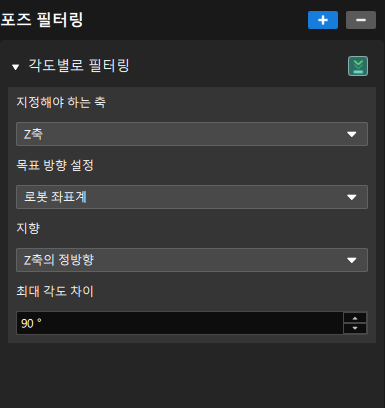

포즈 조정 V2

스텝 이름 |

포즈 조정 V2 |

|---|---|

단계 |

포즈 조정 |

예시 그림 |

|

설명 |

포즈 변환, 포즈 조정, 포즈 정렬 및 포즈 필터링을 위해 파라미터를 구성해야 합니다. |

대상 물체의 포즈를 얻은 후, 포즈를 조정해야 합니다. 구체적인 처리 프로세스는 다음과 같습니다.

Mech-Vision에는 포즈 조정 도구가 내장되어 있습니다. 이 도구를 사용하여 물체 포즈를 쉽게 조정하고 피킹 순서를 최적화할 수 있습니다. 다음 어떤 방식으로든 포즈 조정 도구를 열어 파라미터를 조정할 수 있습니다.

-

프로젝트의 편집 영역에서 스텝의 구성 마법사 버튼을 클릭합니다.

-

스텝 파라미터 탭에 있는 구성 마법사 버튼을 클릭합니다.

다음 스텝을 수행하여 파라미터를 조정하십시오.

-

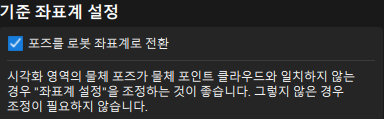

포즈 변환: 포즈 조정 탭에서 포즈를 카메라 좌표계에서 로봇 기준 좌표계로 변환합니다.

-

포즈 조정: 포즈 조정 탭에서 "자동 정렬"을 선택하고 "상자 디팔레타이징/팔레타이징" 시나리오를 선택합니다.

-

포즈 정렬: 포즈 규칙 탭에서 “Z자형 평면 정렬” 정렬 유형을 선택하고 "기준 포즈"의 방향을 설정합니다.

-

각도 필터링: 포트 규칙 탭에서 포즈 Z축의 방향에 따라 피킹 불가능하거나 인식 오류가 있는 포즈를 필터링하여 Mech-Viz의 경로 계획 시간을 단축합니다.

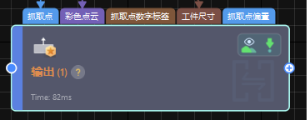

출력

스텝 이름 |

출력 |

|---|---|

단계 |

로봇 경로 계획(전제 조건) |

예시 그림 |

|

설명 |

경로 계획 및 충돌 감지에 필요한 정보가 모두 출력이 가능할지를 확인해야 합니다. |

경로 계획 및 충돌 감지의 요구 사항에 따라 다음과 같은 정보를 Mech-Viz로 출력해야 합니다.

-

물체 기하학적 중심점 포즈

-

시나리오의 컬러 포인트 클라우드

-

상자 윗면 치수

위의 모든 포트가 데이터 스트림과 연결됨을 확인한 후, 실행 버튼을 클릭하여 프로젝트가 성공적으로 실행할 수 있음을 확인하고 비전 결과를 출력합니다. Mech-Vision로그 바의 비전 옵션에서 비전 결과를 포함하는 로그가 있는지를 확인할 수 있습니다.