ワーク認識

本ガイドを読む前に、ロボット通信設定 を参照し、一般的な部品認識 を使用してMech-Visionソリューションを作成する必要があります。

まず、プロジェクトの構築手順を確認し、ステップパラメータの調整とプロジェクト実装により、ワークの位置姿勢を取得してビジョン結果を出力します。

動画:ワーク認識

|

| 本ガイドでは、Mech-Visionプロジェクトを一回実行すると1つのビジョンポイントを出力できます。 |

プロジェクトの構築手順

使用するステップと機能は下表のどおりです。

| 番号 | 階段 | ステップ | サンプル図 | 説明 |

|---|---|---|---|---|

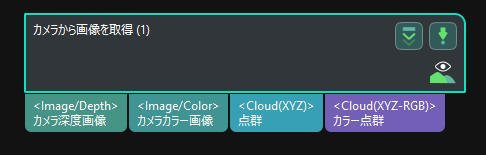

1 |

画像取得 |

カメラから画像を取得 |

|

カメラを接続して画像を撮影します |

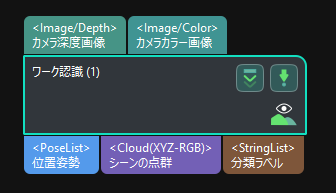

2 |

ワーク認識 |

ワーク認識 |

|

3Dマッチングにより、ワークの位置姿勢(把持位置姿勢として使用)を計算します |

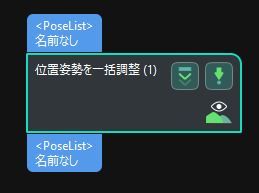

3 |

位置姿勢調整 |

位置姿勢を一括調整 |

|

把持位置姿勢をカメラ座標系からロボット座標系に変換します |

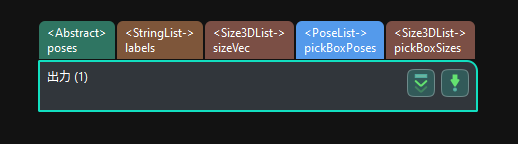

4 |

ビジョン結果を出力 |

出力 |

|

把持するワークの位置姿勢を出力します |

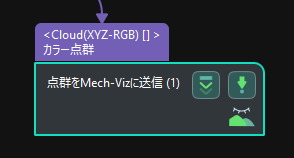

5 |

シーンの点群を送信 |

点群をMech-Vizに送信 |

|

シーンの点群をMech-Vizに送信し、Mech-Vizと連携してワークの把持と配置を実現します |

|

把持位置姿勢とは、ロボットがワークに対してピッキング可能な位置のことを指します。 |

ステップパラメータの調整

以下では、パラメータの調整について説明します。

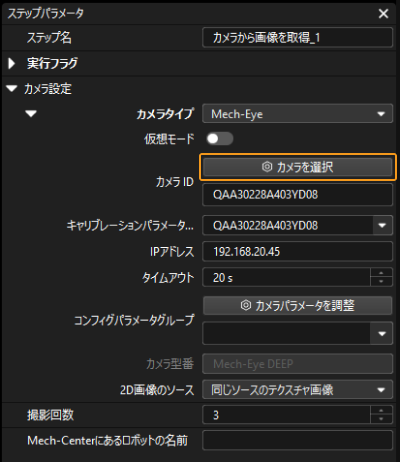

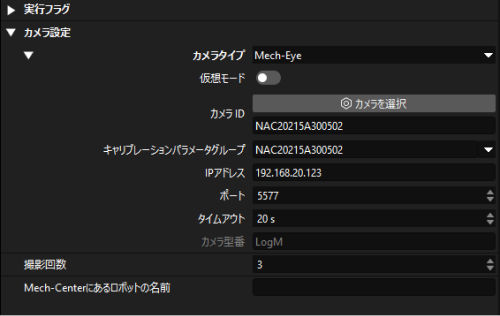

カメラから画像を取得

カメラから画像を取得 ステップでカメラに接続し、ステップパラメータを調整します。

-

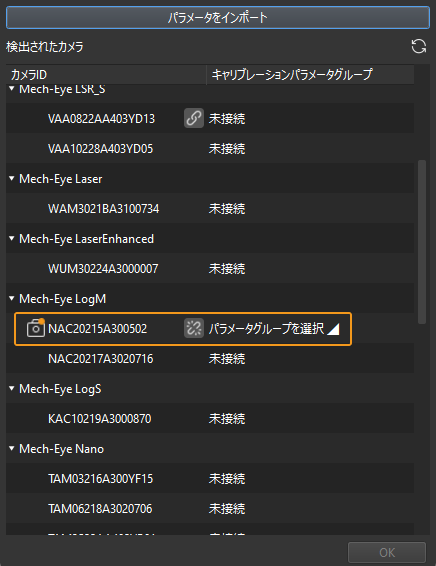

カメラから画像を取得 ステップをクリックして選択し、ステップパラメータで カメラを選択 をクリックします。

-

表示される画面で

をクリックすると、カメラの接続が完了です。カメラが正常に接続された場合、

をクリックすると、カメラの接続が完了です。カメラが正常に接続された場合、 は

は  に変わります。

に変わります。

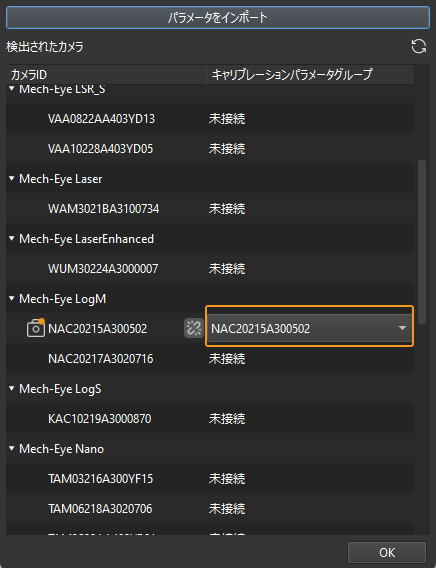

カメラ接続後、パラメータグループを選択します。パラメータグループを選択 をクリックして、ETH/EIHと日付のあるキャリブレーション済みのパラメータグループを選択します。

-

カメラを接続し、パラメータグループを設定すると、キャリブレーションパラメータグループ、IPアドレス、ポートなどのパラメータが自動的に入力されます。それ以外のパラメータ設定は不要です。

これで、カメラは正常に接続されています。

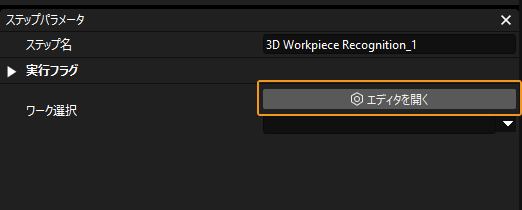

ワーク認識

ワーク認識 ステップには、可視化設定ツールに組み込まれています。このツールは、点群前処理、モデルマッチング、ワークの位置姿勢(把持位置姿勢)の計算に対応できます。

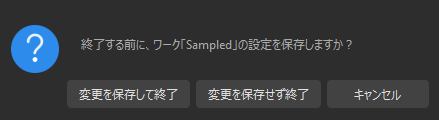

ワーク認識 ステップをクリックして選択し、ステップパラメータで エディタを開く をクリックします。

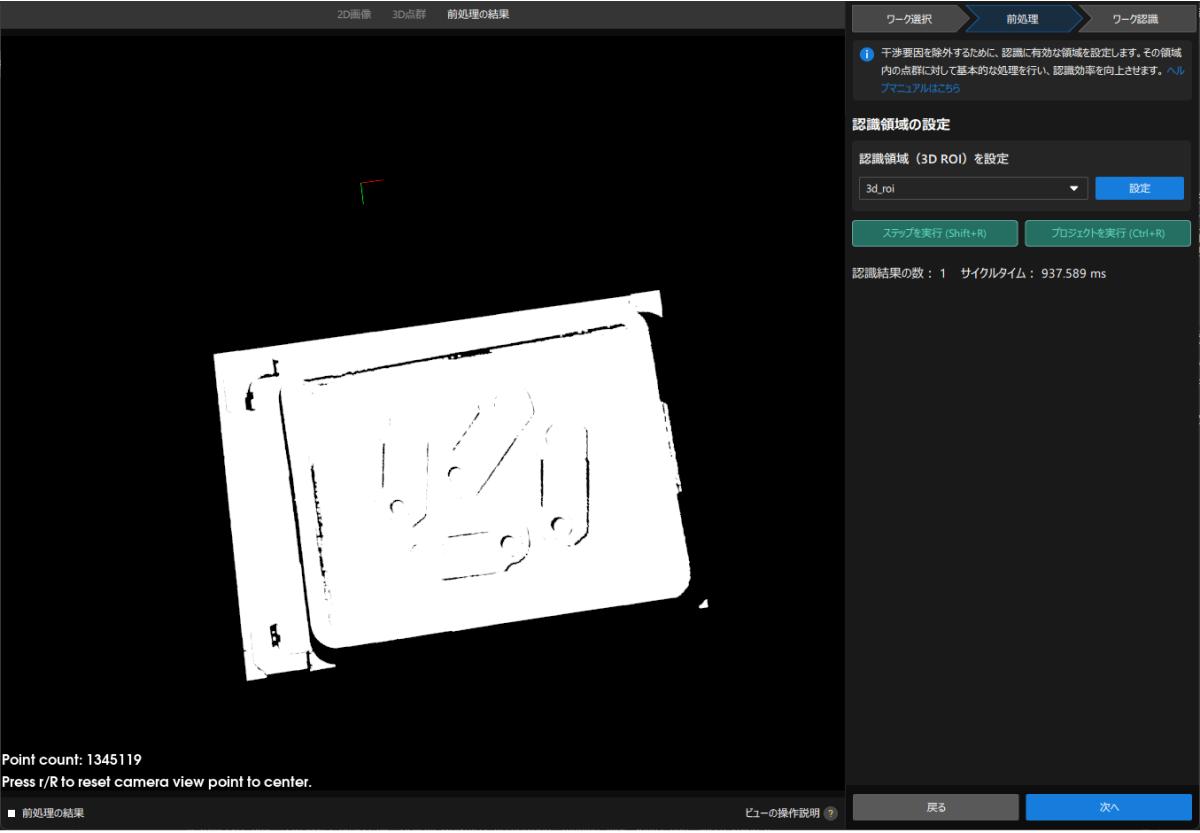

「ワーク認識」の可視化設定ツールを下図のように示します。

次に、下図のような手順でワーク認識を行います。

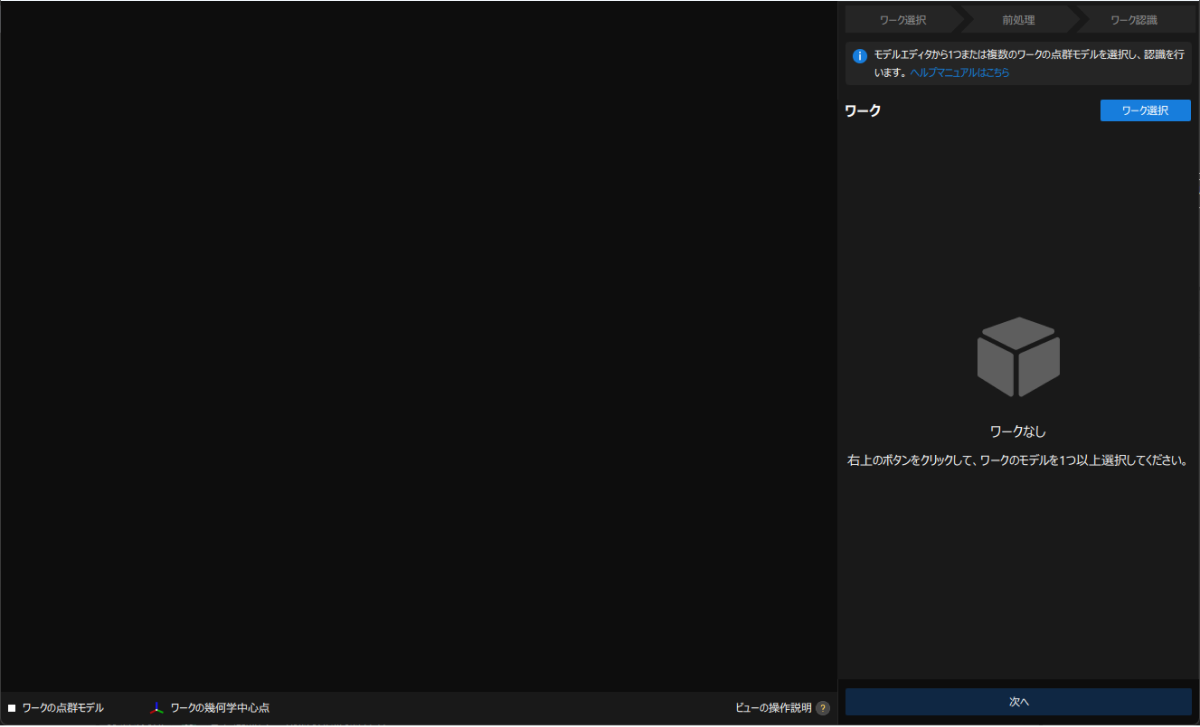

ワーク選択

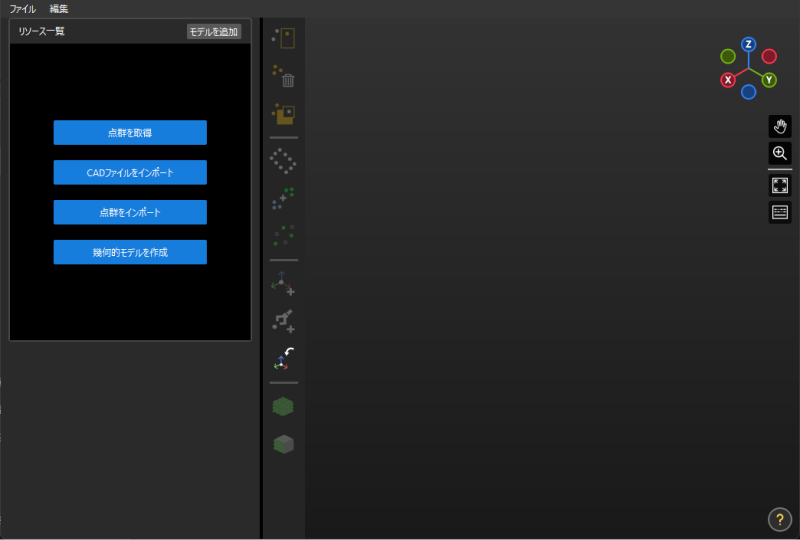

「ワーク認識」の可視化設定ツールを起動した後、認識するワークの点群モデルを作成する必要があります。

-

モデルエディタを開きます。

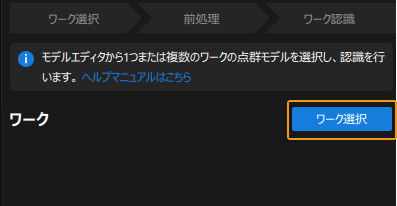

画面の右上隅にある ワーク選択 をクリックします。

表示される画面で モデルエディタを開く をクリックします。

モデルエディタの画面を下図に示します。

-

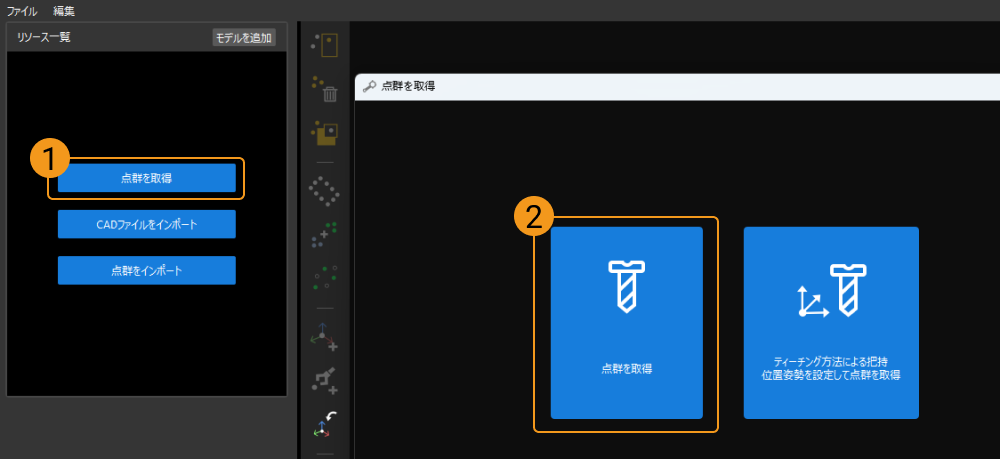

点群取得により点群モデルを生成します。

-

対象物の深度画像を取得します。

点群を取得 をクリックして、表示される画面で 点群を取得 をクリックします。

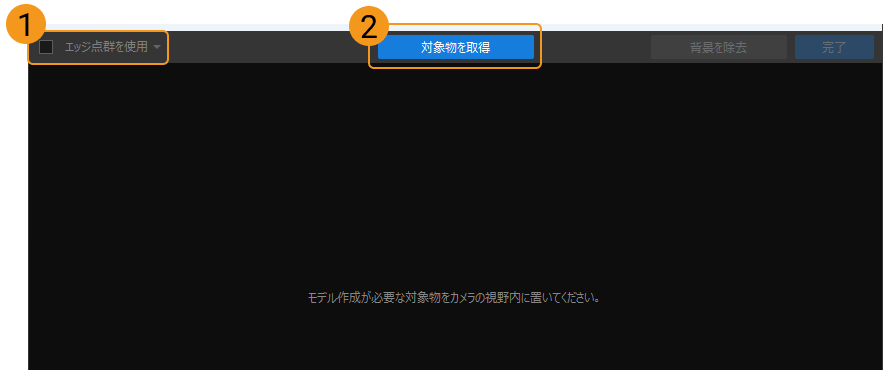

トラックリンクの表面特徴が多いため、サーフェスモデルを作成することを推奨します。ここでは、エッジ点群を使用 のチェックを外します。その後、対象物を取得 をクリックして対象物の深度画像を取得します。

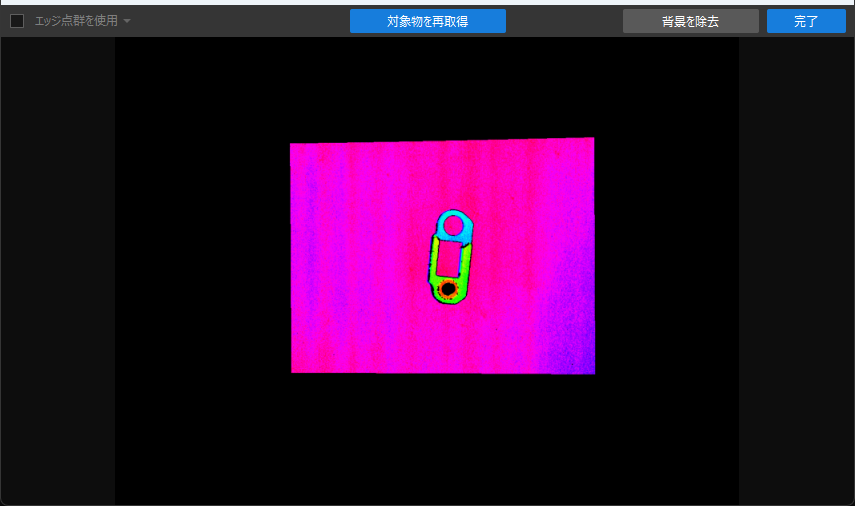

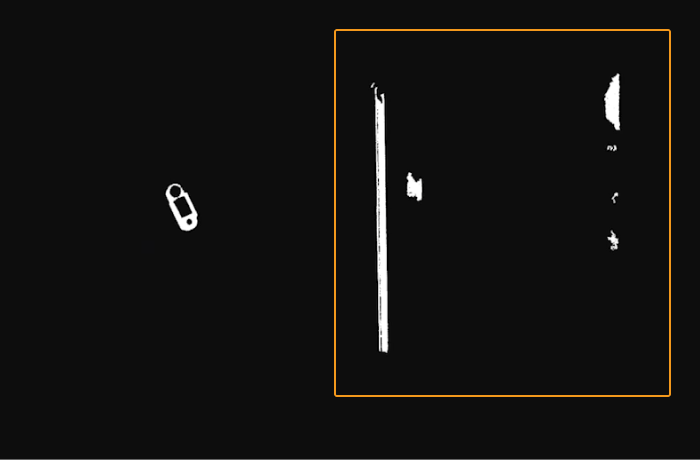

取得後、対象物と背景の深度画像は下図のようになります。

-

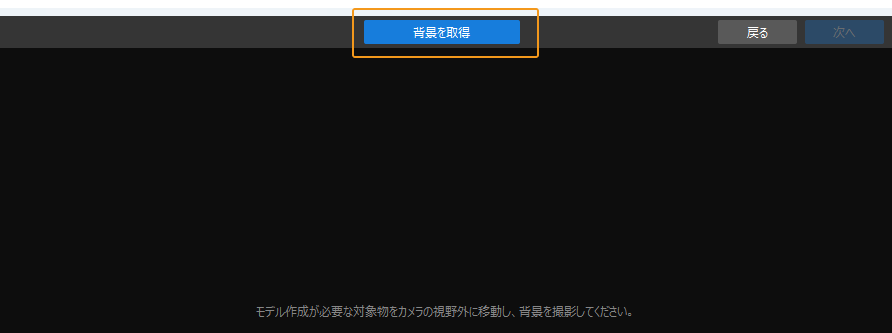

背景画像を取得します。

右上隅にある 背景を除去 をクリックします。

次に、対象物をカメラの視野外に移動させます。 背景を取得 をクリックして背景を取得します。

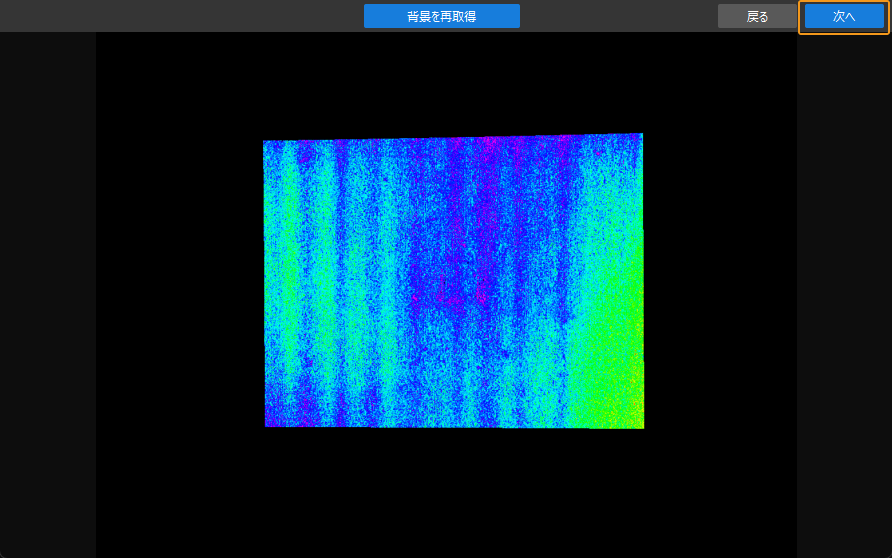

背景取得後の画像は下図のようになります。右上隅にある 次へ をクリックします。

-

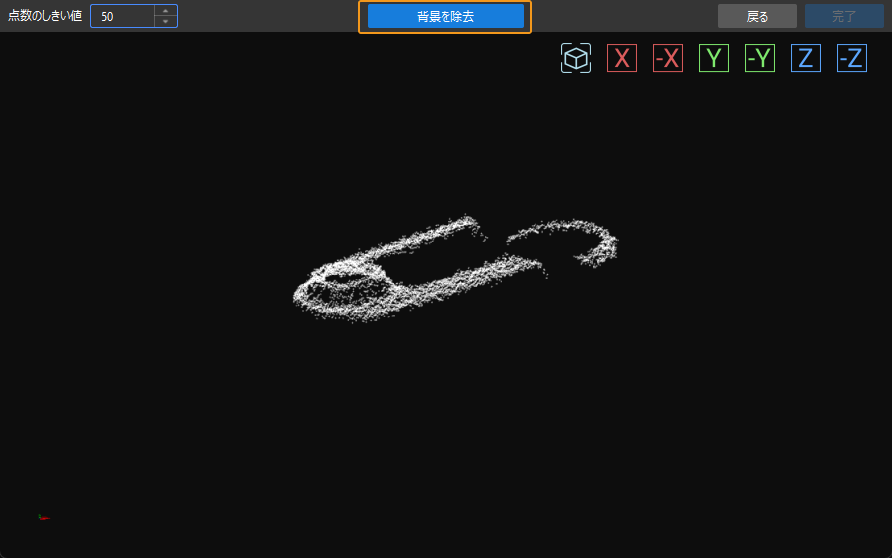

背景を除去します。

この画面で 背景を除去 をクリックすると、背景除去後の対象物が取得されます。その後、右上隅の 完了 をクリックすると、背景除去後の対象物が「マッチングモデル・把持位置姿勢エディタ」にインポートされます。

-

-

点群モデルを編集します。

生成された点群モデルは実際の応用シーンに適さない可能性があるため、ノイズ除去や点群ダウンサンプリングなどの編集が必要となります。

-

ノイズを除去します。

をクリックした後、除去するノイズを選択して

をクリックした後、除去するノイズを選択して  をクリックします。すると、選択した領域内のノイズが除去されます。

をクリックします。すると、選択した領域内のノイズが除去されます。下図に示すように、選択した点はノイズであり、上記の方法で除去することが可能です。

-

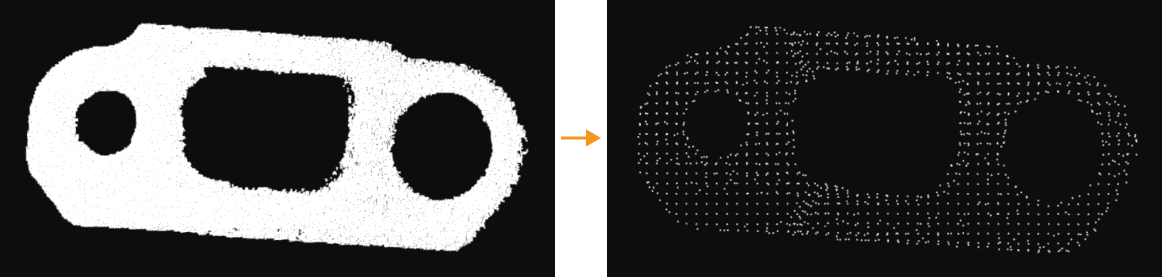

点群ダウンサンプリングを行います。

点群ダウンサンプリングの目的は、モデル点群の点数を減らし、モデルマッチングの効率を向上させることです。

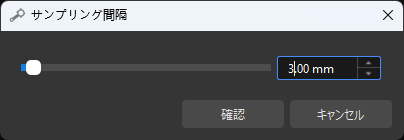

をクリックし、表示される画面でサンプリング間隔を設定します。

をクリックし、表示される画面でサンプリング間隔を設定します。

例えば、サンプリング間隔を3mmに設定すると、ダウンサンプリング前後の点群モデルを下図に示します。

-

-

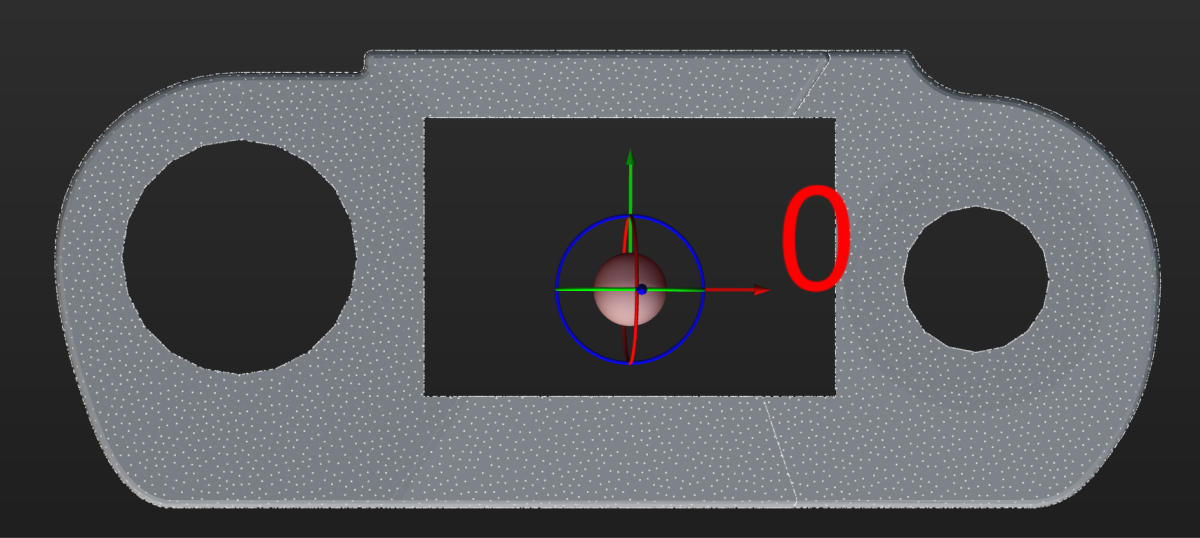

把持位置姿勢を追加します。

ツールバーの

をクリックし、把持位置姿勢として使用する位置姿勢を、ワークの点群モデルに追加します。

をクリックし、把持位置姿勢として使用する位置姿勢を、ワークの点群モデルに追加します。

追加された把持位置姿勢を下図に示します。

-

モデルと把持位置姿勢を保存します。

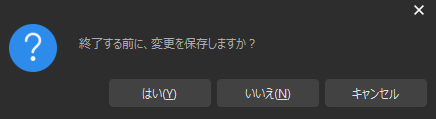

モデルエディタの終了ボタンをクリックし、表示される画面で はい(Y) をクリックします。

-

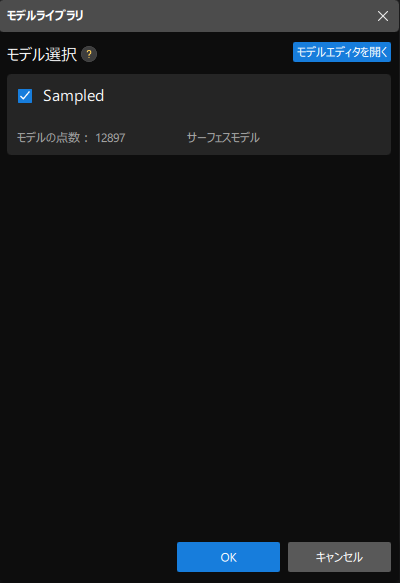

モデルライブラリからワークのモデルを選択します。

モデルエディタを終了したら、モデルライブラリから保存された点群モデルにチェックを入れ、OK をクリックします。

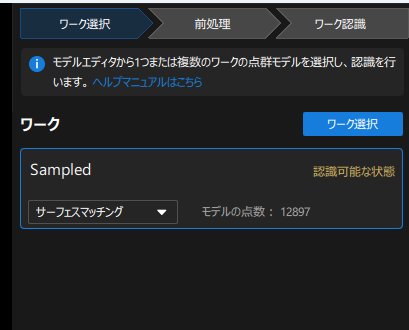

すると、認識するワークは可視化設定ツールの右上隅に表示されます。

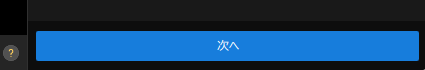

ワークの選択が完了しましたので、画面下部にある 次へ をクリックして前処理を行います。

前処理

前処理の目的は、認識領域を設定することで不要な点群を除去し、ワークの点群のみを残し、プロジェクトの実行速度を向上させることです。

前処理の画面を下図に示します。

-

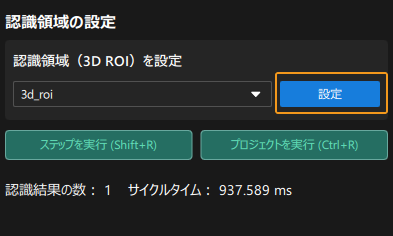

認識領域を設定します。

設定 をクリックします。

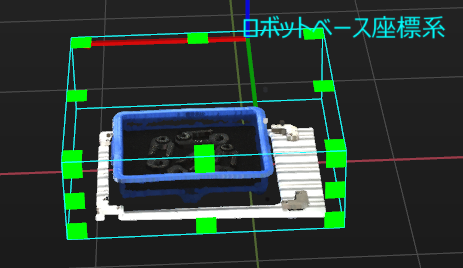

3D関心領域を設定します。Ctrl キーを押しながらマウスの左ボタンで3D ROI選択フレームの頂点を長押ししてドラッグし、それを適切なサイズに変更します。変更後の効果を下図に示します。

-

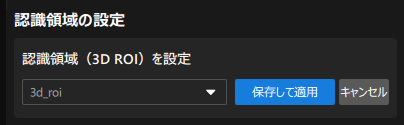

認識領域の設定を保存します。

保存して適用 をクリックして設定を保存します。

前処理は完了しましたので、画面下部にある 次へ をクリックしてワーク認識を行います。

ワーク認識

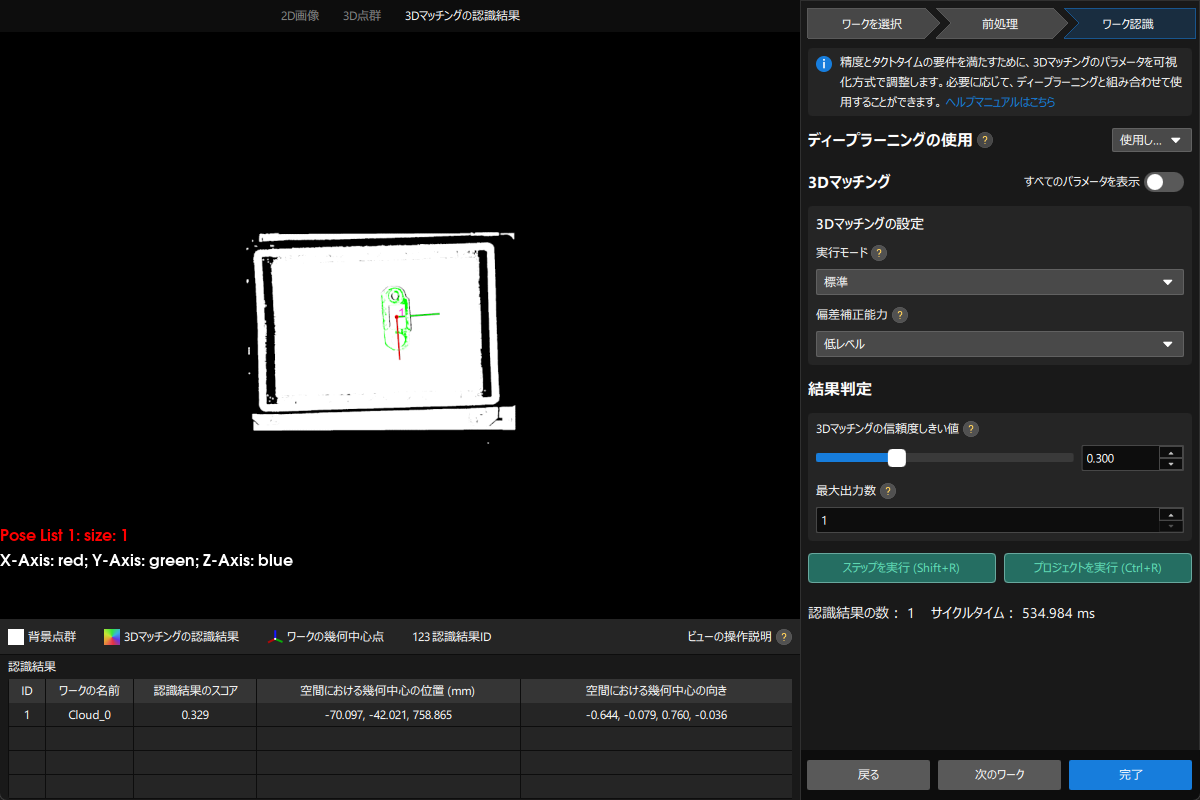

可視化方式で3Dマッチングの関連パラメータを調整して、ワークの位置姿勢を出力できます。

認識画面を下図に示します。

-

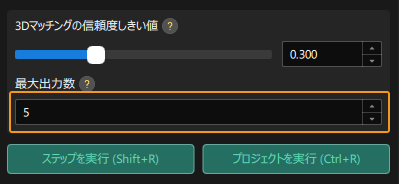

ロボットがビジョン結果に基づいてワークの把持と配置を実行する必要があるため、このプロジェクトでは最大出力数 を1に設定します。

-

可視化出力結果を確認します。

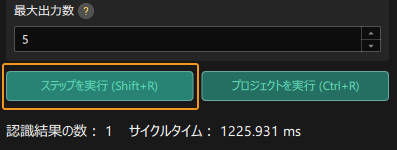

ステップを実行(Shift+R) をクリックします。

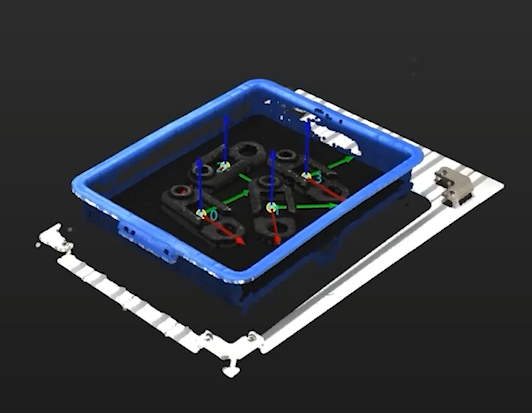

すると、可視化出力結果が可視化エリアに表示されます。下図に示すように、1つのワークの位置姿勢が出力されます。

-

設定を保存します。

可視化設定ツールの画面下部にある 完了 をクリックします。

表示される画面で 変更を保存して終了 をクリックします。

これで、ワークの認識と把持位置姿勢の計算が完了しました。

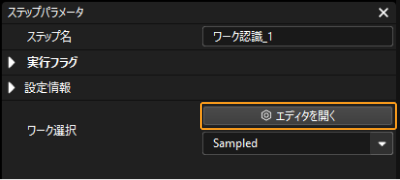

位置姿勢を一括調整(V2)

ワーク認識 ステップによって出力された把持位置姿勢はカメラ座標系にあり、ロボットが把持しやすいようにワークの位置姿勢を調整する必要があります。位置姿勢をカメラ座標系からロボット座標系に変換します。

-

位置姿勢編集ツールを開きます。

位置姿勢を一括調整(V2) ステップをクリックして選択し、ステップパラメータで エディタを開く をクリックします。

位置姿勢編集ツールの画面を下図に示します。

-

座標系の変換タイプを調整します。

位置姿勢編集ツールの右上隅にある 座標系設定 で 位置姿勢をロボット座標系に変換 にチェックを入れます。

-

座標系の変換効果を確認します。

位置姿勢編集ツールの右下隅にある 次へ をクリックします。

すると、画面中央のシーンの視点から変換後の把持位置姿勢を確認できます。

-

設定を保存します。

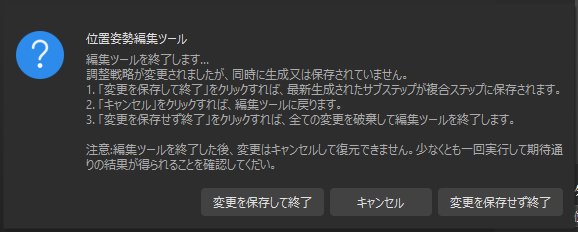

位置姿勢編集ツールの終了ボタンをクリックし、表示される画面で 変更を保存して終了 をクリックします。

これで、把持位置姿勢の座標系変換は完了しました。