预测抓取点(单一物体种类)¶

使用场景¶

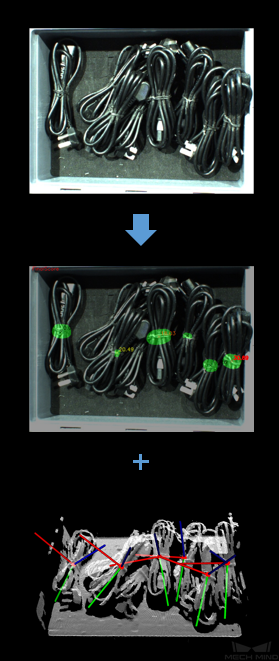

本步骤通常用于散乱堆叠的相同种类物品的分拣。

注意

为本步骤导入模型后,模型文件将会自动转换为供深度学习服务器调用的 .engine 文件。由于转换过程依赖于电脑的显卡,因此请勿将转换后的 .engine 文件拷贝到其他电脑上使用。

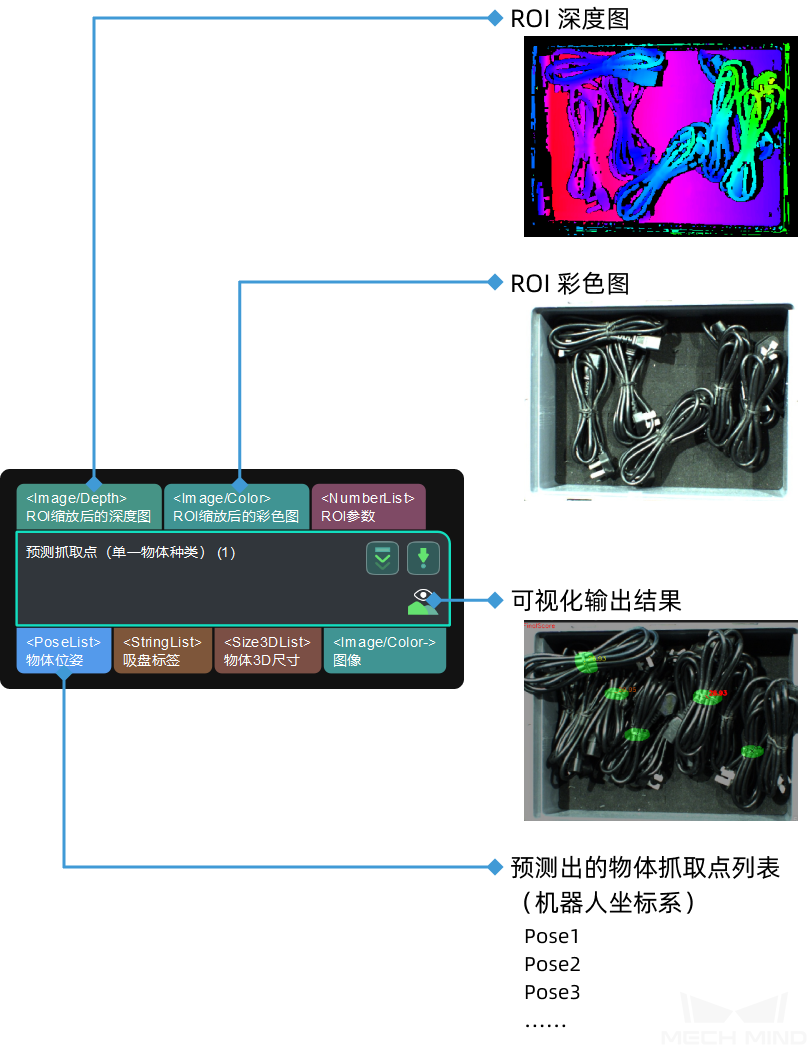

输入与输出¶

参数调节说明¶

服务端

- 服务端 IP

- 默认值:127.0.0.1调节说明:根据实际情况设置深度学习服务端 IP 地址。

- 服务端 Port(1 ~ 65535)

- 默认值:60054调节说明:设置深度学习服务的端口号。应使用 60000~65535 的端口号。

注意

打开工程后,需等待深度学习服务器启动成功,即日志栏出现“启动深度学习服务器成功”的信息后,再运行工程。

模型路径

默认值:空。调节说明:运行工程前需添加深度学习模型路径,模型文件后缀为 .onnx。此模型不能由 Mech-DLK 训练得到,需联系梅卡曼德工程师获取模型。

注意

首次运行本步骤时,需要一定时间加载模型,请耐心等待。

工作距离

- 最小工作距离

- 默认值:0调节说明:相机至场景中物体的最短距离(单位:mm)。若使用料筐,请将此参数设为相机底部至料筐顶部边沿的距离。需根据实际情况设定此值。

- 最大工作距离

- 默认值:3000调节说明:相机至场景中物体的最长距离(单位:mm)。若使用料筐,请将此参数设为相机底部至料筐底部边沿的距离。需根据实际情况设定此值。

料筐设置

- 使用料筐

- 默认值:不勾选。调节说明:可参考 预测抓取点(任意物体) 。

可视化

可参考 预测抓取点(任意物体) 。

排序逻辑

该步骤对识别的位姿按照位姿得分进行降序排序。位姿得分基于如下公式计算:位姿得分 = 位姿高度 * 位姿高度权重 + X 轴偏离角度 * 抓取点 X 轴方向偏离权重 + Y 轴偏离角度 * 抓取点 Y 轴方向偏离权重。

位姿高度:指抓取点与相机底部之间的距离,单位为 mm。

X 轴偏离角度:指抓取点 X 轴与机器人坐标系 X 轴的偏离角度。

Y 轴偏离角度:指抓取点 Y 轴与机器人坐标系 Y 轴的偏离角度。

下面一组参数用于设置位姿排序相关的权重值。

- 位姿高度权重

- 默认值:3值列表:1、2、3调节说明:该参数用于指定在计算位姿得分时位姿高度的权重。

- 抓取点 X 轴方向偏离权重

- 默认值:1值列表:0、1、2、3调节说明:该参数用于指定在计算位姿得分时抓取点 X 轴与机器人坐标系 X 轴的偏离角度的权重。当参数设置为 0 时,抓取点 X 轴偏离角度不参与位姿得分的计算。

- 抓取点 Y 轴方向偏离权重

- 默认值:1值列表:0、1、2、3调节说明:该参数用于指定在计算位姿得分时抓取点 Y 轴与机器人坐标系 Y 轴的偏离角度的权重。抓取点 Y 轴与物体跨度最长的方向一致。当参数设置为 0 时,抓取点 Y 轴偏离角度不参与位姿得分的计算。

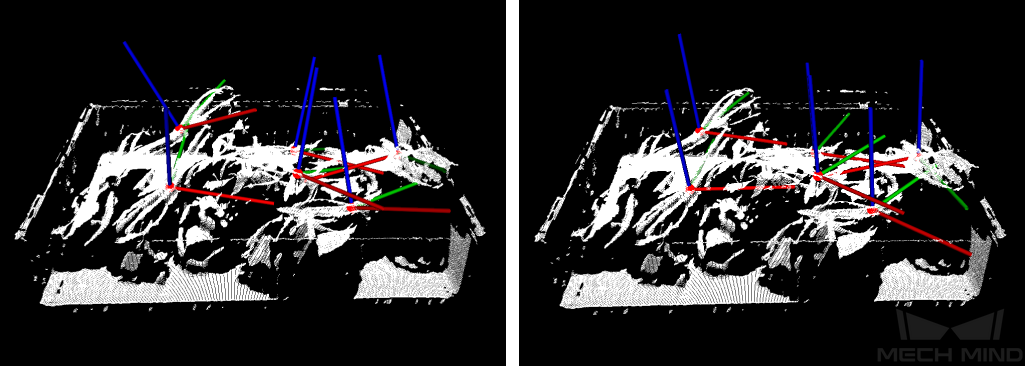

垂直抓取

- 垂直抓取模式

- 默认值:勾选。调节说明:勾选后,物体的位姿将发生变化,Z 轴垂直向上。如下图所示,左图为勾选前,物体的 Z 轴朝向各个方向;右图为勾选后,物体的 Z 轴垂直向上。